Trudne zadanie: nauczyć sztuczną inteligencję, co jest dobre, a co złe, i jak uczynić z technologii narzędzie przejrzystości, odpowiedzialności i dobra wspólnego.

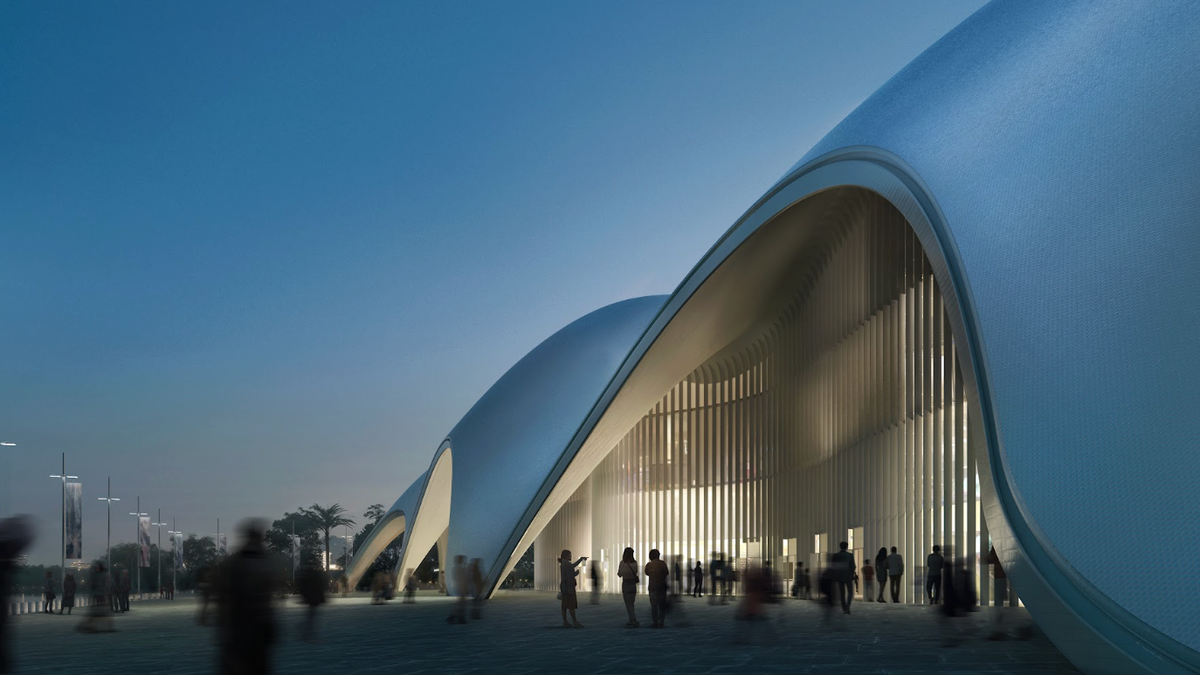

Kiedy etyka staje się „drugim mózgiem” sztucznej inteligencji

Podczas gdy ekscytująca atmosfera AIWS Angel wciąż się rozprzestrzeniała, Komitet Organizacyjny Konkursu AI 2025 szybko ogłosił drugi temat – Etyka AIWS, co oznaczało przejście od tematu „towarzysz AI” do tematu „odpowiedzialna AI”.

Podczas gdy w pierwszym temacie uczestnicy byli zachęcani do tworzenia „aniołów technologii”, aby pomagać ludziom w nauce, innowacjach i dbaniu o zdrowie, AIWS Ethics przenosi wyzwanie na wyższy poziom: projektowanie i rozwijanie narzędzi do oceny wartości etycznych w budowaniu i użytkowaniu sztucznej inteligencji. Celem jest nie tylko tworzenie użytecznych produktów, ale także ukierunkowanie rozwoju sztucznej inteligencji we właściwym kierunku – transparentnym, odpowiedzialnym i dla wspólnego dobra ludzkości.

Zgłoszenia mogą dotyczyć innowacyjnych i przełomowych pomysłów, albo prostego, przystępnego, edukacyjnego i skalowalnego oprogramowania, aplikacji lub systemów oceny. To żyzny grunt dla humanistycznej innowacji – gdzie technologia i etyka idą ręka w rękę.

Dlaczego wybrano „Etykę” właśnie teraz?

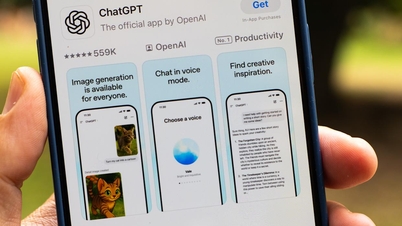

Nigdy wcześniej ludzkość nie odczuwała większej potrzeby dyskusji o etyce w technologii niż teraz. Wraz z rozwojem sztucznej inteligencji poza laboratoriami i wkraczaniem do codziennego życia, pojawiają się ważne pytania: Czy sztuczna inteligencja może być stronnicza? Czy może naruszać prywatność? Czy może podejmować złe, a nawet szkodliwe decyzje?

Badanie przeprowadzone przez Annenberg Media Center (USA) pokazuje, że ponad 70% użytkowników na świecie obawia się niewłaściwego wykorzystania sztucznej inteligencji lub braku kontroli etycznej. Według UNESCO, organizacje międzynarodowe pracują nad stworzeniem globalnych ram oceny etyki sztucznej inteligencji, takich jak „Ocena Skutków Etycznych (EIA)” czy „Rekomendacja w sprawie Etyki Sztucznej Inteligencji”, które pozwolą zmierzyć społeczny i ludzki wpływ technologii.

Jednak większość z tych narzędzi nadal jest przeznaczona dla dużych korporacji lub instytutów badawczych. Młoda społeczność, studenci, startupy – dynamiczne, kreatywne i bliskie użytkownikom – nie dysponują narzędziami wystarczająco blisko, łatwymi w użyciu, aby oceniać i upowszechniać standardy etyczne w dziedzinie sztucznej inteligencji. I to właśnie tę lukę chce wypełnić AIWS Ethics.

Od technologii do sumienia: różnica w etyce AIWS

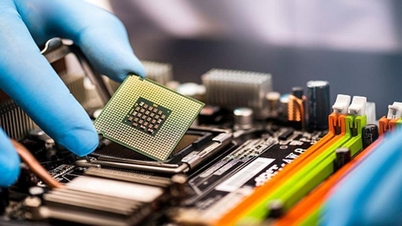

Podczas gdy poprzednie sezony konkursu AI koncentrowały się na zastosowaniach i przełomach technicznych, AIWS Ethics to zaproszenie do dogłębnej analizy „wewnętrznego działania” technologii. Pytanie nie brzmi już: „Co sztuczna inteligencja potrafi?”, ale: „Co powinna robić sztuczna inteligencja – a czego nie powinna?”.

Ten temat wymaga od uczestników nie tylko zrozumienia programowania i algorytmów, ale także umiejętności zadawania pytań etycznych, krytyki społecznej i projektowania w sposób humanitarny. Programista może stać się strażnikiem etyki sztucznej inteligencji; edukator może stworzyć narzędzie do nauczania etyki technologicznej; zespół startupu może opracować aplikację do oceny transparentności chatbotów lub generatorów obrazów.

Właśnie w tym procesie AIWS Ethics otwiera wyjątkową przestrzeń twórczą, w której dane spotykają się z filozofią, algorytmy ze współczuciem.

W duchu tego tematu można wyobrazić sobie niezliczone kierunki kreatywne: aplikację, która pomaga uczniom zrozumieć, na czym polega uczciwość w sztucznej inteligencji; witrynę społecznościową umożliwiającą przyznawanie „punktów etycznych” popularnym narzędziom sztucznej inteligencji; chatbota, który może przedstawiać hipotetyczne sytuacje etyczne i analizować decyzje użytkowników; lub oprogramowanie, które testuje modele uczenia maszynowego w celu wykrywania stronniczości danych.

Te innowacje dotyczą nie tylko technologii, ale także edukacji – podnoszenia świadomości społecznej na temat etyki sztucznej inteligencji. Każdy produkt to mała cegiełka, która buduje kulturę „odpowiedzialnej sztucznej inteligencji”.

Podróż „zasiewania nasion sumienia” dla sztucznej inteligencji

To powiedzenie stanowi również istotę tegorocznego tematu: sztuczna inteligencja potrzebuje nie tylko dużych zbiorów danych, ale i wielkiego serca.

Komitet Organizacyjny Konkursu AIWS Ethics 2025 ma nadzieję, że dzięki inicjatywie AIWS Ethics uda się wywołać falę odpowiedzialnych innowacji, w której młodzi ludzie nie tylko chcą wzmacniać sztuczną inteligencję, ale także ją udoskonalać. Temat ten nie ogranicza się do produktów technologicznych, ale obejmuje również proces budowania kultury: kultury etycznej w erze uczenia maszynowego.

W konkursie mogą wziąć udział nie tylko programiści, ale także edukatorzy, artyści, badacze społeczni — wszyscy zainteresowani tym, w jaki sposób technologia kształtuje ludzki świat .

Zaproszenie z przyszłości

Konkurs AI 2025 otwiera nowy rozdział – w którym każdy pomysł będzie oceniany nie tylko pod kątem skuteczności, ale także odpowiedzialności. Temat przewodni: Etyka AIWS, przypomina, że skoro sztuczna inteligencja potrafi nauczyć się myśleć, to ludzie muszą nauczyć ją żyć w zgodzie z sobą.

A kto wie, może w wyniku tego konkursu grupa wietnamskich studentów stworzy pierwsze narzędzie do oceny etyki oparte na sztucznej inteligencji dla społeczności globalnej – produkt „Make in Vietnam”, który będzie zarówno inteligentny, jak i sumienny.

(Źródło: VLAB Innovation)

Źródło: https://vietnamnet.vn/ai-contest-2025-aiws-ethics-hanh-trinh-gioi-hat-luong-tam-cho-ai-2449711.html

Komentarz (0)