Golpe ao imitar a voz com voz deepfake

Na era do rápido desenvolvimento da inteligência artificial, a voz — um dos fatores antes considerados evidências autênticas — tornou-se uma ferramenta perigosa nas mãos de criminosos. A tecnologia de voz deepfake permite que vozes falsas sejam idênticas às de pessoas reais, criando chamadas falsas sofisticadas para fraudar e se apropriar de propriedade.

Por que a voz deepfake é assustadora?

Deepfake voice é uma tecnologia que aplica inteligência artificial (IA) e aprendizado de máquina para criar uma voz falsa idêntica à voz de uma pessoa real.

Com o suporte de modelos modernos como Tacotron, WaveNet, ElevenLabs ou plataformas de clonagem de voz como Respeecher, os fraudadores precisam apenas de 3 a 10 segundos de amostras de voz para criar um deepfake 95% confiável.

A voz deepfake se torna especialmente perigosa devido à sua capacidade de imitar vozes quase perfeitamente, desde a pronúncia e entonação até mesmo os hábitos de fala únicos de cada pessoa.

Isso torna muito difícil para as vítimas distinguir entre o real e o falso, especialmente quando a voz pertence a parentes, amigos ou superiores.

A mineração de voz também é muito fácil, já que a maioria das pessoas hoje expõe seus áudios em plataformas como TikTok, transmissões ao vivo em redes sociais, podcasts ou reuniões online. Mais preocupante ainda, as vozes deepfake não deixam rastros visuais como imagens ou vídeos , dificultando as investigações e deixando as vítimas vulneráveis a perdas financeiras.

Apenas alguns segundos de amostra de voz podem criar um deepfake

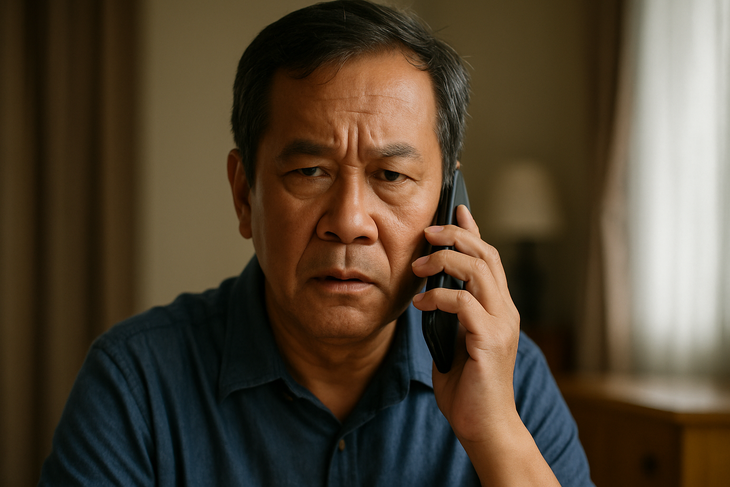

Os golpes de deepfake voice estão se tornando cada vez mais sofisticados, geralmente usando um cenário familiar: imitar a voz de um conhecido em uma situação de emergência para criar pânico e pressionar as vítimas a transferir dinheiro imediatamente.

No Vietnã, houve o caso de uma mãe que recebeu uma ligação do seu "filho" informando que ele havia sofrido um acidente e precisava de dinheiro com urgência. No Reino Unido, um diretor de empresa foi enganado em mais de 240.000 dólares após ouvir seu "chefe" solicitar uma transferência de dinheiro por telefone. Um funcionário administrativo também foi enganado ao receber uma ligação de um "chefão" solicitando pagamento a um "parceiro estratégico"...

O ponto comum nessas situações é que a voz falsa é reproduzida exatamente como a de um parente ou superior, fazendo com que a vítima confie totalmente e não tenha tempo de verificar.

Verifique sempre, não confie imediatamente

Com o aumento dos golpes de deepfake voice, as pessoas são aconselhadas a não transferir dinheiro por telefone apenas com base na voz, mesmo que soe exatamente como a de uma pessoa querida. Em vez disso, ligue novamente para o número antigo ou verifique as informações por vários canais antes de realizar qualquer transação.

Muitos especialistas também recomendam a criação de uma "senha interna" em casa ou na empresa para verificação em situações incomuns.

Além disso, é necessário limitar a publicação de vídeos com vozes claras nas redes sociais, especialmente os de conteúdo longo. Em particular, é necessário alertar e orientar proativamente grupos vulneráveis, como idosos ou pessoas com pouca exposição à tecnologia, pois estes são os alvos prioritários de golpes de alta tecnologia.

Vozes de parentes, amigos e colegas podem ser falsificadas.

Em muitos países, as autoridades começaram a reforçar a gestão da tecnologia deepfake com sua própria estrutura legal.

Nos EUA, vários estados proibiram o uso de deepfakes em campanhas eleitorais ou para disseminar desinformação. A União Europeia (UE) aprovou a Lei de IA, que exige que as organizações sejam transparentes e avisem claramente se um conteúdo é gerado por inteligência artificial.

Enquanto isso, no Vietnã, embora não haja regulamentações específicas para vozes deepfake, atos relacionados podem ser tratados de acordo com a lei atual, com crimes como fraude, apropriação de propriedade, violação de privacidade ou falsificação de identidade.

No entanto, a realidade é que a tecnologia está se desenvolvendo a um ritmo muito além da capacidade de monitoramento da lei, deixando muitas brechas que os criminosos podem explorar.

Quando a voz não é mais evidência

A voz costumava ser algo íntimo e confiável, mas com a voz deepfake, ela não é mais uma prova válida. Na era da IA, cada indivíduo precisa ter conhecimento de defesa digital, verificar proativamente e estar sempre vigilante, pois uma chamada pode ser uma armadilha.

Fonte: https://tuoitre.vn/lua-dao-bang-deepfake-voice-ngay-cang-tinh-vi-phai-lam-sao-20250709105303634.htm

![[Foto] Inundação no lado direito do portão, entrada da Cidadela de Hue](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/28/1761660788143_ndo_br_gen-h-z7165069467254-74c71c36d0cb396744b678cec80552f0-2-jpg.webp)

![[Foto] O primeiro-ministro Pham Minh Chinh presidiu uma reunião para discutir soluções para superar as consequências das inundações nas províncias centrais.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/29/1761716305524_dsc-7735-jpg.webp)

![[Foto] O presidente da Assembleia Nacional, Tran Thanh Man, recebeu uma delegação do Partido Social-Democrata da Alemanha](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/28/1761652150406_ndo_br_cover-3345-jpg.webp)

![[Foto] Os rascunhos dos documentos do 14º Congresso do Partido chegam às mãos dos Correios Culturais da Comuna](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/28/1761642182616_du-thao-tai-tinh-hung-yen-4070-5235-jpg.webp)

Comentário (0)