Trata-se de um modelo de linguagem abrangente (LLM, na sigla em inglês) desenvolvido por cientistas chineses que pode comandar drones militares para atacar sistemas de radar inimigos.

|

Segundo o SCMP, cientistas da indústria de defesa chinesa desenvolveram um tipo de IA capaz de aprimorar o desempenho de drones de guerra eletrônica.

Este modelo de linguagem de grande escala (LLM, na sigla em inglês), semelhante ao ChatGPT, poderia comandar drones equipados com armas de guerra eletrônica para atacar radares ou sistemas de comunicação de aeronaves inimigas.

Os resultados dos testes mostram que seu desempenho na tomada de decisões em combate aéreo não apenas supera as técnicas tradicionais de inteligência artificial (IA), como o aprendizado por reforço, mas também supera o de especialistas experientes.

Este é o primeiro estudo amplamente divulgado a aplicar diretamente modelos de linguagem de grande escala a armas.

Anteriormente, essa tecnologia de IA estava amplamente confinada a salas de guerra, fornecendo análises de inteligência ou suporte à decisão para comandantes humanos.

O projeto de pesquisa foi realizado em conjunto pelo Instituto de Projeto de Aeronaves de Chengdu, da Corporação da Indústria de Aviação da China, e pela Universidade Politécnica do Noroeste, em Xi'an, província de Shaanxi.

O instituto é o projetista do caça furtivo pesado J-20 da China.

O trabalho, que ainda está em fase experimental, é o melhor em compreensão da linguagem humana entre as tecnologias de IA existentes, de acordo com um artigo publicado pela equipe do projeto em 24 de outubro na revista científica Detection & Control.

A equipe do projeto forneceu à LLM diversos recursos, incluindo "uma série de livros sobre radar, guerra eletrônica e coleções de documentos relacionados".

Outros documentos, incluindo registros de combate aéreo, registros de instalação de depósitos de armas e manuais de operações de guerra eletrônica, também foram incorporados ao modelo.

Segundo pesquisadores, a maior parte do material de treinamento está em chinês.

|

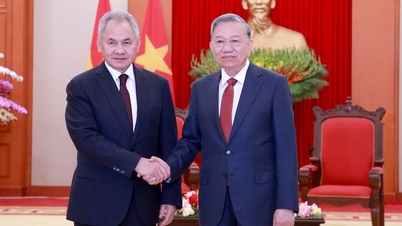

| O projetista do caça furtivo J-20 da China faz parte de uma equipe de pesquisa envolvida no projeto de IA. Foto: Weibo |

Na guerra eletrônica, o atacante libera ondas eletromagnéticas específicas para suprimir os sinais de radar emitidos pelo alvo.

Por outro lado, o defensor tentará evitar esses ataques alterando constantemente o sinal, forçando o adversário a ajustar sua estratégia em tempo real com base nos dados de vigilância.

Anteriormente, acreditava-se que os LLMs não eram adequados para tais tarefas devido à sua incapacidade de interpretar dados coletados por sensores.

A inteligência artificial também costuma exigir tempos de raciocínio mais longos, não conseguindo atingir velocidades de reação em nível de milissegundos – essenciais na guerra eletrônica.

Para evitar esses desafios, os cientistas terceirizaram o processamento de dados brutos para um modelo de aprendizado por reforço menos complexo. Esse algoritmo de IA tradicional se destaca na compreensão e análise de grandes quantidades de dados numéricos.

Os “parâmetros do vetor de valores de observação” extraídos desse processo preliminar são então convertidos em linguagem humana por meio de um tradutor automático. O modelo de linguagem de grande porte assume o controle, processando e analisando essas informações.

O compilador converte as respostas do modelo complexo em comandos de saída, que, em última instância, controlam o bloqueador de guerra eletrônica.

Segundo os pesquisadores, os resultados experimentais confirmaram a viabilidade da tecnologia. Com a ajuda de algoritmos de aprendizado por reforço, a IA generativa consegue ajustar rapidamente as estratégias de ataque até 10 vezes por segundo.

Em comparação com a IA tradicional e a experiência humana, o LLM é superior na criação de inúmeros alvos falsos nas telas de radar inimigas. Essa estratégia é considerada mais valiosa no campo da guerra eletrônica do que simplesmente bloquear com ruído ou desviar ondas de radar de alvos reais.

Fonte

![[Foto] Ajude urgentemente as pessoas a terem um lugar para morar e a estabilizarem suas vidas.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F09%2F1765248230297_c-jpg.webp&w=3840&q=75)

![[Foto] O Secretário-Geral To Lam trabalha com as Subcomissões dos Comitês Permanentes do 14º Congresso do Partido.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/09/1765265023554_image.jpeg)

Comentário (0)