Людям следует проявлять бдительность в отношении мошенничества, использующего технологию Deepfake для подделки видеозвонков . (Иллюстрация на фото)

Изощренные трюки

«Deepfake» — это сочетание «глубокого обучения» и «подделки», что является методом создания поддельных технологических продуктов в виде аудио, изображений или даже видео с помощью сложного искусственного интеллекта (ИИ). Deepfake — это технология, которая создает аудио, изображения и видеотехнологические продукты, которые подделывают реальные объекты с очень высокой точностью. На основе файла изображения лица и голоса реального человека Deepfake будет использовать алгоритмы для воссоздания лица и голоса, которые соответствуют чертам лица и выражениям другого человека, а затем создавать поддельное видео реального объекта.

Для совершения мошенничества и присвоения имущества пользователей социальных сетей сначала субъект создает поддельный аккаунт в социальной сети с той же информацией и фотографией профиля, что и у пользователя, или захватывает социальную сеть пользователя, затем собирает личную информацию, изображения, видео с голосом, публикует их в открытом доступе в аккаунте социальной сети, а затем использует технологию Deepfake для создания анимированных изображений и поддельных видео пользователя, общающегося в сети с тем же лицом, тоном голоса и формой обращения.

Или субъект создает фейковый аккаунт в социальной сети с той же информацией и фотографией профиля, что и у пользователя, подружился с жертвой в списке друзей и отправляет сообщения с просьбой занять денег по заранее разработанному сценарию. В некоторых случаях субъект захватывает аккаунт пользователя в социальной сети, чтобы напрямую отправить сообщение жертве в списке друзей. Чтобы завоевать доверие жертвы, субъект загружает доступные Deepfake-видео на канал видеозвонка, заставляя жертву узнавать изображение и голос знакомого и переводить деньги по запросу субъекта.

Благодаря технологии Deepfake поддельные видео обладают высокой точностью, что затрудняет различение настоящих и поддельных. Однако созданные субъектом видео часто имеют общее содержание, не полностью соответствующее реальному контексту общения с жертвой, что может вызвать у жертвы подозрения и обнаружить ее. Чтобы скрыть вышеуказанные недостатки, субъекты часто создают видео с плохо слышимым звуком, нечеткими изображениями, похожими на видеозвонки с нестабильным сигналом, совершаемые в зонах со слабым покрытием мобильной связи или Wi-Fi.

Повысить осведомленность

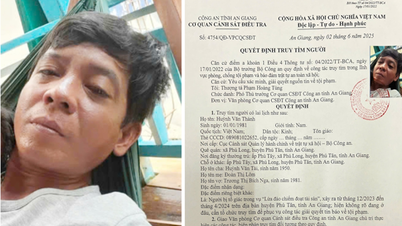

По данным провинциальной полиции, в последнее время в провинции Хотя Анзянг пока не обнаружил ни одного случая мошенничества с людьми и присвоения их имущества с использованием технологии Deepfake, прогнозируется, что в ближайшее время этот вид преступлений будет сильно развиваться, серьезно влияя на ситуацию с порядком и социальной безопасностью. В целях упреждающего предотвращения и борьбы с преступлениями, которые используют технологию Deepfake для мошенничества и присвоения имущества в этом районе, провинциальная полиция поручила полиции подразделений и населенных пунктов усилить пропаганду и распространять методы и уловки мошенничества и присвоения имущества путем поддельных видеозвонков агентствам, предприятиям и людям в этом районе... Кроме того, полиция подразделений и населенных пунктов хорошо организовала работу по приему сообщений и разоблачению преступлений; понимание ситуации, упреждающее выявление и пресечение деятельности с использованием киберпространства для мошенничества и присвоения имущества.

Для упреждающего предотвращения, обнаружения, борьбы, управления и пресечения этого типа преступлений председатель Народного комитета провинции Анзянг Нгуен Тхань Бинь поручил агентствам, подразделениям и населенным пунктам усилить пропаганду методов и уловок преступников, использующих технологию Deepfake для мошенничества и присвоения имущества через социальные сети, чтобы повысить осведомленность и бдительность среди должностных лиц, государственных служащих, государственных служащих, студентов, рабочих и масс в отношении этого типа преступлений. При получении любого сообщения или видеозвонка с нестабильным или нечетким сигналом для одалживания денег вам необходимо позвонить напрямую на номер телефона получателя для проверки, не звоните через приложения социальных сетей, такие как Zalo, Messenger, Viber, Telegram..., потому что эти учетные записи могут быть взломаны. В случае подозрения на выдачу себя за другое лицо с целью мошенничества или присвоения имущества вам необходимо немедленно сообщить в ближайшее отделение полиции для своевременной поддержки и обработки.

Полиция провинции заявила, что использование технологии Deepfake для поддельных видеозвонков с целью мошенничества и присвоения имущества является очень новым и сложным трюком. Поэтому людям рекомендуется быть бдительными при получении видеозвонков и проверять, обращаясь по номеру телефона телекоммуникационных сетей, чтобы проверить или связаться напрямую, чтобы подтвердить и получить деньги, чтобы избежать мошенничества и причинения ущерба имуществу.

Ссылка на источник

Комментарий (0)