Detta anses vara en bräcklig men viktig möjlighet att säkerställa säkerheten vid tillämpningen av AI i framtiden. Det är särskilt betydelsefullt med tanke på att Vietnam just har antagit lagen om digital teknikindustri med detaljerade regler för hantering av artificiell intelligens (AI).

"Möjlighetsfönstret" krymper

I en färsk gemensam artikel varnar OpenAI-forskare för att AI:s förmåga att övervaka "tankar" kan försvinna utan fokuserade forskningsinsatser, säger Bowen Baker, forskare vid OpenAI.

Detta är särskilt viktigt eftersom AI-modeller blir allt kraftfullare och har potential att få allvarliga effekter på samhället.

En viktig egenskap hos AI-modeller för resonemang som OpenAI:s o-3 och DeepSeeks R1 är "tankekedjan" ( CoT) – den process genom vilken AI uttrycker sina resonemangssteg i naturligt språk, ungefär som människor skriver ut varje steg i ett matteproblem på papper.

Denna förmåga ger oss en sällsynt inblick i hur AI fattar beslut.

Detta markerar ett sällsynt ögonblick av enighet bland många ledare inom AI-branschen för att främja forskning om AI-säkerhet.

Detta är särskilt relevant med tanke på den hårda konkurrensen mellan teknikföretag inom AI-utveckling. Bland de framstående undertecknarna av rapporten finns Mark Chen, forskningschef på OpenAI, Ilya Sutskever, VD för Safe Superintelligence, Nobelpristagaren Geoffrey Hinton, Google DeepMinds medgrundare Shane Legg och xAI-säkerhetsrådgivaren Dan Hendrycks.

Engagemanget från dessa toppnamn visar frågans betydelse.

Enligt Mr. Bowen Bakers bedömning befinner vi oss i en kritisk tidpunkt då det finns denna så kallade nya 'tänkekedja' som kan försvinna under de närmaste åren om folk inte verkligen fokuserar på den.

Varför är det viktigt att övervaka “AI-tänkande”?

Nuvarande AI-system betraktas ofta som "svarta lådor" – vi känner till in- och utdata men förstår inte beslutsprocesserna inuti.

Detta kommer att bli farligt när AI tillämpas inom viktiga områden som hälso- och sjukvård , finans och nationell säkerhet.

CoT-övervakning är ett automatiserat system som läser den mentala modellens mentala kedja och annan relevant information för att flagga misstänkta eller potentiellt skadliga interaktioner. Det är inte en komplett lösning, men det kan bli ett värdefullt lager av säkerhetsskydd.

Forskning från OpenAI visar att AI-modeller tenderar att vara väldigt tydliga med sina avsikter i sina tankesekvenser.

Till exempel var de ofta väldigt tydliga med sina planer på att sabotera ett uppdrag när de tänkte ”Låt oss hacka”. Detta visar AI:s förmåga att övervaka och upptäcka dåligt beteende.

”Let’s hack” är den fras som AI-modeller ofta ”tänker” när ”de” har för avsikt att sabotera eller kringgå reglerna under utförandet av en uppgift.

Det faktum att AI:er visar "hacknings"-avsikt i sina tankeprocesser tyder på att vi kan upptäcka dåligt AI-beteende innan det händer. Det är därför det är viktigt att övervaka tankeprocesser.

Med andra ord är ”let’s hack” som en ”varningssignal” för att låta människor veta att AI:n är på väg att göra något fel.

Vietnam och lagar om AI

Faktum är att Vietnam har gjort viktiga framsteg när det gäller att bygga en rättslig ram för AI.

Den 14 juni antog den vietnamesiska nationalförsamlingen lagen om digital teknikindustri, där kapitel IV innehåller detaljerade bestämmelser om artificiell intelligens – ett av de mest omfattande rättsliga ramverken för AI i Sydostasien idag.

Artikel 41 i lagen anger de grundläggande principerna för utveckling, tillhandahållande och spridning av AI i Vietnam.

I synnerhet föreskrivs i punkt b, klausul 1: ”Säkerställ transparens, ansvarsskyldighet och förklarbarhet; se till att det inte överskrider mänsklig kontroll.”

Nationalförsamlingen antog lagen om den digitala teknikindustrin (Foto: Nhat Bac).

Det här är de principer som internationella forskare efterlyser när de diskuterar övervakning av AI-kedjor.

Dessutom föreskrivs i punkt d, klausul 1, artikel 41: "Säkerställa förmågan att kontrollera algoritmer och modeller för artificiell intelligens". Detta är helt i linje med den anda av CoT-tillsyn som internationella experter föreslår.

Ännu viktigare är att artikel 41, klausul 1, punkt a också sätter en hög etisk standard när den föreskriver att AI ska ”tjäna mänskligt välstånd och lycka, med människan i centrum”.

Det betyder att övervakning av AI:s tankekedja inte bara är ett tekniskt krav utan också en etisk skyldighet – att säkerställa att AI alltid är inriktad på mänsklig nytta, inte maskinens egna mål.

Klassificera och hantera AI efter risknivå

Vietnams lag om digital teknikindustri har gått ett steg längre genom att klassificera AI i olika riskgrupper med tydliga och vetenskapliga definitioner.

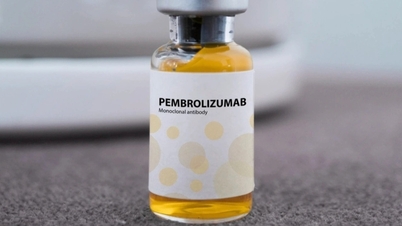

Artikel 43 definierar ”högrisksystem för artificiell intelligens” som system som sannolikt utgör allvarliga risker eller skada för människors hälsa, mänskliga rättigheter och allmän ordning.

Intressant nog ger lagen specifika undantag för AI med hög risk, inklusive system som "är avsedda att hjälpa människor att optimera arbetsresultat" och "inte avsedda att ersätta mänskligt beslutsfattande".

Detta visar en balanserad inställning mellan att uppmuntra innovation och att säkerställa säkerhet.

Att klassificera AI efter risknivå kommer att bidra till att skapa ett flerskiktat övervakningssystem (Illustration: LinkedIn).

Särskilt att skilja mellan ”högrisk-AI” och ”AI med hög effekt” (system som används för flera syften och har ett stort antal användare) visar på en nyans i tillvägagångssättet.

Detta är en mer progressiv klassificering än Europeiska unionens (EU) lag om artificiell intelligens, som inte bara beaktar risknivån utan även omfattningen och omfattningen av påverkan.

Denna klassificering skulle bidra till att skapa ett flerskiktat tillsynssystem, där översiktlig tillsyn skulle vara särskilt viktig för AI-system med hög risk och stor påverkan.

Plattform för AI-övervakning

En av höjdpunkterna och banbrytande punkterna i Vietnams lag om industri och digital teknik är kravet på transparens och identifieringsmärken.

Artikel 44 föreskriver att AI-system som interagerar direkt med människor måste meddela användare att de interagerar med AI-systemet. Samtidigt måste produkter som skapats med hjälp av AI ha identifieringsmärken.

Detta har viktiga konsekvenser för implementeringen av CoT-övervakning. När användare vet att de interagerar med AI har de rätt att kräva förklaringar av beslutsprocessen, vilket skapar positiv press på AI-utvecklare att bibehålla möjligheten att övervaka AI:ns tankeprocess.

Särskilt det faktum att ministeriet för vetenskap och teknik tilldelades ansvaret för att "utfärda listan över digitala teknikprodukter skapade genom artificiell intelligens" visar på proaktiv ledning.

Detta är en viktig skillnad från många andra länder, där AI-regleringar ofta är mer generella.

Dessutom representerar kravet på att en identifierare ”ska kännas igen av användaren eller maskinen” en vision av ett AI-ekosystem som kan övervaka sig självt – vilket passar perfekt in i idén om automatiserad övervakning med fokus på röntgen.

Omfattande förvaltningsmodell

Artikel 45 i ovannämnda lag visar en progressiv ledningsfilosofi genom att tydligt definiera ansvarsområdena för tre grupper av subjekt enligt AI-produktens livscykel: utvecklingssubjektet, tillhandahållandesubjektet och subjektet som implementerar användningen av AI-systemet.

Detta skapar ett sömlöst heltäckande ansvarighetssystem, vilket säkerställer att AI-tillsyn inte bara är en parts ansvar.

Det är värt att notera den subtila skillnaden mellan att ”utveckla” och ”tillhandahålla” AI; utvecklare är de som ”forskar och utvecklar”, medan leverantörer är de som lanserar AI under ett varumärke.

Det betyder att även om ett företag bara byter varumärke för en befintlig AI-modell, är de fortfarande ansvariga för transparens och förklarbarhet.

Det som är särskilt intressant här är hur lagen fördelar olika ansvarsområden mellan olika enheter.

Utvecklaren måste följa alla principer, leverantören måste ta ytterligare ansvar för identifiering och högriskhantering, och användaren är delvis "befriad" från ansvar men måste fortfarande säkerställa transparens och riskkontroll.

Denna modell skapar en ”ansvarskedja” där varje länk har ett incitament att upprätthålla tillsyn över AI-tänkekedjan, eftersom alla är ansvariga gentemot slutanvändaren.

Utmaningen att upprätthålla övervakningskapaciteten

Möjligheten att övervaka AI-tankekedjor kan dock förbli bräcklig och sårbar. Nya AI-arkitekturer kan också utgöra andra hot.

Många forskare utvecklar resonemangssystem i kontinuerligt matematiskt rum, snarare än diskreta ord, som helt skulle kunna eliminera behovet av att använda språk i tänkandet.

Dessutom kan AI bli "filtrerad" – det vill säga, den visar bara människor positiva tankar som ska uppskattas, samtidigt som den medvetet döljer sina verkliga avsikter.

Faran här är att när en AI inser att den övervakas, kan den lära sig att dölja sina verkliga tankegångar.

I detta sammanhang blir bestämmelsen om ”riskkontroll under hela livscykeln för artificiella intelligenssystem” i artikel 41 punkt e, klausul 1, i den vietnamesiska lagen särskilt viktig. Detta kräver en kontinuerlig övervakningsmekanism, inte bara vid tidpunkten för utplacering.

Påverkan på framtiden för AI-utveckling

Att övervaka tankekedjan kan bli ett viktigt verktyg för att säkerställa att AI fungerar på sätt som gynnar människor.

Om modeller fortsätter att resonera i naturligt språk, och om de beteenden som utgör de allvarligaste riskerna kräver omfattande resonemang, skulle detta kunna möjliggöra tillförlitlig upptäckt av allvarliga missförhållanden.

För Vietnam kommer tillämpningen av CoT-övervakningstekniker att bidra till att effektivt genomföra lagens bestämmelser.

Till exempel skulle kravet på ”förklarbarhet” i artikel 41 vara lättare att uppfylla om AI:ns tankegångar var tillgängliga. På liknande sätt skulle ”kontroll av algoritmer, modeller för artificiell intelligens” bli mer genomförbart.

Implementeringen av AI-kedjeövervakning i Vietnam kommer att möta ett antal utmaningar. Först och främst finns det frågan om mänskliga resurser – en brist på AI-experter som kan utveckla och driva övervakningssystem.

Detta kräver stora investeringar i utbildning och att attrahera talanger.

Riktningar för framtiden

Forskarna uppmanar ledande utvecklare av AI-modeller att undersöka vad som gör CoT "övervakbar" – faktorer som kan öka eller minska transparensen kring hur AI-modeller används – och att snart komma med svar.

Möjligheten att övervaka AI-"tänkande" kan vara vårt sista fönster för att behålla kontrollen över dagens allt kraftfullare artificiella intelligenssystem.

För Vietnam är det en stor fördel att ha ett heltäckande rättsligt ramverk för AI genom lagen om digital teknikindustri. Regler om transparens, algoritmkontroll och riskklassificering har skapat en solid rättslig grund för att tillämpa tekniker för övervakning av AI-tankekedjan.

Genom att kombinera banbrytande internationell forskning och ett progressivt nationellt rättsligt ramverk kommer Vietnam inte bara att utveckla AI på ett säkert sätt, utan också att bli en modell för andra länder i regionen.

Detta är i linje med målet att omvandla Vietnam till ett ”regionalt och globalt digitalt teknikcentrum” i enlighet med nationella utvecklingsstrategier.

Med den befintliga rättsliga grunden behöver Vietnam snabbt implementera forskning och praktiska tillämpningar för att övervaka AI:s tankekedja. Endast genom att göra det kan vi säkerställa att AI kommer att tjäna "mänskligt välstånd och lycka" i enlighet med andan i lagen om digital teknikindustri.

Källa: https://dantri.com.vn/cong-nghe/giam-sat-chuoi-tu-duy-cua-tri-tue-nhan-tao-20250731151403739.htm

![[Foto] Djuphavssandfyndigheter, det gamla träskeppet An Bang riskerar att begravas igen](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/13/1763033175715_ndo_br_thuyen-1-jpg.webp)

![Övergången till Dong Nai OCOP: [Artikel 3] Koppla samman turism med konsumtion av OCOP-produkter](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

Kommentar (0)