ยักษ์ใหญ่ด้านเทคโนโลยีทุ่มเงินนับพันล้านดอลลาร์เพื่อความเชื่อมั่นที่ว่า “มากขึ้นคือดีขึ้น” ในด้านปัญญาประดิษฐ์ (AI)

อย่างไรก็ตาม ความก้าวหน้าของ DeepSeek แสดงให้เห็นว่าโมเดลที่มีขนาดเล็กกว่าสามารถให้ประสิทธิภาพที่ใกล้เคียงกันโดยมีต้นทุนต่ำกว่ามาก

ในช่วงปลายเดือนมกราคม DeepSeek ได้ประกาศว่าค่าใช้จ่ายขั้นสุดท้ายในการฝึกโมเดล R1 อยู่ที่เพียง 5.6 ล้านเหรียญสหรัฐ ซึ่งเป็นเพียงเศษเสี้ยวของราคาที่บริษัทในสหรัฐฯ เรียกเก็บ

“โจรสลัดเทคโนโลยี”

การก้าวกระโดดของ DeepSeek สู่ตำแหน่งผู้ผลิต AI ชั้นนำได้กระตุ้นให้เกิดการอภิปรายอย่างดุเดือดในซิลิคอนวัลเลย์เกี่ยวกับกระบวนการที่เรียกว่า "การกลั่น"

นี่คือเทคนิคที่อ้างอิงถึงการเรียนรู้ระบบใหม่จากระบบที่มีอยู่โดยการถามคำถามหลายแสนคำถามและวิเคราะห์คำตอบ

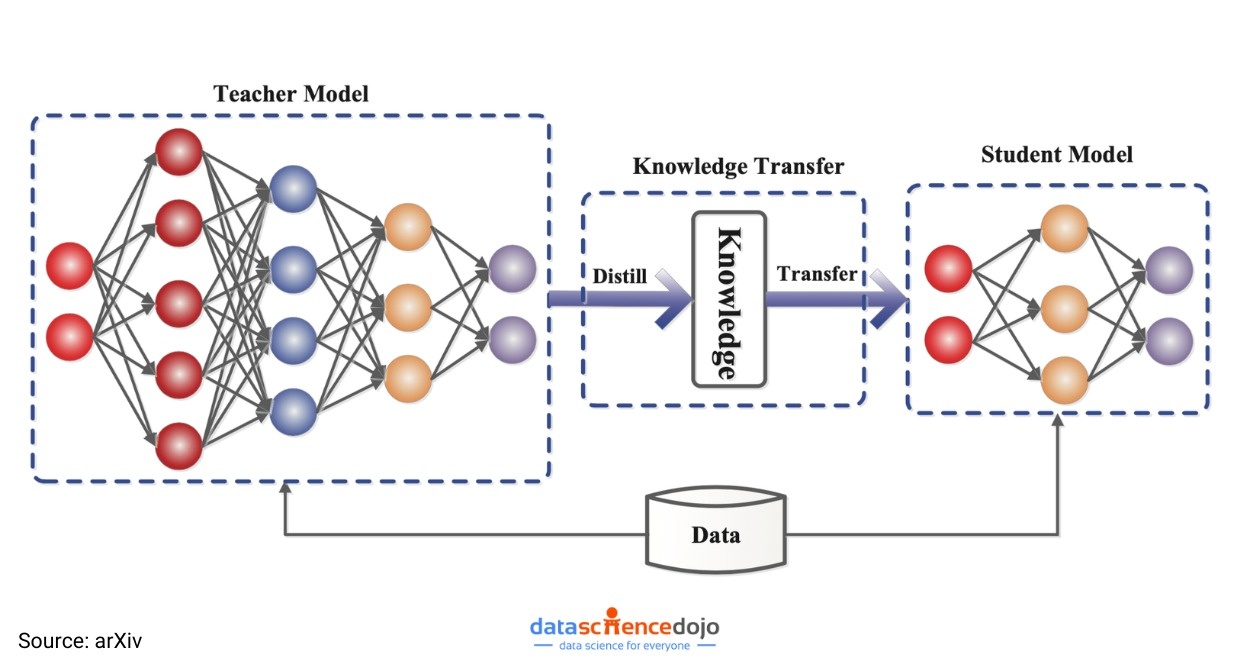

โดยการกลั่นกรอง บริษัทต่างๆ จะนำแบบจำลองภาษาขนาดใหญ่ (LLM) ที่เรียกว่าแบบจำลอง “ครู” มาใช้ แบบจำลองนี้จะสามารถคาดการณ์คำต่อไปที่มีแนวโน้มที่จะปรากฏในประโยคมากที่สุด

แบบจำลองครูจะสร้างข้อมูลซึ่งจะนำไปใช้ในการฝึกแบบจำลอง "นักเรียน" ขนาดเล็ก กระบวนการนี้ทำให้สามารถถ่ายโอนความรู้และความสามารถในการทำนายจากแบบจำลองขนาดใหญ่ไปยังแบบจำลองขนาดเล็กได้อย่างรวดเร็ว

|

แทนที่จะทุ่มเงินหลายพันล้านดอลลาร์ในการฝึกโมเดล เทคนิค "การกลั่น" ช่วยให้ DeepSeek สามารถบรรลุผลลัพธ์เดียวกันได้โดยเพียงแค่เรียนรู้จากโมเดลที่มีอยู่ขนาดใหญ่ ภาพ: Mint |

แม้ว่าการกลั่นจะถูกนำมาใช้กันอย่างแพร่หลายมานานหลายปีแล้ว แต่ความก้าวหน้าล่าสุดทำให้ผู้เชี่ยวชาญในอุตสาหกรรมเชื่อว่าการกลั่นจะกลายเป็นข้อได้เปรียบที่สำคัญสำหรับบริษัทสตาร์ทอัพอย่าง DeepSeek มากยิ่งขึ้น

ไม่เหมือนกับยักษ์ใหญ่ในอุตสาหกรรมอย่าง OpenAI บริษัทเหล่านี้มักมองหาโซลูชันที่คุ้มต้นทุนเพื่อพัฒนาแอปพลิเคชันที่ใช้ AI

Olivier Godement หัวหน้าฝ่ายผลิตภัณฑ์ของ OpenAI กล่าวว่า "การกลั่นเป็นกระบวนการที่มหัศจรรย์มาก เป็นกระบวนการนำโมเดลขอบอัจฉริยะขนาดใหญ่มาใช้ฝึกโมเดลขนาดเล็ก กระบวนการนี้มีประสิทธิภาพมากสำหรับงานเฉพาะ ราคาถูกมาก และดำเนินการได้รวดเร็วมาก"

เครื่องหมายคำถามเกี่ยวกับประสิทธิภาพของเงินทุนมูลค่าหลายพันล้านดอลลาร์

LLM เช่น GPT-4, Gemini (Google) หรือ Llama (Meta) ของ OpenAI มีชื่อเสียงในด้านการใช้ข้อมูลและพลังการประมวลผลจำนวนมหาศาลเพื่อการพัฒนาและบำรุงรักษา

ถึงแม้ว่าบริษัทต่างๆ จะไม่ได้เปิดเผยต้นทุนที่ชัดเจน แต่คาดว่าการฝึกอบรมโมเดลเหล่านี้อาจมีค่าใช้จ่ายสูงถึงหลายร้อยล้านดอลลาร์

ในจำนวนนี้มีทั้ง Google, OpenAI, Anthropic และ xAI ของ Elon Musk หลังจากที่ทรัมป์เข้ารับตำแหน่ง OpenAI ได้ประกาศความร่วมมือกับ SoftBank และพันธมิตรรายอื่นๆ เพื่อลงทุน 500,000 ล้านดอลลาร์ ในโครงสร้างพื้นฐานด้าน AI ในอีก 5 ปีข้างหน้า

อย่างไรก็ตาม ด้วยการกลั่นกรอง นักพัฒนาและธุรกิจสามารถเข้าถึงความสามารถอันทรงพลังของโมเดลขนาดใหญ่ได้ในราคาเพียงเศษเสี้ยวเดียว ซึ่งช่วยให้แอปพลิเคชัน AI ทำงานได้อย่างรวดเร็วบนอุปกรณ์ เช่น แล็ปท็อปหรือสมาร์ทโฟน

|

แบบจำลองของเทคนิค "การกลั่น" ในการฝึกโมเดล AI ภาพ: arXiv |

ในความเป็นจริง WSJ แนะนำว่าหลังจากความสำเร็จของ DeepSeek ผู้บริหารและนักลงทุนใน Silicon Valley กำลังคิดทบทวนรูปแบบธุรกิจของตนเองและตั้งคำถามว่าความเป็นผู้นำในอุตสาหกรรมนั้นยังคุ้มค่าอยู่หรือไม่

Mike Volpi ผู้บริหารด้านเทคโนโลยีและนักลงทุนเสี่ยงที่ Hanabi Capital ตั้งคำถามว่า "คุ้ม ทางเศรษฐกิจ หรือไม่ที่จะเป็นคนแรกในเมื่อต้นทุนแพงกว่าผู้ติดตามถึงแปดเท่า"

CIO คาดหวังว่าจะได้เห็นแอปพลิเคชัน AI คุณภาพสูงจำนวนมากที่ถูกสร้างขึ้นโดยใช้เทคนิค "การกลั่น" ในอีกไม่กี่ปีข้างหน้า

โดยเฉพาะอย่างยิ่ง นักวิจัยจากบริษัท AI Hugging Face ได้เริ่มพยายามสร้างแบบจำลองที่คล้ายกับของ DeepSeek “สิ่งที่จำลองได้ง่ายที่สุดคือกระบวนการกลั่น” Lewis Tunstall นักวิจัยอาวุโสกล่าว

โมเดล AI จาก OpenAI และ Google ยังคงเป็นผู้นำในการจัดอันดับที่ใช้กันอย่างแพร่หลายใน Silicon Valley

ยักษ์ใหญ่ด้านเทคโนโลยีสามารถรักษาความได้เปรียบในระบบที่ล้ำหน้าที่สุดได้ด้วยการทำการวิจัยที่แปลกใหม่ที่สุด อย่างไรก็ตาม ผู้บริโภคและธุรกิจจำนวนมากก็เต็มใจที่จะยอมรับเทคโนโลยีที่ด้อยกว่าเล็กน้อยในราคาที่ถูกกว่ามาก

|

เทคนิคการ "กลั่น" ไม่ใช่แนวคิดใหม่ แต่ความสำเร็จของ DeepSeek พิสูจน์ให้เห็นว่าโมเดล AI ต้นทุนต่ำยังคงมีประสิทธิภาพเท่ากับโมเดลที่ราคาหลายพันล้านดอลลาร์ ภาพ: Shutterstock |

แม้ว่าการกลั่นสามารถผลิตโมเดลที่มีการทำงานที่ดีได้ แต่ผู้เชี่ยวชาญหลายรายก็เตือนว่าการกลั่นยังมีข้อจำกัดบางประการอีกด้วย

“การกลั่นเป็นการแลกเปลี่ยนที่น่าสนใจ เมื่อคุณทำให้โมเดลมีขนาดเล็กลง ความสามารถของมันก็จะลดลงอย่างหลีกเลี่ยงไม่ได้” Ahmed Awadallah จาก Microsoft Research อธิบาย

ตามที่ Awadallah กล่าวไว้ โมเดลการกลั่นกรองนั้นดีมากสำหรับการสรุปอีเมล แต่ในเวลาเดียวกัน มันก็ไม่ได้ดีสำหรับงานอื่นเลย

ในขณะเดียวกัน เดวิด ค็อกซ์ รองประธานฝ่ายการสร้างแบบจำลอง AI ของ IBM Research กล่าวว่าธุรกิจส่วนใหญ่ไม่จำเป็นต้องมีโมเดลขนาดใหญ่เพื่อรันผลิตภัณฑ์ของตน

ปัจจุบันโมเดลที่กลั่นออกมามีประสิทธิภาพเพียงพอที่จะรองรับวัตถุประสงค์ต่างๆ เช่น แชทบอทสำหรับการบริการลูกค้าหรือทำงานบนอุปกรณ์ขนาดเล็กอย่างโทรศัพท์

ค็อกซ์กล่าวเสริมว่า "ทุกครั้งที่คุณสามารถลดต้นทุนได้พร้อมๆ กับยังคงได้รับประสิทธิภาพตามที่ต้องการ ก็ไม่มีเหตุผลใดที่จะไม่ทำเช่นนั้น"

ที่มา: https://znews.vn/ky-thuat-chung-cat-ai-dang-dat-ra-cau-hoi-lon-post1535517.html

การแสดงความคิดเห็น (0)