ตามรายงานของ VNA ญี่ปุ่นจะจัดตั้งหน่วยงานใหม่ที่มีหน้าที่พัฒนามาตรฐานความปลอดภัยสำหรับปัญญาประดิษฐ์ (AI) เพื่อตอบสนองต่อความเสี่ยง เช่น การใช้ AI ในทางที่ผิดเพื่อสร้างเนื้อหาปลอมและเผยแพร่ข้อมูลเท็จที่เกิดขึ้นบ่อยครั้งมากขึ้น

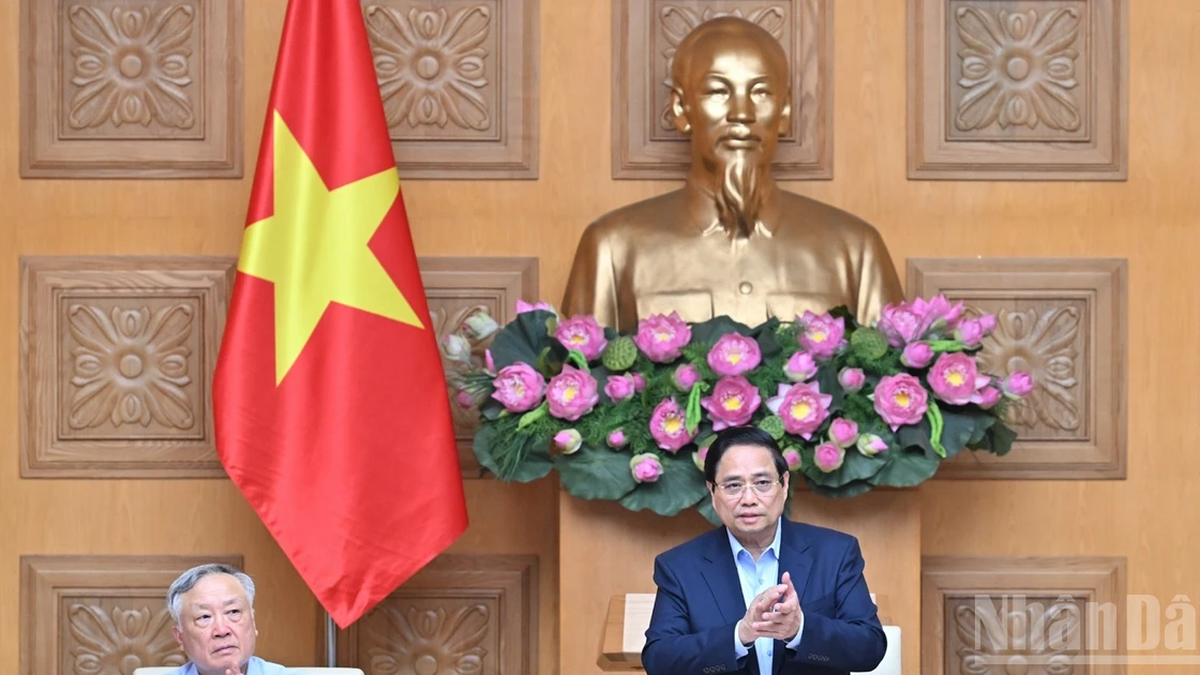

ข้อมูลข้างต้นได้รับการประกาศโดย นายกรัฐมนตรี ฟูมิโอะ คิชิดะในการประชุมสภากลยุทธ์ AI ที่จัดขึ้นเมื่อวันที่ 21 ธันวาคม ณ กรุงโตเกียว

คาดว่าองค์กรใหม่จะได้รับการจัดตั้งขึ้นในเดือนมกราคม พ.ศ. 2567 ภายใต้ชื่อ “สถาบันความปลอดภัย AI” (AISI) ภายใต้หน่วยงานส่งเสริมเทคโนโลยีสารสนเทศ (IPA) กระทรวง เศรษฐกิจ การค้า และอุตสาหกรรมของญี่ปุ่น (METI)

AISI จะประกอบด้วยผู้เชี่ยวชาญด้าน AI และความปลอดภัยทางไซเบอร์ ซึ่งรับผิดชอบในการกำหนดมาตรฐานการประเมินความปลอดภัยสำหรับบริษัทที่พัฒนา AI และตรวจสอบความเสี่ยงจากการใช้ AI ในทางที่ผิด

ในการประชุมครั้งนี้ สภา AI ยังได้หารือเกี่ยวกับ “แนวปฏิบัติด้าน AI” ซึ่งประกอบด้วยหลักการ 10 ประการ โดยเรียกร้องให้บริษัทในประเทศให้ความสำคัญกับผู้คนเป็นศูนย์กลางเมื่อพัฒนาหรือใช้ AI

ตามแผน “แนวปฏิบัติด้าน AI” จะได้รับการอนุมัติอย่างเป็นทางการในเดือนมีนาคม 2024 โดยใช้ได้กับนักพัฒนา ผู้ให้บริการ AI และผู้ใช้

หลักการใน “แนวปฏิบัติด้าน AI” สร้างขึ้นจาก “กระบวนการ AI ฮิโรชิม่า” ของกลุ่มประเทศ G7 เพื่อพัฒนากฎเกณฑ์ระหว่างประเทศ

สอดคล้องกับหลักการที่ยึดมนุษย์เป็นศูนย์กลาง แนวปฏิบัตินี้เรียกร้องให้บริษัทต่างๆ เคารพสิทธิมนุษยชนและความหลากหลาย ดำเนินมาตรการเพื่อต่อต้านข้อมูลที่ผิดพลาด และงดเว้นการพัฒนา จัดหา และใช้งานบริการ AI ที่บิดเบือนการตัดสินใจและอารมณ์ของมนุษย์ในทางลบโดยเด็ดขาด นอกจากนี้ แนวปฏิบัติยังครอบคลุมหลักการอื่นๆ เช่น การปกป้องความเป็นส่วนตัว การรับรองความเป็นธรรม ความปลอดภัย และความโปร่งใส

ก่อนหน้านี้ในเดือนตุลาคม นายกรัฐมนตรีริชี ซูนัคของอังกฤษประกาศว่าสหราชอาณาจักรจะจัดตั้งสถาบันความปลอดภัยด้านปัญญาประดิษฐ์ (AI Safety Institute) แห่งแรกของโลก เพื่อทดสอบ ประเมิน และทดสอบรูปแบบใหม่ๆ ของ AI จากนั้นหน่วยงานกำกับดูแลจะสามารถเข้าถึงความสามารถของ AI แต่ละรูปแบบใหม่ และสามารถระบุความเสี่ยงทั้งหมด ตั้งแต่อันตรายทางสังคม เช่น อคติและข้อมูลที่ผิดพลาด ไปจนถึงความเสี่ยงสูงสุด

หลังจากนั้นไม่นาน รัฐมนตรีว่าการกระทรวงพาณิชย์สหรัฐฯ จีนา ไรมอนโด ได้ประกาศว่าสหรัฐฯ จะจัดตั้งสถาบันความปลอดภัย AI โดยจะทำงานร่วมกับสถาบันมาตรฐานและเทคโนโลยีแห่งชาติ เพื่อรับรองความปลอดภัยและความน่าเชื่อถือของปัญญาประดิษฐ์

ในยุคปัจจุบัน เครื่องมือปัญญาประดิษฐ์ได้สร้างความก้าวหน้าครั้งใหม่ท่ามกลางกระแสการลงทุนด้านเทคโนโลยี อย่างไรก็ตาม ผู้เชี่ยวชาญด้านเทคโนโลยีตั้งข้อสังเกตว่าปัญญาประดิษฐ์เต็มไปด้วยความเสี่ยงและความท้าทายมากมาย โดยมีความกังวลเกี่ยวกับระดับความน่าเชื่อถือที่เกี่ยวข้องกับข้อมูล อัลกอริทึม และแอปพลิเคชัน

ดังนั้น เพื่อให้ได้รับประโยชน์สูงสุดจากปัญญาประดิษฐ์ จึงมีความสำคัญอย่างยิ่งที่จะต้องสร้างความเชื่อมั่นให้กับสาธารณชนว่าเทคโนโลยีนี้ได้รับการพัฒนาและใช้งานอย่างมีความรับผิดชอบ

ล่าสุด 18 ประเทศ ได้แก่ สหรัฐอเมริกา สหราชอาณาจักร เยอรมนี อิตาลี สาธารณรัฐเช็ก โปแลนด์ ออสเตรเลีย ชิลี สิงคโปร์... ได้ลงนามข้อตกลงเพื่อส่งเสริมให้ภาคธุรกิจสร้างระบบปัญญาประดิษฐ์ที่ปลอดภัยตั้งแต่ขั้นตอนการออกแบบ เพื่อหลีกเลี่ยงความเสี่ยงที่จะถูกนำไปใช้ในทางที่ผิด

นี่ถือเป็นความคิดริเริ่มล่าสุดในชุดความคิดริเริ่มของรัฐบาลทั่วโลกที่มุ่งกำหนดทิศทางการพัฒนาปัญญาประดิษฐ์ ซึ่งส่งผลกระทบต่ออุตสาหกรรมและสังคมโดยรวมเพิ่มมากขึ้นเรื่อยๆ

มินห์ ฮวา (t/h)

แหล่งที่มา

![[ภาพ] ประธานรัฐสภาเข้าร่วมสัมมนา “การสร้างและดำเนินงานศูนย์การเงินระหว่างประเทศและข้อเสนอแนะสำหรับเวียดนาม”](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/7/28/76393436936e457db31ec84433289f72)

การแสดงความคิดเห็น (0)