За даними BGR , 2024 рік стане переломним для світу , щоб усвідомити, чи є штучний інтелект справді майбутнім обчислювальної техніки, чи просто швидкоплинною примхою. Хоча справжні застосування ШІ стають дедалі різноманітнішими, темна сторона цієї технології також буде розкрита через незліченну кількість шахрайств у найближчі місяці.

Експерти Scams.info з боротьби з шахрайством щойно опублікували список із 3 шахрайств на основі штучного інтелекту, яких людям слід остерігатися у 2024 році. Загальне правило полягає в тому, що слід бути обережним з усім, що виглядає надто гламурно, але наведені нижче схеми вимагають особливої підвищеної пильності.

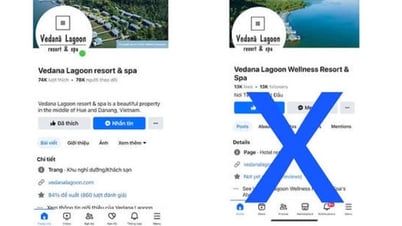

Інвестиційні шахрайства на основі штучного інтелекту

Такі великі гравці, як Google, Microsoft та OpenAI, вклали мільйони доларів у штучний інтелект і продовжуватимуть інвестувати значні кошти цього року. Шахраї скористаються цим фактом, щоб спонукати вас інвестувати в сумнівні можливості. Якщо хтось у соціальних мережах намагається переконати вас, що штучний інтелект примножить ваші інвестиційні прибутки, подумайте двічі, перш ніж відкривати свій гаманець.

«Вигідні угоди» та низькоризикові інвестиції насправді ніколи не існують.

«Ставтеся обережними з інвестиціями, які обіцяють високу прибутковість з низьким ризиком, і обов’язково проведіть ретельне дослідження, перш ніж вкладати в них свої гроші», – попереджає експерт Ніколас Крауч зі Scams.info. Новим інвесторам також слід бути обережними з пропозиціями, які вимагають від них залучення нових учасників; вони часто працюють за моделлю багаторівневого маркетингу (MLM), приносячи користь лише тим, хто знаходиться на вершині, тоді як інші учасники рідко отримують вигоду.

Видаючи себе за родича

Шахрайство, коли хтось видає себе за друзів чи родичів, щоб позичити гроші, не є чимось новим, оскільки імітація голосу не дуже ефективна. Однак, завдяки штучному інтелекту, цей тип шахрайства стає набагато підступнішим. Все, що потрібно, це відео на YouTube або публікація у Facebook, що містить голос родича, і шахрай може за допомогою штучного інтелекту ідеально його відтворити. Чи можна помітити різницю під час телефонної розмови?

Штучний інтелект може легко імітувати голоси ваших близьких.

Скріншот з Washington Post

«Вкрай важливо, щоб люди захищали свої облікові записи в соціальних мережах, щоб запобігти збору шахраями голосових записів та інформації про сім’ю», – наголосив Крауч.

Використання голосових команд для обходу систем безпеки.

Деякі банки використовують розпізнавання голосу для перевірки користувачів під час проведення транзакцій по телефону. З вищезазначених причин цей метод раптово став менш безпечним, ніж раніше. Якщо ви публікуєте відео чи кліпи, що містять ваш голос, будь-де в Інтернеті, зловмисники можуть використовувати цей контент, щоб скопіювати ваш голос. Як зазначає Крауч, банки все ще мають інші дані для перевірки особи клієнтів, але ця тактика наближає злочинців до крадіжки вашого банківського рахунку.

Системи безпеки на основі голосового керування більше не захищені від впливу штучного інтелекту.

Штучний інтелект має потенціал докорінно змінити наше життя та те, як ми взаємодіємо з пристроями. Це також новітній інструмент, який хакери та шахраї використовуватимуть для атак на користувачів. Тому вкрай важливо залишатися пильними та проводити ретельне дослідження, перш ніж займатися будь-якою діяльністю, пов’язаною зі штучним інтелектом.

Посилання на джерело

![[Фото] Генеральний секретар і президент То Лам зустрівся з делегатами Національних зборів від етнічних меншин.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/20/1776696701056_a1-bnd-8331-3342-jpg.webp)

![[Зображення] Національні збори обговорюють виконання плану соціально-економічного розвитку.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/20/1776696707422_ndo_br_img-20260420-185419-jpg.webp)

Коментар (0)