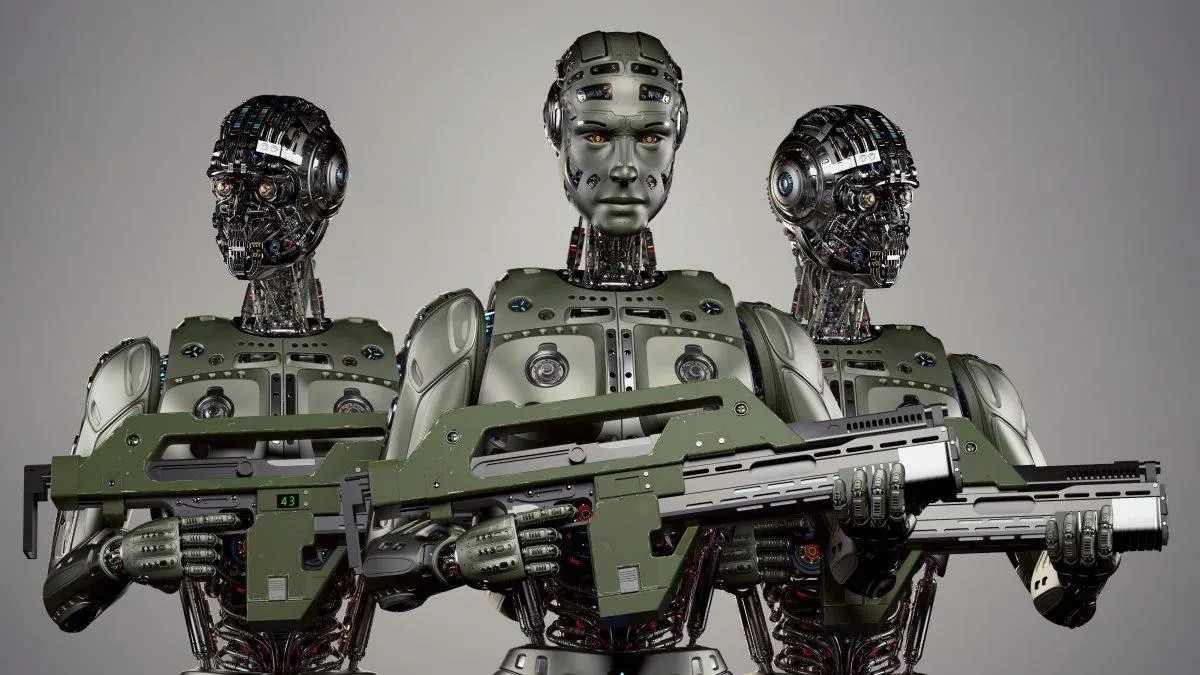

AI قاتل روبوٹس کے استعمال کی پیچیدہ تصویر

AI کو ہتھیاروں کے نظام کو کنٹرول کرنے کی اجازت دینے کا مطلب یہ ہو سکتا ہے کہ انسانی مداخلت کے بغیر اہداف کی شناخت، حملہ اور تباہ کر دیا جائے۔ اس سے سنگین قانونی اور اخلاقی سوالات اٹھتے ہیں۔

صورتحال کی سنگینی پر روشنی ڈالتے ہوئے، آسٹریا کے وزیر خارجہ الیگزینڈر شلنبرگ نے کہا: "یہ ہماری نسل کا اوپن ہائیمر لمحہ ہے۔"

مصنوعی ذہانت کا استعمال کرتے ہوئے روبوٹس اور ہتھیار کئی ممالک کی فوجوں میں بڑے پیمانے پر استعمال ہونے لگے ہیں۔ تصویر: فوربس

درحقیقت، جس حد تک "جن بوتل سے فرار ہو گیا ہے" ایک اہم سوال بن گیا ہے، کیونکہ ڈرون اور مصنوعی ذہانت (AI) دنیا بھر کی فوجوں کے ذریعے بڑے پیمانے پر استعمال ہو چکی ہے۔

"روس اور یوکرین کی طرف سے جدید تنازعات میں ڈرونز کا استعمال، افغانستان اور پاکستان میں ٹارگٹڈ اسٹرائیک آپریشنز میں امریکہ کی طرف سے ڈرون کا استعمال اور جیسا کہ حال ہی میں پچھلے مہینے اسرائیل کے لیونڈر پروگرام کے ایک حصے کے طور پر انکشاف ہوا ہے، یہ ظاہر کرتا ہے کہ کس طرح AI کی معلومات کی پروسیسنگ کی صلاحیتوں کو دنیا کی فوجیں اپنی جارحانہ طاقت کو بڑھانے کے لیے فعال طور پر استعمال کر رہی ہیں،" GlobalData Defence an نے کہا۔

لندن میں واقع آفس آف وار انویسٹی گیٹو جرنلزم کی تحقیقات سے پتا چلا ہے کہ اسرائیلی فوج کے لیونڈر اے آئی سسٹم میں حماس سے تعلق رکھنے والے افراد کی شناخت میں 90 فیصد درستگی کی شرح تھی، یعنی 10 فیصد نہیں تھی۔ اس کے نتیجے میں AI کی شناخت اور فیصلہ سازی کی صلاحیتوں کی وجہ سے شہری ہلاکتیں ہوئیں۔

عالمی سلامتی کے لیے خطرہ

اس طرح AI کا استعمال ہتھیاروں کے نظام میں ٹیکنالوجی کو منظم کرنے کی ضرورت پر زور دیتا ہے۔

"ہتھیاروں کے نظام میں AI کا استعمال، خاص طور پر جب نشانہ بنانے کے لیے استعمال کیا جاتا ہے، ہمارے بارے میں بنیادی سوالات پیدا کرتا ہے - انسانوں - اور جنگ سے ہمارے تعلقات، اور خاص طور پر اس بارے میں ہمارے مفروضے کہ ہم مسلح تنازعات میں تشدد کو کس طرح استعمال کر سکتے ہیں،" ڈاکٹر الیگزینڈر بلانچارڈ، گورننس آف آرٹیفیشل انٹیلی جنس پروگرام میں سینئر ریسرچ فیلو، اسٹاک ہوم میں ریسرچ انسٹی ٹیوٹ انٹرنیشنل پیس (پیس پی آر آئی) پر فوکس ریسرچ انسٹی ٹیوٹ، گلوبل سیکیورٹی گروپ، فوکس آرمی ٹیکنالوجی کو.

AI نظام، جب افراتفری والے ماحول میں استعمال ہوتے ہیں، غیر متوقع طور پر برتاؤ کر سکتے ہیں اور اہداف کی درست شناخت کرنے میں ناکام ہو سکتے ہیں۔ تصویر: ایم ای ایس

ڈاکٹر بلانچارڈ نے مزید کہا، "کیا AI فوج کے اہداف کو منتخب کرنے اور ان پر طاقت کے استعمال کے طریقے کو تبدیل کرتا ہے؟ یہ تبدیلیاں، نتیجے میں، بہت سے قانونی، اخلاقی اور آپریشنل سوالات کو جنم دیتی ہیں۔

SIPRI ماہر نے وضاحت کرتے ہوئے کہا، "بہت سے لوگ اس بات پر فکر مند ہیں کہ، خود مختار نظاموں کو کس طرح ڈیزائن اور استعمال کیا جاتا ہے، وہ شہریوں اور بین الاقوامی قانون سے محفوظ دیگر افراد کو نقصان کے زیادہ خطرے میں ڈال سکتے ہیں۔" "اس کی وجہ یہ ہے کہ AI نظام، خاص طور پر جب افراتفری والے ماحول میں استعمال ہوتے ہیں، غیر متوقع طور پر کام کر سکتے ہیں اور درست طریقے سے اہداف کی شناخت کرنے اور شہریوں پر حملہ کرنے، یا ایسے جنگجوؤں کی شناخت کرنے میں ناکام ہو سکتے ہیں جو لڑائی میں نہیں ہیں۔"

اس مسئلے کی وضاحت کرتے ہوئے، گلوبل ڈیٹا کے دفاعی تجزیہ کار ولسن جونز نے نوٹ کیا کہ جرم کا تعین کس طرح کیا جاتا ہے یہ سوال قابل اعتراض ہو سکتا ہے۔

"جنگ کے موجودہ قانون کے تحت، کمانڈ کی ذمہ داری کا تصور ہے،" مسٹر جونز نے کہا۔ "اس کا مطلب یہ ہے کہ ایک افسر، جنرل، یا دوسرا لیڈر قانونی طور پر اپنی کمان کے تحت فوجیوں کے اقدامات کا ذمہ دار ہے، اگر فوجی جنگی جرائم کا ارتکاب کرتے ہیں، تو افسر ذمہ دار ہے چاہے انہوں نے احکامات نہ بھی دیے ہوں؛ ثبوت کا بوجھ ان پر ہے کہ وہ یہ ثابت کریں کہ انہوں نے جنگی جرائم کو روکنے کے لیے ہر ممکن کوشش کی۔"

"AI سسٹمز کے ساتھ، یہ چیزوں کو پیچیدہ بناتا ہے۔ کیا ایک IT ٹیکنیشن ذمہ دار ہے؟ ایک سسٹم ڈیزائنر؟ یہ واضح نہیں ہے۔ اگر یہ واضح نہیں ہے، اگر اداکاروں کو لگتا ہے کہ ان کے اعمال موجودہ قوانین سے محفوظ نہیں ہیں تو یہ ایک اخلاقی خطرہ پیدا کرتا ہے،" مسٹر جونز نے زور دیا۔

ایک امریکی فوجی روبوٹ کتے کے ساتھ گشت کر رہا ہے۔ تصویر: فوربس

اسلحہ کنٹرول کنونشنز کئی بڑے بین الاقوامی معاہدے ہتھیاروں کے بعض استعمال کو محدود اور ریگولیٹ کرتے ہیں۔ کیمیائی ہتھیاروں پر پابندیاں، جوہری عدم پھیلاؤ کے معاہدے اور کچھ روایتی ہتھیاروں کا کنونشن موجود ہے، جو ایسے مخصوص ہتھیاروں کے استعمال کو ممنوع یا محدود کرتا ہے جو جنگجوؤں کو غیر ضروری یا بلا جواز تکلیف پہنچانے یا شہریوں کو بلاامتیاز متاثر کرنے کے لیے سمجھا جاتا ہے۔

دفاعی تجزیہ کار ولسن جونز بتاتے ہیں، "جوہری ہتھیاروں کے کنٹرول کے لیے دہائیوں کے بین الاقوامی تعاون اور اس کے بعد کے معاہدوں کو نافذ کرنے کی ضرورت ہے۔" "اس کے بعد بھی، ہم نے 1990 کی دہائی تک ماحولیاتی جانچ جاری رکھی۔ جوہری عدم پھیلاؤ کے کامیاب ہونے کی ایک بڑی وجہ دو قطبی عالمی نظام میں ریاستہائے متحدہ اور سوویت یونین کے درمیان تعاون تھا۔ جو اب موجود نہیں ہے، اور AI تخلیق کرنے والی ٹیکنالوجی جوہری طاقت کے مقابلے میں بہت سے ممالک کے لیے زیادہ قابل رسائی ہے۔"

"ایک پابند معاہدے کو تمام متعلقہ کھلاڑیوں کو میز پر لانا ہوگا تاکہ وہ کسی ایسے آلے کو استعمال نہ کریں جس سے ان کی فوجی طاقت میں اضافہ ہو۔ اس کے کام کرنے کا امکان نہیں ہے کیونکہ AI کم سے کم مالی اور مادی لاگت پر فوجی تاثیر کو بہتر بنا سکتا ہے۔"

موجودہ جغرافیائی سیاسی نقطہ نظر

اگرچہ اقوام متحدہ میں ممالک نے AI کے ذمہ دارانہ فوجی استعمال کی ضرورت کو تسلیم کیا ہے، ابھی بھی بہت کچھ کرنا باقی ہے۔

گلوبل ڈیٹا کی پرنسپل تجزیہ کار لورا پیٹرون نے آرمی ٹکنالوجی کو بتایا کہ "ایک واضح ریگولیٹری فریم ورک کے بغیر، یہ دعوے بڑی حد تک خواہش مند رہتے ہیں۔" "یہ کوئی تعجب کی بات نہیں ہے کہ کچھ ممالک ملکی دفاع اور قومی سلامتی کے معاملات، خاص طور پر موجودہ جغرافیائی سیاسی ماحول میں فیصلہ کرتے وقت اپنی خودمختاری برقرار رکھنا چاہتے ہیں۔"

محترمہ پیٹرون نے مزید کہا کہ اگرچہ EU AI ایکٹ AI سسٹمز کے لیے کچھ تقاضے متعین کرتا ہے، لیکن یہ فوجی مقاصد کے لیے AI سسٹمز پر توجہ نہیں دیتا۔

"میرے خیال میں اس اخراج کے باوجود، AI ایکٹ AI ایپلی کیشنز کے لیے ایک طویل التواء فریم ورک قائم کرنے کی ایک اہم کوشش ہے، جو مستقبل میں متعلقہ معیارات کی کچھ حد تک یکسانیت کا باعث بن سکتا ہے،" انہوں نے تبصرہ کیا۔ "یہ یکسانیت فوجی ڈومین میں AI کے لیے بھی اہم ہوگی۔"

Nguyen Khanh

ماخذ: https://www.congluan.vn/moi-nguy-robot-sat-thu-ai-dang-de-doa-an-ninh-toan-cau-post304170.html

![ڈونگ نائی او سی او پی کی تبدیلی: [آرٹیکل 4] قومی معیاری مصنوعات تک پہنچنا](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/11/1762825820379_4702-cac-san-pham-trai-cay-chung-nhan-ocop-nongnghiep-174649.jpeg)

![ڈونگ نائی OCOP منتقلی: [آرٹیکل 3] سیاحت کو OCOP مصنوعات کی کھپت سے جوڑنا](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

تبصرہ (0)