ممتاز بین الاقوامی ماہرین کے ایک گروپ نے گزشتہ ہفتے بیجنگ میں ملاقات کی، جہاں انہوں نے AI کی ترقی میں "سرخ لکیروں" کی نشاندہی کی، بشمول بائیو ویپنز کی تخلیق اور سائبر حملے کرنا۔

میٹنگ کے دنوں بعد ایک بیان میں، ماہرین تعلیم نے خبردار کیا کہ "ہماری زندگیوں میں انسانیت کے لیے تباہ کن یا حتیٰ کہ وجودی خطرات" کو روکنے کے لیے AI کی حفاظت کے لیے ایک مشترکہ نقطہ نظر کی ضرورت ہے۔

بیان میں کہا گیا ہے کہ "سرد جنگ کے عروج پر، بین الاقوامی حکومت اور سائنسی تعاون نے جوہری تباہی کو روکنے میں مدد کی۔ انسانیت کو ایک بار پھر اس تباہی کو روکنے کے لیے مل کر کام کرنا چاہیے جو بے مثال ٹیکنالوجی سے پیدا ہو سکتی ہے"۔

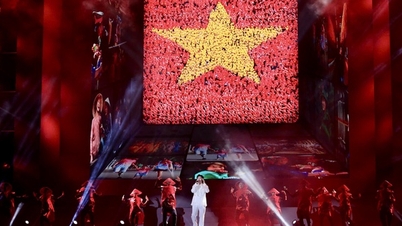

بیجنگ میں اے آئی سیفٹی پر بین الاقوامی ڈائیلاگ کے ماہرین نے اے آئی کی ترقی میں "سرخ لکیروں" کی نشاندہی کی ہے۔ تصویر: ایف ٹی

دستخط کرنے والوں میں جیفری ہنٹن اور یوشوا بینجیو شامل ہیں، جنہیں اکثر AI کے "والد" کے طور پر بیان کیا جاتا ہے۔ کیلیفورنیا یونیورسٹی میں کمپیوٹر سائنس کے پروفیسر سٹورٹ رسل؛ اور اینڈریو یاو، چین کے سب سے ممتاز کمپیوٹر سائنسدانوں میں سے ایک۔

یہ بیان گزشتہ ہفتے بیجنگ میں بین الاقوامی اے آئی سیفٹی ڈائیلاگ کے بعد سامنے آیا ہے، جس میں چینی حکومتی عہدیداروں نے شرکت کی جس میں فورم اور اس کے نتائج کی منظوری کا اظہار کیا گیا۔

امریکی صدر جو بائیڈن اور چینی صدر شی جن پنگ نے گزشتہ سال نومبر میں ملاقات کی تھی اور اے آئی سیفٹی پر تبادلہ خیال کیا تھا، اس معاملے پر بات چیت قائم کرنے پر اتفاق کیا تھا۔ معروف عالمی AI کمپنیوں نے بھی حالیہ مہینوں میں چینی AI ماہرین سے نجی طور پر ملاقات کی ہے۔

نومبر 2023 میں، چین سمیت 28 ممالک اور سرکردہ AI کمپنیوں نے برطانیہ کے چانسلر رشی سنک کی AI سیفٹی سمٹ کے دوران جدید AI سے پیدا ہونے والے وجودی خطرات سے نمٹنے کے لیے مل کر کام کرنے کے وسیع عزم پر اتفاق کیا۔

گزشتہ ہفتے بیجنگ میں، ماہرین نے "مصنوعی جنرل انٹیلی جنس - AGI" یا AI نظام جو انسانوں کے برابر یا اس سے برتر ہیں، کی ترقی سے وابستہ خطرات پر تبادلہ خیال کیا۔

بینجیو نے کہا، "بات چیت کا بنیادی محور سرخ لکیریں تھیں جنہیں کسی بھی طاقتور AI نظام کو عبور نہیں کرنا چاہیے اور یہ کہ دنیا بھر کی حکومتوں کو AI کی ترقی اور تعیناتی پر عمل درآمد کرنا چاہیے۔"

یہ سرخ لکیریں اس بات کو یقینی بنائیں گی کہ "کوئی بھی AI نظام واضح انسانی رضامندی اور مدد کے بغیر خود کو نقل یا بہتر نہیں کر سکتا" یا "ایسے اقدامات اٹھائے جس سے اس کی طاقت اور اثر و رسوخ میں اضافہ ہو۔"

سائنسدانوں نے مزید کہا کہ کوئی بھی نظام "بڑے پیمانے پر تباہی پھیلانے والے ہتھیاروں کو ڈیزائن کرنے، حیاتیاتی یا کیمیائی ہتھیاروں کے کنونشن کی خلاف ورزی کرنے کے لیے اداکاروں کی صلاحیت میں نمایاں اضافہ نہیں کرے گا" یا "خود بخود سائبر حملے کرنے کے قابل ہو گا جس کے نتیجے میں سنگین مالی نقصان یا مساوی نقصان ہو گا"۔

ہوانگ ہائی (FT کے مطابق)

ماخذ

تبصرہ (0)