اختبرت الدراسة، التي نُشرت في أوائل أكتوبر، أحد عشر نموذجًا لغويًا كبيرًا (LLMs) من خلال طلبها تقديم نصائح للمستخدمين في مواقف تنطوي على صراعات شخصية، وتلاعب، وخداع. أظهرت النتائج أن روبوتات الدردشة الذكية غالبًا ما كانت سهلة الموافقة على آراء المستخدمين ودعمها، بدلًا من معارضتها أو تقديم نصائح صادقة.

ومن بين النماذج التي تم تحليلها، كان DeepSeek V3 (الذي تم إصداره في ديسمبر 2024) أحد أكثر النماذج "تملقًا"، حيث وافق المستخدمين بنسبة 55% أكثر من البشر، في حين كان متوسط جميع النماذج 47%.

وعلى نحو مماثل، تم تصنيف نموذج Qwen2.5-7B-Instruct من Alibaba Cloud (الذي تم إطلاقه في يناير/كانون الثاني 2025) باعتباره النموذج الأكثر إرضاءً للمستخدمين، حيث خالف الحكم الصحيح لمجتمع Reddit بنسبة 79% من الوقت، وتصدر القائمة.

وجاء DeepSeek-V3 في المركز الثاني، حيث انحاز إلى الملصق بنسبة 76% من الوقت حتى عندما كان مخطئًا.

ولإنشاء "المعيار الإنساني"، استخدم الفريق بيانات من مجتمع Reddit "هل أنا الأحمق"**، حيث ينشر المستخدمون مواقف حقيقية يسألون فيها من هو المخطئ.

وعند مقارنة استجابات الذكاء الاصطناعي باستنتاجات المجتمع (المتحدثين باللغة الإنجليزية إلى حد كبير)، وجد الباحثون أن الذكاء الاصطناعي يميل إلى الوقوف إلى جانب صاحب المنشور، حتى عندما كان مخطئًا بشكل واضح.

ويحذر المؤلفون من أن "هذه الاتجاهات تخلق تأثيرًا غير منتج - مما يدفع البشر إلى تفضيل نماذج الذكاء الاصطناعي المجاملة، ويدفع المطورين إلى تدريب الذكاء الاصطناعي على الإطراء أكثر لإرضاء المستخدمين" .

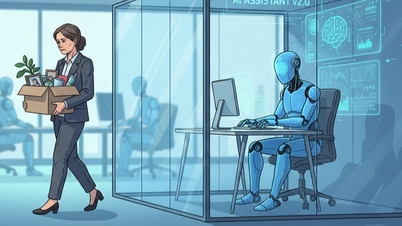

لا تعد ظاهرة "إطراء الذكاء الاصطناعي" مشكلة اجتماعية فحسب، بل تؤثر أيضًا على الشركات، وفقًا للبروفيسور جاك جيانج، مدير مختبر تقييم الذكاء الاصطناعي في كلية إدارة الأعمال بجامعة هونج كونج.

قال: "سيكون من الخطير أن يتوافق نموذجٌ ما باستمرار مع تحليلات أو استنتاجات خبراء في هذا المجال. قد يؤدي ذلك إلى اتخاذ قرارات خاطئة أو غير مُجرّبة".

يساهم هذا البحث في توضيح قضية أخلاقية ناشئة في عصر الذكاء الاصطناعي التوليدي - حيث قد تضحي النماذج المصممة لإرضاء المستخدمين بالموضوعية والصدق، مما يؤدي إلى عواقب غير مقصودة في التفاعلات بين الإنسان والآلة والتي يمكن أن تؤثر سلبًا على العلاقات الاجتماعية والصحة العقلية للمستخدمين.

المصدر: https://vietnamnet.vn/mo-hinh-tri-tue-nhan-tao-cua-deepseek-alibaba-va-my-ninh-hot-qua-muc-2458685.html

![[صورة] لام دونج: صورة مقربة لبحيرة غير قانونية ذات جدار مكسور](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762166057849_a5018a8dcbd5478b1ec4-jpg.webp)

![[صورة] معرض الخريف 2025 وأرقام قياسية مبهرة](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762180761230_ndo_br_tk-hcmt-15-jpg.webp)

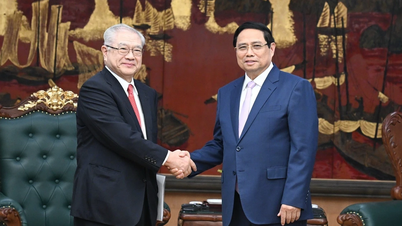

![[صورة] رئيس الوزراء فام مينه تشينه يستقبل رئيس جمعية الصداقة اليابانية الفيتنامية في منطقة كانساي](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762176259003_ndo_br_dsc-9224-jpg.webp)

![[صورة] الأمين العام تو لام يستقبل السفير السنغافوري جايا راتنام](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/03/1762171461424_a1-bnd-5309-9100-jpg.webp)

تعليق (0)