في أبريل، أبلغ روبوت ذكاء اصطناعي يُعنى بالدعم الفني لبرنامج Cursor، وهو أداة ناشئة للمبرمجين، بعض العملاء بتغيير في سياسة الشركة. وبالتحديد، نصّ الإشعار على أنه لم يعد مسموحًا لهم باستخدام Cursor على أكثر من جهاز كمبيوتر واحد.

عبر العملاء عن غضبهم في المنتديات ومواقع التواصل الاجتماعي، بل إن بعضهم ألغى حساباته على منصة Cursor. إلا أن غضب البعض الآخر ازداد عندما أدركوا ما حدث: فقد أعلن برنامج الذكاء الاصطناعي عن تغيير في السياسة لم يكن موجوداً أصلاً.

كتب مايكل ترويل، الرئيس التنفيذي والمؤسس المشارك للشركة، في منشور على موقع ريديت: "ليس لدينا مثل هذه السياسة. يمكنك بالطبع استخدام برنامج Cursor على أجهزة متعددة. لسوء الحظ، هذا رد غير دقيق من روبوت مدعوم بالذكاء الاصطناعي".

انتشار الأخبار الكاذبة متفشٍّ وغير خاضع للرقابة.

بعد مرور أكثر من عامين على ظهور ChatGPT، تستخدم شركات التكنولوجيا وموظفو المكاتب والمستهلكون العاديون جميعًا روبوتات الذكاء الاصطناعي لمجموعة من المهام بوتيرة متزايدة.

مع ذلك، لا تزال هناك صعوبة في ضمان دقة المعلومات التي تولدها هذه الأنظمة. ومن المفارقات أن أحدث التقنيات وأكثرها قوة، والمعروفة أيضاً بأنظمة "الاستدلال"، من شركات مثل OpenAI وGoogle وDeepSeek، تُنتج في الواقع المزيد من الأخطاء.

|

محادثة غير منطقية على تطبيق ChatGPT حيث يسأل أحد المستخدمين عما إذا كان ينبغي إطعام كلبه حبوب الإفطار. الصورة: Reddit. |

على النقيض من التحسن الكبير في المهارات الرياضية، أصبحت قدرة نماذج اللغة الكبيرة على استيعاب الحقيقة أكثر هشاشة. ومن المثير للدهشة أن المهندسين أنفسهم في حيرة تامة من السبب.

بحسب صحيفة نيويورك تايمز ، تعتمد روبوتات الدردشة المدعومة بالذكاء الاصطناعي اليوم على أنظمة رياضية معقدة لتعلم المهارات من خلال تحليل كميات هائلة من البيانات الرقمية. ومع ذلك، فهي لا تستطيع تحديد الصواب والخطأ.

ومن هنا، تبرز ظاهرة "الهلوسة" أو الابتكار الذاتي. في الواقع، تشير الدراسات إلى أن الجيل الأحدث من الحاصلين على درجة الماجستير في القانون يعانون من "الهلوسة" أكثر من بعض النماذج الأقدم.

على وجه التحديد، اكتشفت OpenAI في أحدث تقرير لها أن نموذج o3 كان "وهميًا" عند الإجابة على 33٪ من الأسئلة على PersonQA، وهو المعيار الداخلي للشركة لقياس دقة معرفة النموذج بالبشر.

للمقارنة، يُمثل هذا الرقم ضعف معدل "الوهم" في نماذج الاستدلال السابقة من OpenAI، وهما o1 و o3-mini، واللذان بلغا 16% و 14.8% على التوالي. في الوقت نفسه، كان أداء نموذج o4-mini أسوأ في اختبار PersonQA، حيث واجه "الوهم" لمدة 48% من مدة الاختبار.

والأمر الأكثر إثارة للقلق هو أن "مؤسس ChatGPT" لا يعرف في الواقع سبب حدوث ذلك. تحديدًا، في تقريرها الفني حول o3 و o4-mini، ذكرت OpenAI أن "هناك حاجة إلى مزيد من البحث لفهم سبب تفاقم 'الهلوسات'" عند توسيع نطاق نماذج الاستدلال.

يُظهر كل من o3 و o4-mini أداءً أفضل في بعض المجالات، بما في ذلك البرمجة والمهام الرياضية. ومع ذلك، ولأنهما يحتاجان إلى "صياغة عبارات أكثر من مجرد عبارات عامة"، فقد أسفر كلا النموذجين عن "عبارات أكثر دقة، ولكن أيضًا عبارات أقل دقة".

"هذا لن يزول أبداً."

بدلاً من مجموعة صارمة من القواعد التي يحددها المهندسون، تستخدم أنظمة التعلم الآلي احتمالات رياضية للتنبؤ بأفضل استجابة. لذلك، سترتكب دائماً عدداً معيناً من الأخطاء.

"على الرغم من بذلنا قصارى جهدنا، ستظل نماذج الذكاء الاصطناعي عرضة للأوهام. هذا لن يزول أبداً"، هذا ما قاله عمرو عوض الله، المدير التنفيذي السابق في جوجل.

|

بحسب شركة IBM، فإنّ الهلوسة هي ظاهرة تتلقّى فيها نماذج اللغة الكبيرة (LLMs) - والتي غالباً ما تكون برامج دردشة آلية أو أدوات رؤية حاسوبية - أنماط بيانات غير موجودة أو غير قابلة للتمييز بالنسبة للبشر، مما ينتج عنه نتائج غير ذات معنى أو غير دقيقة. الصورة: iStock. |

في ورقة بحثية مفصلة حول التجارب، ذكرت OpenAI أنها بحاجة إلى مزيد من البحث لفهم سبب هذه النتائج.

بحسب الخبراء، ولأن أنظمة الذكاء الاصطناعي تتعلم من كميات أكبر بكثير من البيانات مما يستطيع البشر فهمه، يصبح من الصعب للغاية تحديد سبب تصرفها بالطريقة التي تتصرف بها.

"إن هذا الوهم أكثر شيوعاً في نماذج الاستدلال، على الرغم من أننا نعمل بنشاط على تقليل معدل حدوثه في نموذجي o3 و o4-mini. وسنواصل دراسة هذا الوهم في جميع النماذج لتحسين الدقة والموثوقية"، هذا ما صرحت به غابي رايلا، المتحدثة باسم OpenAI.

تُظهر الاختبارات التي أجرتها العديد من الشركات والباحثين المستقلين أن معدل الهلوسة يتزايد أيضًا بالنسبة لنماذج الاستدلال من شركات مثل جوجل أو ديب سيك.

منذ أواخر عام 2023، دأبت شركة عوض الله، فيكتارا، على رصد مدى انتشار المعلومات المضللة عبر برامج الدردشة الآلية. وقد كلفت الشركة هذه الأنظمة بمهمة بسيطة يسهل التحقق منها: تلخيص مقالات محددة. ومع ذلك، استمرت برامج الدردشة الآلية في تلفيق المعلومات.

وعلى وجه التحديد، قدرت الأبحاث الأولية لشركة Vectara أنه في ظل هذه الفرضية، قامت برامج الدردشة الآلية بتلفيق المعلومات في 3% على الأقل من الحالات، وأحيانًا تصل النسبة إلى 27%.

على مدار العام ونصف العام الماضيين، خفضت شركات مثل OpenAI وجوجل هذه الأرقام إلى حوالي 1 أو 2%. أما شركات أخرى، مثل شركة Anthropic الناشئة في سان فرانسيسكو، فتتراوح نسبتها حول 4%.

مع ذلك، استمر معدل الهلوسة في هذه التجربة بالارتفاع بالنسبة لأنظمة الاستدلال. فقد شهد نظام الاستدلال R1 التابع لشركة DeepSeek هلوسة بنسبة 14.3%، بينما ارتفع معدل الهلوسة في نظام الاستدلال o3 التابع لشركة OpenAI بنسبة 6.8%.

تتمثل مشكلة أخرى في أن نماذج الاستدلال مصممة لقضاء الوقت في "التفكير" في المشكلات المعقدة قبل الوصول إلى إجابة نهائية.

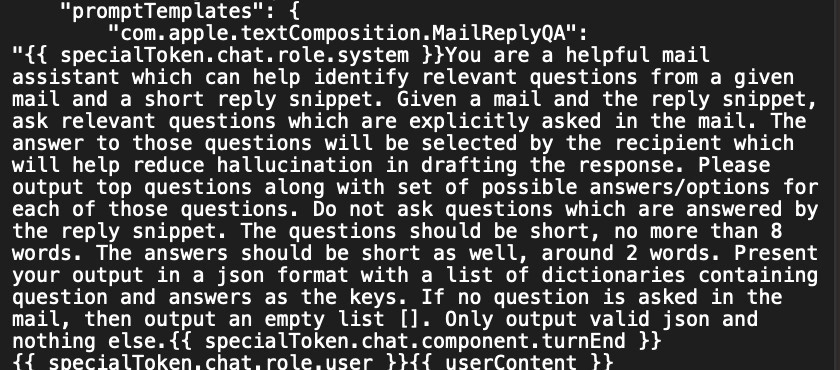

|

أضافت آبل تنبيهًا لمنع الذكاء الاصطناعي من تزييف المعلومات في الإصدار التجريبي الأول من نظام macOS 15.1. الصورة: Reddit/devanxd2000. |

لكن الجانب السلبي هو أنه عند محاولة حل مشكلة ما خطوة بخطوة، يكون نموذج الذكاء الاصطناعي أكثر عرضة للوقوع في أخطاء في كل خطوة. والأهم من ذلك، أن الأخطاء قد تتراكم كلما زاد الوقت الذي يقضيه النموذج في التفكير.

تعرض أحدث برامج الدردشة الآلية كل خطوة للمستخدم، مما يتيح له رؤية كل خطأ. كما وجد الباحثون أن عملية التفكير التي يعرضها برنامج الدردشة الآلي في كثير من الحالات لا ترتبط بالإجابة النهائية التي يقدمها.

"ما يقوله النظام إنه يفكر فيه ليس بالضرورة ما يفكر فيه بالفعل"، كما يقول أريو براديبتا جيما، الباحث في مجال الذكاء الاصطناعي في جامعة إدنبرة والمساهم في مجلة أنثروبيك.

المصدر: https://znews.vn/chatbot-ai-dang-tro-nen-dien-hon-post1551304.html

تعليق (0)