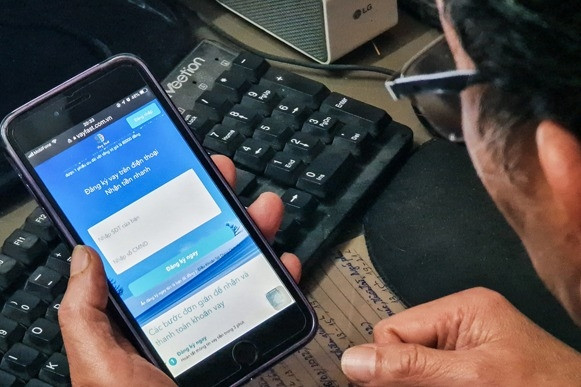

Hoang Oanh (jméno postavy bylo změněno) je administrativní pracovník v Hanoji . Během chatování s kamarádem přes Facebook Messenger se Oanhův kamarád rozloučil a ukončil konverzaci, ale najednou se vrátil k textové zprávě, požádal ho o půjčku peněz a navrhl převod peněz na bankovní účet.

Přestože se jméno účtu shodovalo se jménem její kamarádky, Hoang Oanh měla stále trochu podezření, a tak požádala o videohovor , aby si to ověřila. Kamarádka okamžitě souhlasila, ale hovor trval jen několik sekund kvůli „přerušované síti“, jak jí vysvětlila. Když Hoang Oanh ve videohovoru uviděla tvář své kamarádky a hlas patřil té samé osobě, už nepochybovala a peníze převedla. Teprve po úspěšném převodu si však uživatelka uvědomila, že se chytila do hackerské pasti.

Případ uživatele Hoang Oanh je jen jednou z mnoha obětí, které „padly do pasti“ podvodných skupin využívajících technologii umělé inteligence k vytváření obrázků a hlasů přátel a příbuzných obětí, aby je obelhaly a přiměly k přivlastnění si jejich majetku.

Odborníci společnosti Bkav uvedli, že v druhé polovině roku 2023 a zejména v době kolem lunárního Nového roku 2024 tato společnost zabývající se informační bezpečností neustále dostávala hlášení a žádosti o pomoc od obětí ohledně podobných případů podvodů, jako jsou výše uvedené.

Podle analýzy expertů společnosti se v případě uživatele Hoang Oanha zločinci zmocnili facebookového účtu, ale nezmocnili se ho okamžitě úplně, ale místo toho ho tajně sledovali a čekali na příležitost, aby se vydávali za oběť a požádali o půjčku peníze od jeho přátel a příbuzných.

Podvodníci používají umělou inteligenci k vytvoření falešného videa obličeje a hlasu majitele facebookového účtu (Deepfake). Když jsou požádáni o videohovor za účelem ověření, souhlasí s přijetím hovoru, ale poté se rychle odpojí, aby se vyhnuli odhalení.

Pan Nguyen Tien Dat, generální ředitel Centra pro výzkum malwaru společnosti Bkav, zdůraznil, že i když uživatelé uskutečňují videohovor a vidí tváře příbuzných nebo přátel a slyší jejich hlasy, nemusí nutně nutně mluvit s danou osobou. V poslední době se mnoho lidí stalo obětí finančních podvodů využívajících Deepfake a za účasti technologie umělé inteligence.

„Schopnost shromažďovat a analyzovat uživatelská data pomocí umělé inteligence umožňuje vytváření sofistikovaných strategií pro boj s podvody. To také znamená, že se zvýší složitost podvodných scénářů při kombinaci Deepfake a GPT, což výrazně ztíží odhalování podvodů,“ uvedl pan Nguyen Tien Dat.

Odborníci Bkav doporučují, aby uživatelé byli obzvláště ostražití, neposkytovali osobní údaje (občanský průkaz, bankovní účet, OTP kód...). Nepřeváděli peníze cizím lidem prostřednictvím telefonu, sociálních sítí, webových stránek se známkami podvodu. V případě žádosti o půjčku/převod peněz na účet prostřednictvím sociálních sítí by uživatelé měli použít jiné metody ověřování, jako je telefonování nebo použití jiných komunikačních kanálů k opětovnému potvrzení.

Odborníci se při předpovídání trendů kybernetických útoků v roce 2024 shodují, že rychlý rozvoj umělé inteligence přináší nejen jasné výhody, ale také vytváří významná rizika pro kybernetickou bezpečnost.

Největší výzvou pro firmy a organizace, které dnes čelí technologiím umělé inteligence, jsou podvody a pokročilé perzistentní hrozby (APT) s rostoucí složitostí podvodných scénářů, zejména při kombinaci Deepfake a GPT. Schopnost shromažďovat a analyzovat uživatelská data prostřednictvím umělé inteligence umožňuje vytváření sofistikovaných strategií podvodů, což uživatelům ztěžuje identifikaci podvodů.

Zvyšování bezpečnosti umělé inteligence je v nadcházejícím období nepopiratelným trendem. Mezinárodní společenství bude muset úzce spolupracovat na vývoji nových bezpečnostních opatření a zároveň zvyšovat znalosti a povědomí uživatelů o potenciálních rizicích umělé inteligence.

Pozor na podvody šířící falešné zprávy o značkách

Varování před 5 online podvody během lunárního Nového roku 2024

Vydávání se za úřady představuje 9 % všech phishingových útoků ve Vietnamu

Zdroj

![[Fotografie] Šíření vietnamské kultury ruským dětem](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/19/0c3a3a23fc544b9c9b67f4e243f1e165)

![[Fotografie] Porodní asistentky mořských želv](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/19/9547200fdcea40bca323e59652c1d07e)

![[Foto] Předseda Národního shromáždění Tran Thanh Man jednal s předsedou malajské Sněmovny reprezentantů](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/19/5cb954e3276c4c1587968acb4999262e)

![[Fotografie] Tajná zahrada se objeví v projektu Dobré ráno, Vietnam 2025 novin Nhan Dan](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/19/cec307f0cfdd4836b1b36954efe35a79)

Komentář (0)