Errichten Sie eine dedizierte KI-Infrastruktur direkt im Rechenzentrum.

Da Regierungen und große Organisationen bestrebt sind, Projekte im Bereich der künstlichen Intelligenz (KI) auszuweiten, haben viele begonnen, sich dem Konzept der „KI-Fabriken“ anzunähern, um spezifischen Anforderungen hinsichtlich Datensouveränität und Einhaltung gesetzlicher Vorschriften gerecht zu werden.

Der Aufbau einer leistungsstarken KI-Fabrik erfordert jedoch ein umfassendes System, das Managementprozesse, Datenbanken, Speicherung und Sicherheit umfasst, mit einer Komplexität, die nur wenige Kunden bereit sind, selbst zu tragen.

Organisationen in stark regulierten Branchen und im öffentlichen Sektor stehen bei der Umsetzung groß angelegter KI-Projekte vor erheblichen Herausforderungen im Bereich der KI-Infrastruktur. Der Aufbau eigener KI-Kapazitäten erfordert massive Investitionen in GPUs, Rechenzentren und Energie sowie die Bewältigung komplexer Beschaffungsprozesse, die Auswahl des passenden Modells für jeden Anwendungsfall und die Lizenzierung mehrerer KI-Anbieter.

All diese Faktoren führen dazu, dass sich der Implementierungsprozess über viele Jahre hinzieht, die operative Komplexität zunimmt und die Unternehmen von ihren eigentlichen Geschäftszielen abgelenkt werden.

Um dieser Herausforderung zu begegnen, hat AWS am 11. Dezember AWS AI Factories eingeführt, einen neuen Service, der Unternehmen und Regierungen eine dedizierte KI-Infrastruktur direkt im Rechenzentrum des Kunden bietet, die exklusiv für sie betrieben wird.

AWS AI Factories integriert fortschrittliche KI-Beschleunigungstools, von hochmoderner NVIDIA KI-Computing-Technologie bis hin zu Trainium-Chips, kombiniert mit Hochgeschwindigkeits-Netzwerkfunktionen mit geringer Latenz, Hochleistungsspeichern und -datenbanken, umfassender Sicherheit, energieeffizienter Infrastruktur und leistungsstarken AWS-KI-Diensten wie Amazon Bedrock und SageMaker AI.

Dadurch können Kunden KI-Anwendungen schnell und in großem Umfang entwickeln und einsetzen, die Leistung optimieren und spezifische Geschäftsanforderungen erfüllen.

AWS AI Factories operieren als separate AWS-Regionen und bieten sicheren Zugriff mit geringer Latenz auf Rechenleistung, Speicher, Datenbanken und KI-Dienste. Dieser Ansatz nutzt die verfügbare Rechenzentrumskapazität und -leistung optimal und ermöglicht gleichzeitig den Zugriff auf die gesamte AWS-KI-Infrastruktur und -Dienste – von modernsten KI-Chips für Training und Inferenz bis hin zu Tools zum Erstellen, Trainieren und Bereitstellen von KI-Modellen.

Darüber hinaus ermöglichen Managed Services den Zugriff auf führende Basismodelle, ohne dass separate Verträge mit einzelnen Anbietern erforderlich sind, und helfen den Kunden gleichzeitig, die Anforderungen an Sicherheit, Datensouveränität und die Einhaltung gesetzlicher Bestimmungen hinsichtlich des Ortes der Datenverarbeitung und -speicherung vollständig zu erfüllen.

Mit fast zwei Jahrzehnten Erfahrung als führender Anbieter von Cloud-Computing-Lösungen und überragender Expertise in der Entwicklung von KI-Systemen im großen Maßstab kann AWS eine sichere und zuverlässige KI-Infrastruktur weitaus schneller bereitstellen, als die meisten Unternehmen sie selbst aufbauen können. Dies spart jahrelange Anstrengungen und reduziert die betriebliche Komplexität erheblich.

Die 15-jährige Partnerschaft zwischen AWS und NVIDIA

Die Partnerschaft zwischen AWS und NVIDIA begann vor 15 Jahren, als AWS die weltweit erste GPU-Cloud einführte. Seitdem bietet AWS seinen Kunden das vielfältigste Portfolio an GPU-Lösungen.

Aufbauend auf einer langjährigen Partnerschaft zur Bereitstellung fortschrittlicher KI-Infrastruktur helfen AWS und NVIDIA ihren Kunden, groß angelegte Sprachmodelle schneller, effizienter und sicherer als anderswo direkt in ihren eigenen Rechenzentren zu erstellen und auszuführen.

Durch die Integration von NVIDIA und AWS AI Factories erhalten AWS-Kunden nahtlosen Zugriff auf die beschleunigte Rechenplattform von NVIDIA, eine umfassende KI-Software-Suite und Tausende von GPU-beschleunigten Anwendungen. Dies ermöglicht überlegene Leistung, hohe Effizienz und flexible Skalierbarkeit für die Entwicklung von KI-Lösungen der nächsten Generation.

Die beiden Seiten kombinieren weiterhin Spitzentechnologien: AWS Nitro System, Elastic Fabric Adapter (EFA)-Netzwerke im Petabit-Bereich und Amazon EC2 UltraClusters, die die neuesten NVIDIA Grace Blackwell- und NVIDIA Vera Rubin-Plattformen der nächsten Generation unterstützen.

Zukünftig wird AWS die Unterstützung für die NVIDIA NVLink Fusion-Hochgeschwindigkeits-Chipverbindungstechnologie auf Trainium4- und Graviton-Chips der nächsten Generation sowie auf Nitro-Systemen ausweiten. Diese Integration hilft Kunden, die Markteinführungszeit zu verkürzen und gleichzeitig eine überlegene Leistung zu erzielen.

Ian Buck, Vizepräsident und General Manager für Hyperscale- und HPC-Computing bei NVIDIA, erklärte: „Groß angelegte KI erfordert einen ganzheitlichen Ansatz, der von fortschrittlichen GPUs und Netzwerkinfrastruktur bis hin zu Software und Diensten reicht, die jede Ebene des Rechenzentrums optimieren. Gemeinsam mit AWS bringen wir all diese Elemente direkt in die Umgebungen unserer Kunden.“

„Durch die Kombination der neuesten Grace Blackwell- und Vera Rubin-Architekturen von NVIDIA mit der sicheren, leistungsstarken Infrastruktur und der umfassenden KI-Software-Suite von AWS hilft AWS AI Factories Unternehmen dabei, leistungsstarke KI-Funktionen in einem Bruchteil der Zeit bereitzustellen und sich dabei voll und ganz auf Innovationen zu konzentrieren, anstatt sich um die Integration zu kümmern“, sagte Ian Buck.

Unterstützung des öffentlichen Sektors bei der beschleunigten Einführung von KI.

AWS AI Factories sind so konzipiert, dass sie die strengsten Sicherheitsstandards von AWS erfüllen und Regierungskunden maximales Vertrauen in die Ausführung sensibler Workloads auf allen Klassifizierungsstufen geben: Unclassified, Sensitive, Classified und Top Secret.

Gleichzeitig bietet AWS AI Factories Regierungen weltweit die Bereitschaft, Zuverlässigkeit, Sicherheit und Kontrolle, die erforderlich sind, um Wirtschaftswachstum zu fördern und die Vorteile der KI-Technologie zu maximieren.

AWS und NVIDIA arbeiten strategisch mit HUMAIN zusammen, einem globalen Unternehmen mit Sitz in Saudi-Arabien, das sich auf die Entwicklung umfassender KI-Fähigkeiten spezialisiert hat.

Im Rahmen dieser Zusammenarbeit wird AWS die erste wegweisende „KI-Zone“ in Saudi-Arabien errichten, mit bis zu 150.000 KI-Chips, darunter GB300-GPUs, der dedizierten KI-Infrastruktur von AWS und AWS-KI-Diensten, die alle in einem von HUMAIN speziell entworfenen Rechenzentrum bereitgestellt werden.

Tareq Amin, CEO von HUMAIN, erklärte: „Die KI-Fabrik, die AWS in unserer neuen KI-Zone errichtet, markiert den Beginn einer Reise im Gigawatt-Bereich für HUMAIN und AWS. Diese Infrastruktur wurde von Anfang an so konzipiert, dass sie sowohl den rasant wachsenden Bedarf an KI-Rechenleistung lokal als auch global deckt.“

„Durch unser gemeinsames Engagement für die Erschließung globaler Märkte schaffen wir ein Ökosystem, das die Zukunft der Entwicklung, des Einsatzes und der Skalierung von KI-Ideen weltweit prägen wird“, fügte Tareq Amin hinzu.

Quelle: https://nhandan.vn/nha-may-tri-tue-nhan-tao-aws-nang-cao-hieu-nang-ha-tang-ai-trong-trung-tam-du-lieu-post929637.html

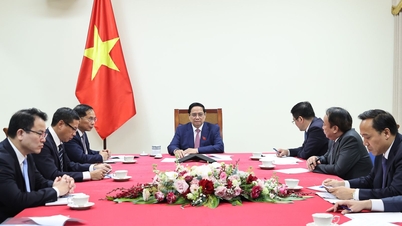

![[Foto] Premierminister Pham Minh Chinh telefoniert mit dem Vorstandsvorsitzenden des russischen Energiekonzerns Rosatom.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

![[Foto] Abschlusszeremonie der 10. Sitzung der 15. Nationalversammlung](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

![[OFFIZIELL] MISA GROUP VERKÜNDET IHRE PIONIERTÄTIGE MARKENPOSITIONIERUNG IM BEREICH DER ENTWICKLUNG VON KI-AGENTEN FÜR UNTERNEHMEN, HAUSHALTE UND DIE REGIERUNG](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

Kommentar (0)