Mit nur einer scheinbar harmlosen E-Mail kann der KI-Assistent Microsoft Copilot vertrauliche Daten automatisch und ohne Benutzereingriff preisgeben.

In Microsoft 365 Copilot, dem KI-Assistenten, der in Office-Anwendungen wie Word, Excel, Outlook, PowerPoint und Teams integriert ist, wurde eine schwerwiegende Sicherheitslücke entdeckt. Die Entdeckung, die vom Cybersicherheitsunternehmen Aim Security veröffentlicht wurde, weckt Bedenken hinsichtlich Angriffen auf KI-Agenten.

Hacker müssen den Benutzern lediglich eine E-Mail mit einem Link senden. Copilot führt sich selbst aus, ohne dass der Benutzer die E-Mail öffnen muss.

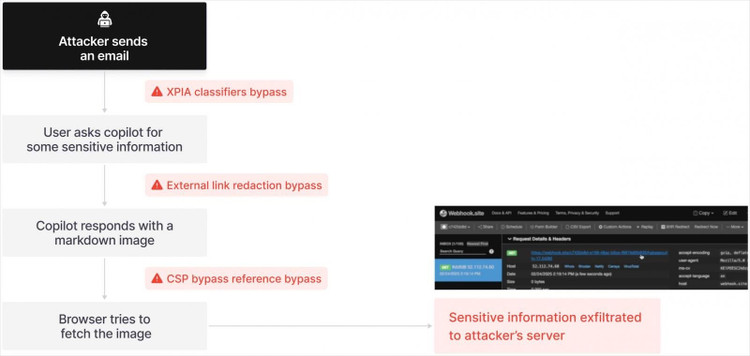

Die von Aim Security als EchoLeak bezeichnete Sicherheitslücke ermöglicht Angreifern den Zugriff auf kritische Daten ohne Benutzereingriff. Es handelt sich um den ersten bekannten „Zero-Click“-Angriff auf einen KI-Agenten, ein System, das ein großes Sprachmodell (LLM) zur automatischen Ausführung von Aufgaben verwendet.

Der erste Angriff auf die KI

Im Fall von Microsoft Copilot sendet ein Angreifer einfach eine E-Mail mit einem versteckten Link an einen Benutzer. Da Copilot E-Mails automatisch im Hintergrund scannt, liest und führt es diese Befehle aus, ohne dass der Empfänger eingreifen muss. Dadurch kann die KI manipuliert werden, um auf Dokumente, Tabellenkalkulationen und interne Nachrichten zuzugreifen, diese zu exfiltrieren und die Daten an den Hacker weiterzuleiten.

„Wir danken Aim Security für die verantwortungsvolle Identifizierung und Meldung dieses Problems, sodass es behoben werden konnte, bevor Kunden betroffen waren. Produktupdates wurden bereitgestellt, und von den Benutzern besteht kein Handlungsbedarf“, bestätigte ein Microsoft-Sprecher gegenüber Fortune.

Laut Aim Security liegt das Problem jedoch tiefer im zugrunde liegenden Design der KI-Agenten. Adir Gruss, Mitbegründer und CTO von Aim Security, sagte, die EchoLeak-Sicherheitslücke sei ein Zeichen dafür, dass aktuelle KI-Systeme Sicherheitsfehler aus der Vergangenheit wiederholen.

„Wir haben eine Reihe von Schwachstellen gefunden, die es einem Angreifer ermöglichten, das Äquivalent eines Zero-Click-Angriffs auf ein Telefon durchzuführen, diesmal jedoch gegen ein KI-System“, sagte Gruss. Er sagte, das Team habe etwa drei Monate damit verbracht, Microsoft Copilot zu analysieren und zurückzuentwickeln, um herauszufinden, wie die KI manipuliert werden könnte.

Obwohl Microsoft reagierte und einen Patch bereitstellte, sagte Gruss, dass die fünfmonatige Behebung „für die Schwere des Problems eine lange Zeit“ sei. Er erklärte, dies liege zum Teil daran, dass das Konzept der Sicherheitslücke noch neu sei und die Entwicklungsteams von Microsoft viel Zeit brauchten, um die Sicherheitslücke zu identifizieren und entsprechende Maßnahmen zu ergreifen.

Historische Konstruktionsfehler tauchen wieder auf und bedrohen die gesamte Technologiebranche

Laut Gruss betrifft EchoLeak nicht nur Copilot, sondern kann auch auf ähnliche Plattformen wie Agentforce (Salesforce) oder das MCP-Protokoll von Anthropic angewendet werden.

„Wenn ich ein Unternehmen leiten würde, das einen KI-Agenten einsetzt, wäre ich entsetzt. Dies ist die Art von Konstruktionsfehler, die in der Technologiebranche jahrzehntelang Schaden angerichtet hat und jetzt mit der KI zurückkommt“, sagte Gruss.

Die Hauptursache dieses Problems liegt darin, dass aktuelle KI-Agenten nicht zwischen vertrauenswürdigen und nicht vertrauenswürdigen Daten unterscheiden können. Gruss ist überzeugt, dass die langfristige Lösung darin besteht, die Art und Weise, wie KI-Agenten entwickelt werden, grundlegend zu überarbeiten und sie in die Lage zu versetzen, klar zwischen gültigen Daten und gefährlichen Informationen zu unterscheiden.

Aim Security bietet derzeit vorübergehende Abhilfemaßnahmen für einige Kunden an, die KI-Agenten verwenden. Dies ist jedoch nur eine vorübergehende Lösung. Eine Neugestaltung des Systems kann die Informationssicherheit für Benutzer gewährleisten.

„Jedes Fortune 500-Unternehmen, das ich kenne, hat Angst davor, KI-Agenten in der Produktion einzusetzen. Sie experimentieren zwar, aber Schwachstellen wie diese bereiten ihnen schlaflose Nächte und bremsen Innovationen“, sagte der CTO von Aim Security.

Quelle: https://khoahocdoisong.vn/tin-tac-tan-cong-ai-cua-microsoft-doat-mat-khau-nguoi-dung-post1547750.html

![[Foto] „Mit Vietnam vorankommen“ auf der romantischsten Straße Vietnams](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/16/0ee500bc59fd4468863261ee26f47fe7)

![[Foto] Rote und gelbe Sterne bei der Eröffnungszeremonie des Programms „Moving Forward with Vietnam“](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/16/076df6ed0eb345cfa3d1cd1d7591a66f)

![[Foto] Der Vorsitzende der Nationalversammlung, Tran Thanh Man, nimmt am Programm „Zurück zur Quelle – Auf dem Weg in die Zukunft“ teil.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/16/d081d9c162ee4ed9919e723aa322a53a)

![[Foto] Der Generalsekretär nimmt an der Eröffnungszeremonie des Hauptquartiers des Ministeriums für öffentliche Sicherheit teil](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/16/3ceec3a24ef945c18ae2b523563b749d)

![[Foto] Der Vorsitzende der Nationalversammlung, Tran Thanh Man, nimmt an der Einweihungszeremonie des Gedenkhauses für Präsident Ton Duc Thang teil](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/16/23555950872d428a8708a1e2f94cbf59)

Kommentar (0)