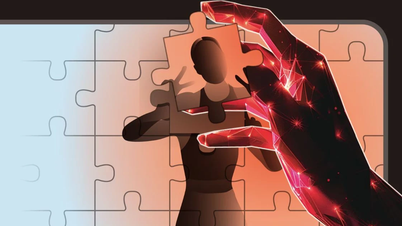

Έχοντας προβληθεί εκατομμύρια φορές στο διαδίκτυο, οι εικόνες είναι deepfakes που δημιουργήθηκαν με τεχνητή νοημοσύνη. Αν κοιτάξετε προσεκτικά, μπορείτε να δείτε ενδεικτικά σημάδια: παράξενα καμπυλωτά δάχτυλα ή μάτια που λάμπουν με ένα αφύσικο φως.

Η οργή που προκαλούν αυτές οι deepfake εικόνες, ωστόσο, είναι πραγματική.

Φωτογραφίες από τον πόλεμο Ισραήλ-Χαμάς απεικονίζουν με έντονο και οδυνηρό τρόπο τους κινδύνους της Τεχνητής Νοημοσύνης ως εργαλείο προπαγάνδας, που χρησιμοποιείται για τη δημιουργία ρεαλιστικών εικόνων.

Από την έναρξη των μαχών τον περασμένο μήνα, ψηφιακά χειραγωγημένες φωτογραφίες που κυκλοφορούν στα μέσα κοινωνικής δικτύωσης έχουν χρησιμοποιηθεί για να διατυπωθούν ψευδείς ισχυρισμοί σχετικά με την ευθύνη για τα θύματα ή για να παραπλανηθούν οι άνθρωποι σχετικά με φρικαλεότητες που δεν συνέβησαν ποτέ.

Ένας Παλαιστίνιος μαζεύει τα πράγματά του από τα ερείπια στη Γάζα. Φωτογραφία AP.

Οι τεχνολογικές εξελίξεις συμβαίνουν με αυξανόμενη συχνότητα και ελάχιστη εποπτεία. Αυτό καθιστά σαφή τον κίνδυνο η Τεχνητή Νοημοσύνη να γίνει μια άλλη μορφή όπλου και προσφέρει μια πρώιμη εικόνα για το τι θα συμβεί σε μελλοντικές συγκρούσεις, εκλογές και άλλα σημαντικά γεγονότα.

«Τα πράγματα θα χειροτερέψουν πολύ πριν βελτιωθούν», δήλωσε ο Ζαν-Κλοντ Γκόλντενσταϊν, Διευθύνων Σύμβουλος της CREOpoint, μιας εταιρείας τεχνολογίας με έδρα το Σαν Φρανσίσκο και το Παρίσι που χρησιμοποιεί την Τεχνητή Νοημοσύνη για να αξιολογεί την εγκυρότητα των διαδικτυακών καταγγελιών.

Η εταιρεία του έχει συγκεντρώσει μια βάση δεδομένων με τις πιο viral deepfake εικόνες που αναδύονται από τη Γάζα. «Εικόνες, βίντεο και ήχος: με δημιουργική τεχνητή νοημοσύνη, αυτό είναι ένα βήμα μπροστά που δεν έχετε ξαναδεί», είπε.

Ο Ιμράν Αχμέντ, Διευθύνων Σύμβουλος του Κέντρου για την Καταπολέμηση του Ψηφιακού Μίσους, ενός μη κερδοσκοπικού οργανισμού που παρακολουθεί την παραπληροφόρηση σχετικά με τον πόλεμο, δήλωσε ότι οι προπαγανδιστές που δημιουργούν τέτοιες εικόνες είναι επιδέξιοι στο να στοχεύουν στις βαθύτερες παρορμήσεις και ανησυχίες των ανθρώπων.

Όσο πιο τρομακτική είναι η εικόνα, τόσο πιο πιθανό είναι οι χρήστες να τη θυμηθούν και να τη μοιραστούν, διαδίδοντας ακούσια περαιτέρω παραπληροφόρηση. Παρόμοια παραπληροφόρηση που δημιουργείται από την τεχνητή νοημοσύνη έχει αρχίσει να γίνεται viral από την εποχή της σύγκρουσης Ρωσίας-Ουκρανίας.

Κάθε νέα σύγκρουση ή εκλογική περίοδος παρουσιάζει νέες ευκαιρίες για τους διαδότες παραπληροφόρησης. Αυτό έχει κάνει πολλούς ειδικούς στην Τεχνητή Νοημοσύνη και πολιτικούς επιστήμονες να προειδοποιούν για κινδύνους το επόμενο έτος, όταν αρκετές χώρες θα διεξαγάγουν σημαντικές εκλογές, συμπεριλαμβανομένων των Ηνωμένων Πολιτειών, της Ινδίας, του Πακιστάν, της Ουκρανίας, της Ινδονησίας και του Μεξικού.

Ο κίνδυνος η Τεχνητή Νοημοσύνη και τα μέσα κοινωνικής δικτύωσης να χρησιμοποιηθούν για τη διάδοση ψεμάτων στους Αμερικανούς ψηφοφόρους έχει ανησυχήσει νομοθέτες και από τα δύο κόμματα στην Ουάσινγκτον. Σε πρόσφατη ακρόαση σχετικά με τους κινδύνους της τεχνολογίας deepfake, ο Αμερικανός βουλευτής Τζέρι Κόνολι, Δημοκρατικός από τη Βιρτζίνια, δήλωσε ότι οι ΗΠΑ πρέπει να επενδύσουν στη χρηματοδότηση της ανάπτυξης εργαλείων Τεχνητής Νοημοσύνης που έχουν σχεδιαστεί για την αντιμετώπιση άλλων μορφών Τεχνητής Νοημοσύνης.

Η αποτελεσματική αντιμετώπιση των πολιτικών και κοινωνικών προκλήσεων που θέτει η παραπληροφόρηση που παράγεται από την τεχνητή νοημοσύνη θα απαιτήσει τόσο καλύτερη τεχνολογία όσο και καλύτερη ρύθμιση, δήλωσε ο καθηγητής του Πανεπιστημίου του Μπάφαλο, Ντέιβιντ Ντόρμαν.

Μάι Αν (σύμφωνα με το AP)

[διαφήμιση_2]

Πηγή

![[Φωτογραφία] Μοναδική αρχιτεκτονική του βαθύτερου σταθμού μετρό στη Γαλλία](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/14/1763107592365_ga-sau-nhat-nuoc-phap-duy-1-6403-jpg.webp)

Σχόλιο (0)