Si alguna vez has navegado por las redes sociales, es probable que te hayas topado con imágenes o vídeos creados por IA. Mucha gente ha caído en la trampa, como con el vídeo viral de conejos saltando en un trampolín. Pero Sora, una aplicación hermana de ChatGPT desarrollada por OpenAI, está llevando el vídeo con IA a un nuevo nivel, lo que hace que la detección de contenido falso sea cada vez más urgente.

Las herramientas de vídeo con inteligencia artificial están dificultando más que nunca la identificación de vídeos auténticos. (Fuente: CNET)

Lanzada en 2024 y actualizada recientemente con Sora 2, esta aplicación tiene una interfaz similar a la de TikTok, donde todos los videos son generados por IA. La función "cameo" permite insertar personas reales en grabaciones simuladas, creando videos sorprendentemente realistas.

Por lo tanto, muchos expertos temen que Sora provoque la propagación de deepfakes, distorsionando la información y difuminando la línea entre la realidad y la ficción. Las celebridades son particularmente vulnerables, lo que ha llevado a organizaciones como SAG-AFTRA a solicitar a OpenAI que refuerce la protección.

Identificar el contenido generado por IA supone un gran reto para las empresas tecnológicas, las plataformas de redes sociales y los usuarios por igual. Pero existen maneras de reconocer los vídeos creados con Sora.

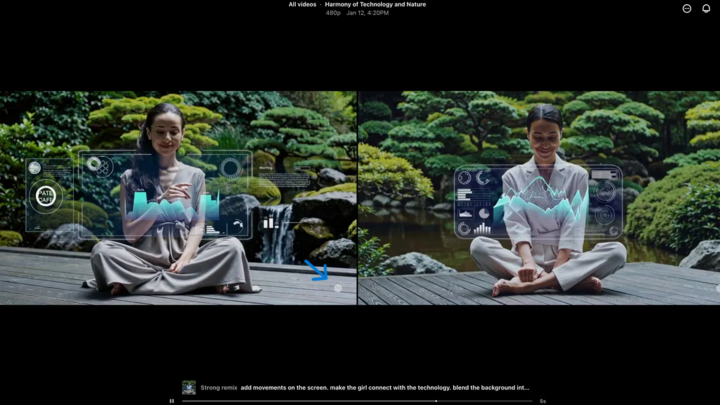

Encuentra la marca de agua de Sora

La marca de agua de Sora (indicada por la flecha azul) es un marcador que identifica la herramienta utilizada para crear el vídeo. (Fuente: CNET)

Todos los vídeos creados con la aplicación Sora para iOS incluyen una marca de agua al descargarlos: el logotipo blanco de Sora (icono de nube) se mueve por los bordes del vídeo, de forma similar a la marca de agua de TikTok.

Esta es una forma visual de identificar contenido generado por IA. Por ejemplo, el modelo Gemini "nano-banana" de Google también añade automáticamente una marca de agua a las imágenes. Sin embargo, las marcas de agua no siempre son fiables. Si la marca de agua es estática, se puede recortar fácilmente. Incluso las marcas de agua dinámicas, como la de Sora, se pueden eliminar con aplicaciones especializadas.

Al ser consultado al respecto, Sam Altman, CEO de OpenAI, argumentó que la sociedad debe adaptarse a la realidad de que cualquiera puede crear videos falsos. Antes de Sora, no existía una herramienta tan popular, accesible y que no requiriera ninguna habilidad para crear este tipo de videos. Su perspectiva subraya la necesidad de recurrir a métodos de verificación alternativos.

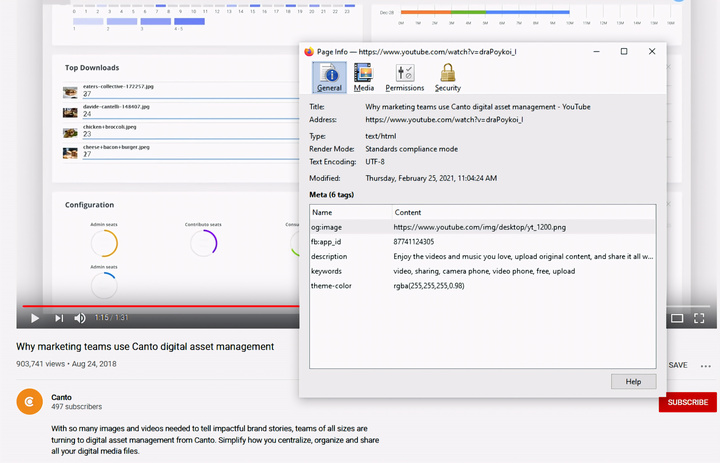

Comprobar metadatos

Verificar los metadatos es un paso crucial para determinar si un video fue creado por IA, como Sora. (Fuente: Canto)

Puede que pienses que comprobar los metadatos es demasiado complicado, pero en realidad es bastante sencillo y muy eficaz.

Los metadatos son un conjunto de información que se adjunta automáticamente al contenido al crearlo, como el tipo de cámara, la ubicación, la hora de grabación y el nombre del archivo. Tanto si el contenido es generado por humanos como por IA, contiene metadatos. En el caso del contenido generado por IA, los metadatos suelen incluir información de autenticación de la fuente.

OpenAI es miembro de la Coalición para el Origen y la Autenticidad del Contenido (C2PA), por lo que los vídeos de Sora contendrán metadatos de C2PA. Puedes comprobarlo utilizando la herramienta de verificación de la iniciativa de autenticidad del contenido:

Cómo comprobar los metadatos:

- Visita verify.contentauthenticity.org

- Sube el archivo para que sea revisado.

- Pulsa “Abrir”

- Consulte la información en la tabla de la derecha.

Si el vídeo fue creado con IA, el resumen lo indicará claramente. Al revisar los vídeos de Sora, verás la frase "publicado por OpenAI" e información que confirma que el vídeo fue creado con IA. Todos los vídeos de Sora deben incluir esta información para verificar su origen.

Fuente: https://vtcnews.vn/cach-nhan-biet-video-that-hay-do-ai-tao-ar972891.html

![[Foto] “Viaje Rojo” 2026: La juventud vietnamita continúa construyendo el puente de la amistad entre Vietnam y China.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/04/20/1776629730866_4055880775670638308-9618-4200-jpg.webp)

Kommentar (0)