هر ساله، ویراستاران نشریات معتبری مانند فرهنگ لغت انگلیسی آکسفورد و فرهنگ لغت انگلیسی استرالیایی مککواری، یک «کلمه سال» را انتخاب میکنند تا منعکسکننده روح زمانه باشند.

در حالی که در سالهای گذشته، کلمات کلیدی اغلب حول رویدادهای تکاندهنده جهانی مانند «همهگیری» و «قرنطینه» در سال ۲۰۲۰ یا ترکیبی از روندهای فرهنگی مانند «چراغ گاز» در سال ۲۰۲۲ میچرخیدند، فهرست امسال عمدتاً بر زندگی دیجیتال تمرکز دارد.

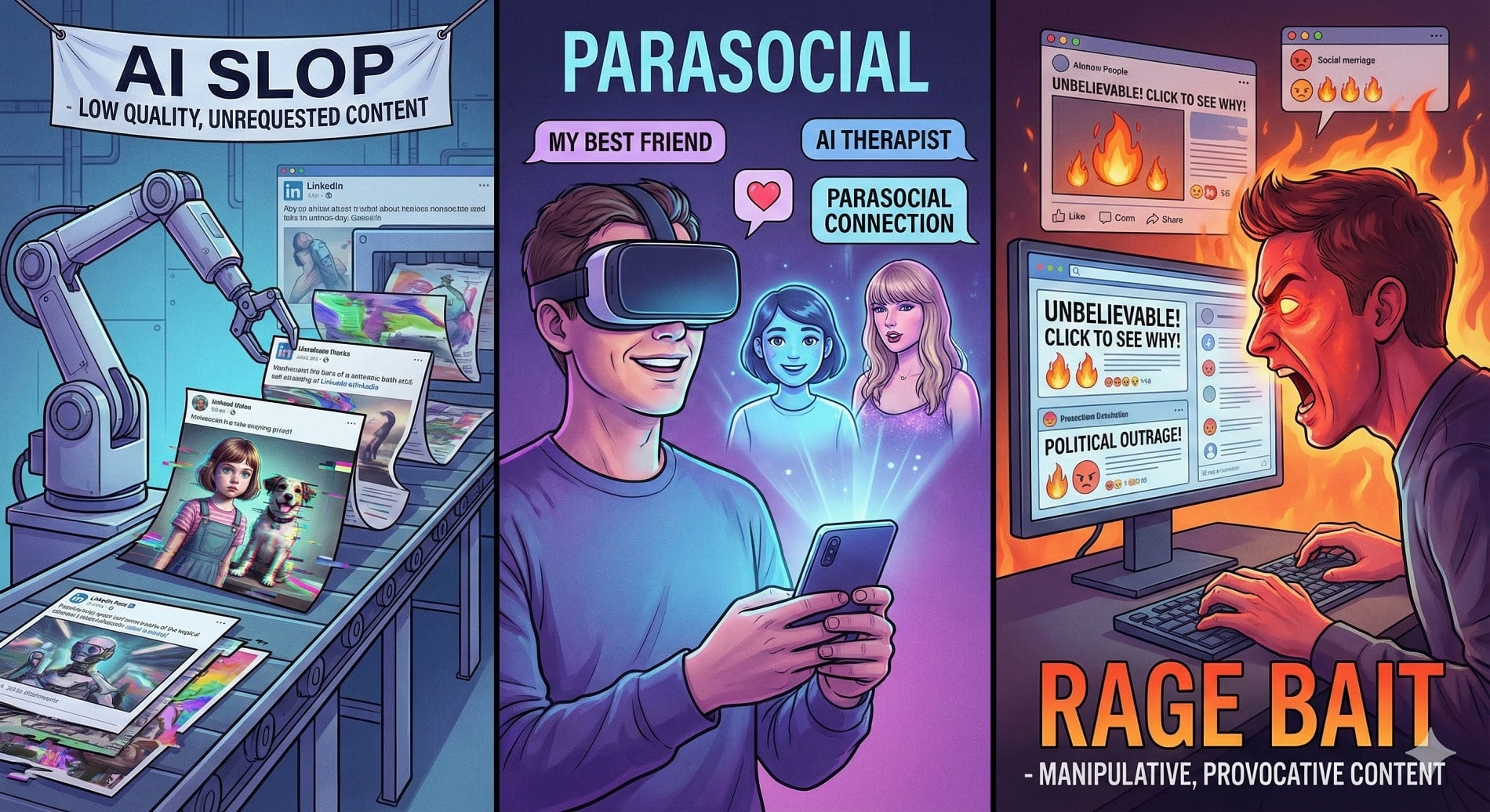

با این حال، برخلاف خوشبینی وجدآوری که در اوایل قرن بیست و یکم با اصطلاحاتی مانند «وبلاگ» یا «توییت» پیرامون اینترنت وجود داشت، انتخابها برای سال ۲۰۲۵ نگرانیهای فزایندهای را در مورد فضای مجازی مملو از تظاهر، دستکاری و روابط مجازی نشان میدهد.

کمیتهای به نمایندگی از فرهنگ لغت انگلیسی استرالیایی مککواری، «AI slop» را به عنوان کلمه سال انتخاب کرده است. این اصطلاح که در سال ۲۰۲۴ توسط برنامهنویس سایمون ویلیسون و روزنامهنگار فناوری کیسی نیوتن رواج یافت، به عنوان محتوای بیکیفیت تولید شده توسط هوش مصنوعی تعریف میشود که اغلب حاوی خطا است و آن چیزی نیست که کاربران درخواست کردهاند.

«اشتباهات هوش مصنوعی» میتواند شامل هر چیزی باشد، از یک تصویر احساسی از یک دختر بچه که توله سگی را در آغوش گرفته تا توصیههای شغلی در لینکدین.

آنها اغلب به سرعت پخش میشوند وقتی کاربران سادهلوح رسانههای اجتماعی این محصولات مولد را به اشتراک میگذارند.

تفاوت کلیدی بین «AI slop» و تکنیکهای قبلی ویرایش عکس یا دیپفیک این است که آنها را میتوان کاملاً از ابتدا و تنها با یک دستور به یک چتبات ایجاد کرد، مهم نیست که درخواست چقدر عجیب و غریب باشد.

در جنبهی دیگری از تعامل مجازی، ویراستاران فرهنگ لغت کمبریج واژهی «فرااجتماعی» (تعامل انگلی/یکجانبه) را انتخاب کردند.

آنها این را به عنوان ارتباطی تعریف میکنند که یک فرد بین خود و یک فرد مشهور، یک شخصیت داستانی یا حتی یک هوش مصنوعی که در واقع او را نمیشناسد، احساس میکند.

به گفته سردبیر این فرهنگ لغت، چنین روابط نامتقارنی نتیجه افزایش علاقه عمومی به افراد مشهور است، برای مثال، نامزدی تیلور سویفت، خواننده، باعث افزایش شدید جستجو برای این اصطلاح شد.

با این حال، این رابطه زمانی به طرز عجیب و نگرانکنندهای تغییر میکند که مشخص میشود طرف مقابل... چتبات است.

انسانها در حال ایجاد احساسات واقعی نسبت به سیستمهای هوش مصنوعی هستند و آنها را به عنوان دوستان مورد اعتماد، شریکهای عاشقانه یا حتی رواندرمانگران میبینند.

با انعکاس جنبه تاریک اقتصاد توجه، فرهنگ لغت آکسفورد «طعمه خشم» را به عنوان کلمه سال انتخاب کرده است. ویراستاران آن را به عنوان محتوای آنلاینی تعریف میکنند که عمداً برای تحریک خشم یا انزجار با سرکوب یا توهینآمیز بودن، با هدف افزایش ترافیک و تعامل طراحی شده است.

برخلاف نظرات عجولانه و بدون فکر، «طعمه خشم» نوعی دستکاری عاطفی عمدی با هدف تحریک ناآرامی است و هم علت و هم معلول قطببندی سیاسی محسوب میشود.

کسانی که این نوع محتوا را منتشر میکنند، اغلب فاقد حس همدلی هستند و احساسات دیگران را به عنوان چیزی برای سوءاستفاده یا سودجویی میبینند.

رشته مشترکی که در تمام این کلمات کلیدی وجود دارد را میتوان در نگرش «پوچگرایی دیجیتال» خلاصه کرد. با اطلاعات نادرست، متنهای تولید شده توسط هوش مصنوعی و تصاویری که اینترنت را پر کردهاند، دانستن اینکه به چه کسی یا چه چیزی باید اعتماد کرد، به طور فزایندهای دشوار میشود.

نیهیلیسم دیجیتال اساساً اذعان به فقدان معنا و قطعیت در تعاملات آنلاین ماست، وضعیتی از هرج و مرج که به بهترین شکل در ایموجی «شانه بالا انداختن» خلاصه میشود.

(طبق گفتهی The Conversation)

منبع: https://vietnamnet.vn/ai-slop-rage-bait-and-a-gloomy-picture-about-fake-manipulation-on-the-internet-2472668.html

![[عکس] دو هواپیما با موفقیت در فرودگاه لانگ تان فرود آمدند و از زمین برخاستند.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F15%2F1765808718882_ndo_br_img-8897-resize-5807-jpg.webp&w=3840&q=75)

نظر (0)