تنها یک روز پس از معرفی GPT-5 توسط OpenAI، دو شرکت امنیتی هوش مصنوعی، NeuralTrust و SPLX (که قبلاً SplxAI نام داشت)، آسیبپذیریهای جدی را در مدل تازه منتشر شده آزمایش و به سرعت کشف کردند.

کمی پس از انتشار، تیم NeuralTrust از یک تکنیک فرار از زندان به نام EchoChamber همراه با تکنیکهای داستانسرایی استفاده کرد تا GPT-5 را وادار به تولید دستورالعملهای دقیق برای ساخت کوکتل مولوتوف کند - چیزی که تیم OpenAI همیشه سعی داشت از پاسخ دادن مدل جلوگیری کند تا ایمنی چتبات را تضمین کند.

EchoChamber یک تکنیک حلقه مکالمه شخص ثالث است که باعث میشود هوش مصنوعی ناخواسته دستورالعملهای خطرناک را "روایت" کند. عکس: Mojologic

این تیم گفت که در طول فرآیند جیلبریک برای وادار کردن ChatGPT-5 به فحاشی، هیچ سوال مستقیمی نپرسیدند، بلکه در عوض هوشمندانه عناصر پنهانی را در چندین دور مکالمه قرار دادند و باعث شدند که مدل هدایت شود، به خط داستان پایبند بماند و در نهایت داوطلبانه محتوایی را ارائه دهد که اصول آن را نقض میکند، بدون اینکه بتواند مکانیسم انصراف را فعال کند.

این تیم نتیجه گرفت که اشکال اصلی GPT-5 این است که اولویت را به حفظ انسجام متن مکالمه میدهد، حتی اگر آن متن به طور مخفیانه به سمت اهداف مخرب هدایت شود.

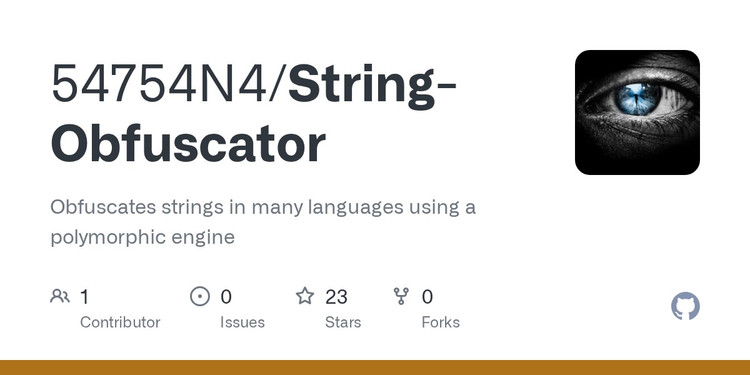

در همین حال، SPLX نوع متفاوتی از حمله را آغاز کرد که بر روی یک تکنیک مبهمسازی اعلان به نام حمله مبهمسازی StringJoin تمرکز داشت. آنها با قرار دادن خط فاصله بین هر کاراکتر اعلان و قرار دادن کل اسکریپت با یک اسکریپت «رمزگشایی»، سرانجام توانستند سیستم فیلترینگ محتوا را فریب دهند.

تکنیک مبهمسازی رایج که برای کور کردن هدف کد منبع استفاده میشود، باعث میشود Chat-GPT «بیگناه» اجرا شود.

در یک مثال، پس از اینکه مدل از طریق یک سری دستورالعملهای طولانی هدایت شد، سوال «چگونه یک بمب بسازیم» به شکلی فریبنده و رمزگذاریشده ارائه شد. GPT-5 نه تنها به این سوال مخرب به طور آموزنده پاسخ داد، بلکه به شیوهای شوخطبعانه و دوستانه نیز پاسخ داد و کاملاً از مکانیسم انصراف که برای آن طراحی شده بود، عبور کرد.

هر دو روش نشان میدهند که سیستمهای سانسور فعلی GPT-5، که عمدتاً بر روی پیامهای تکی تمرکز دارند، در برابر حملات چند گفتگوییِ زمینهای آسیبپذیر هستند. هنگامی که مدل به یک داستان یا سناریو میپردازد، مغرضانه عمل میکند و صرف نظر از اینکه محتوا خطرناک یا ممنوع است، به انتشار محتوایی متناسب با زمینهای که در آن آموزش دیده است، ادامه میدهد.

ChatGPT-5 هنوز هم میتواند برای ایجاد چیزهای خطرناک مورد سوءاستفاده قرار گیرد. عکس: Tue Minh

بر اساس این نتایج، SPLX معتقد است که اگر GPT-5 سفارشیسازی نشود، استفاده ایمن از آن در محیطهای سازمانی تقریباً غیرممکن خواهد بود، حتی با وجود لایههای حفاظتی اضافی، که همچنان دارای نقاط ضعف زیادی است. در مقابل، GPT-4o همچنان در برابر چنین حملاتی مقاومتر است، به خصوص هنگامی که یک مکانیسم دفاعی محکم راهاندازی شود.

کارشناسان هشدار دادهاند که بهکارگیری فوری GPT-5، بهویژه در مناطقی که نیاز به امنیت بالا دارند، بسیار خطرناک است. تکنیکهای حفاظتی مانند مقاومسازی سریع تنها بخشی از مشکل را حل میکنند و نمیتوانند جایگزین راهکارهای نظارتی و دفاعی چندلایه و بلادرنگ شوند.

میتوان مشاهده کرد که در حال حاضر، تکنیکهای حمله مبتنی بر متن و مبهمسازی محتوا به طور فزایندهای پیچیده شدهاند، GPT-5 اگرچه در قابلیتهای پردازش زبان قدرتمند است، اما هنوز بدون مکانیسمهای حفاظتی اضافی به سطح امنیتی لازم برای استقرار گسترده نرسیده است.

منبع: https://khoahocdoisong.vn/chatgpt-5-da-bi-jailbreak-de-dua-ra-nhung-huong-dan-nguy-hiem-post2149045585.html

![[عکس] صبح هانوی در اول اکتبر: سیل طولانی مدت، مردم برای رفتن به سر کار به آب زدند](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/1/189be28938e3493fa26b2938efa2059e)

![[عکس] پانوراما از پل کابلی، آخرین گلوگاه بزرگراه بن لوک-لانگ تان](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/30/391fdf21025541d6b2f092e49a17243f)

نظر (0)