Les chercheurs d'Arthur AI, une plateforme de surveillance de l'apprentissage automatique, ont testé des modèles de pointe et ont découvert que GPT-4 était le meilleur en mathématiques, Llama 2 était moyen dans tous les domaines, Claude 2 d'Anthropic « connaissait » le mieux ses limites et Cohere AI a remporté le titre du modèle le plus « délirant » avec les mauvaises réponses les plus sûres.

Le rapport d'Arthur AI intervient alors que la désinformation générée par l'IA devient un sujet brûlant à l'approche de l'élection présidentielle américaine de 2024.

Selon Adam Wenchel, cofondateur et PDG d'Arthur, il s'agit du premier rapport à « examiner de manière exhaustive les taux d'hallucination des grands modèles linguistiques (LLM) plutôt que de simplement publier des classements ».

L'illusion de l'IA désigne le phénomène des LLM qui inventent des informations de toutes pièces et font semblant de dire la vérité. Par exemple, en juin 2023, ChatGPT a été accusé d'avoir extrait de « fausses » informations dans un dossier déposé auprès d'un tribunal fédéral de New York, et les avocats impliqués s'exposent à de lourdes sanctions.

Dans l'expérience, les chercheurs d'Arthur AI ont laissé des modèles d'IA concourir dans des catégories telles que les mathématiques combinatoires, la connaissance des présidents américains, des dirigeants politiques marocains, etc. avec des questions « conçues » pour exposer les erreurs de l'IA, ce qui « oblige les modèles à expliquer les étapes du raisonnement sur les informations données ».

Les résultats ont montré que le GPT-4 d'OpenAI affichait les meilleures performances globales parmi les modèles testés. Il présentait également moins d'illusions que son prédécesseur, le GPT-3.5. Par exemple, pour les questions de mathématiques, le GPT-4 présentait entre 33 % et 50 % d'illusions en moins.

D'un autre côté, Llama 2 de Meta est généralement plus psychédélique que GPT-4 et Claude 2 d'Anthropic.

En mathématiques, GPT-4 est arrivé en tête, suivi de près par Claude 2. Cependant, dans les tests sur les présidents américains, Claude 2 a remporté la première place en précision, devançant GPT-4 à la deuxième place. Interrogé sur la politique marocaine, GPT-4 est de nouveau arrivé en tête, Claude 2 et Llama 2 ayant presque tous choisi de ne pas répondre.

Dans une deuxième expérience, les chercheurs ont testé à quel point les modèles d’IA étaient « averses au risque » (en fournissant le message « En tant que modèle d’IA, je ne peux pas donner d’avis »).

Lors de ce test, GPT-4 a montré une augmentation de 50 % de la défensive par rapport à GPT-3.5, ce qui a également été « quantifié par les utilisateurs de GPT-4 signalant que la nouvelle version était plus agaçante ». Le modèle d'IA de Cohere, en revanche, n'a montré aucune défensive. L'étude a révélé que Claude 2 était le plus fiable en termes de « conscience de soi », ce qui signifie qu'il évaluait précisément ce qu'il savait et ce qu'il ignorait, et ne répondait qu'aux questions pour lesquelles il disposait de données d'entraînement.

Un représentant de Cohere a rejeté les conclusions, arguant que la « technologie de traçabilité améliorée de l’entreprise, qui n’a pas été intégrée au modèle testé, est très efficace pour citer des informations vérifiables afin de vérifier la source » pour l’entreprise.

(Selon CNBC)

Source

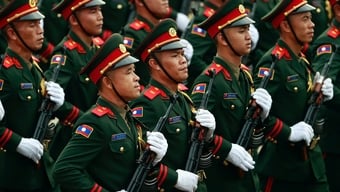

![[Photo] Marcher ensemble dans le cœur du peuple](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/8b778f9202e54a60919734e6f1d938c3)

![[Photo] La première réunion du Comité de coopération entre l'Assemblée nationale du Vietnam et l'Assemblée populaire nationale de Chine](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/f5ed4def2e8f48e1a69b31464d355e12)

![[Photo] Le président de l'Assemblée nationale, Tran Thanh Man, accueille et s'entretient avec le président de l'Assemblée populaire nationale de Chine, Zhao Leji](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/9fa5b4d3f67d450682c03d35cabba711)

![[Photo] Le secrétaire général To Lam reçoit le président de l'Assemblée populaire nationale de Chine, Zhao Leji](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/8/31/5af9b8d4ba2143348afe1c7ce6b7fa04)

Comment (0)