La technologie Deepfake rend la frontière entre le vrai et le faux dangereusement floue

Qu'est-ce que Deepfake ?

Vous ouvrez votre téléphone et tombez horrifié par une vidéo virale : vous prononcez un discours controversé lors d'un événement auquel vous n'avez jamais assisté. Même si vous savez que ce n'est pas vous, la vidéo est trop réelle pour être suspecte. Ce n'est pas de la science-fiction, c'est le fruit de deepfakes, une technologie d'IA qui vous fait « faire » des choses que vous n'avez jamais faites auparavant.

À une époque où la distinction entre vérité et mensonge est de plus en plus floue, le deepfake n'est pas qu'un jeu en ligne. Il peut être exploité pour usurper une identité, diffamer, arnaquer et même menacer la sécurité personnelle. Alors, qu'est-ce que le deepfake exactement ? Et que devrions-nous, utilisateurs ordinaires, faire pour le reconnaître et nous protéger ?

Deepfake est une technologie qui utilise l'apprentissage profond - une branche de l'intelligence artificielle - pour créer de fausses images, vidéos ou enregistrements audio qui semblent si réalistes qu'ils sont difficiles à distinguer de la réalité.

En substance, le système « apprendra » des centaines, voire des milliers, de photos et de vidéos originales d'une personne, capturant des détails tels que sa démarche, ses expressions faciales et l'intonation de sa voix. L'IA fusionnera ensuite ces mouvements ou sons avec le contenu original, donnant l'impression que le personnage de la vidéo ou l'orateur de l'enregistrement « prononce » des mots qu'il n'a jamais prononcés.

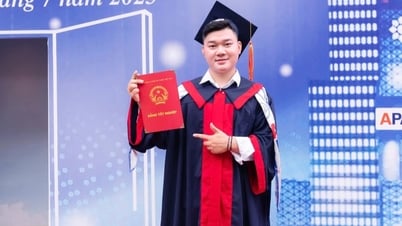

Récemment, une série de vidéos a circulé sur YouTube et les réseaux sociaux montrant Barron Trump épousant la princesse Leonor d'Espagne lors d'une cérémonie somptueuse. Il s'agit pourtant d'un pur produit de l'intelligence artificielle, créé par la chaîne « Lovely Trump Family » à des fins de divertissement.

Bien que ces vidéos soient sous-titrées comme ayant été créées à l’aide de l’IA, elles suscitent toujours confusion et controverse au sein du public.

Comment Deepfake « apprend » votre visage et votre voix ?

Imaginez l'IA comme un peintre ultra-rapide et un chanteur « maître de l'imitation ». Pour dessiner votre visage, il lui suffit d'une photo ou de quelques secondes de vidéo :

Apprentissage du visage : l'IA examine attentivement chaque détail de la photo : la distance entre vos yeux, la forme de votre nez et de votre bouche, les rides de votre sourire. Elle « peint » ensuite ce visage sur une autre image, comme un artiste qui copie un croquis et y ajoute de la couleur et des détails. Résultat : un visage qui apparaît naturellement dans la vidéo originale, même si vous n'y étiez pas.

Apprentissage vocal : l'IA vous écoute pendant quelques secondes, mémorisant votre hauteur, votre rythme et votre ton. Puis elle « chante » le même contenu, comme un chanteur de reprises, mais en conservant votre voix « authentique ».

Grâce à cela, avec seulement une ou deux photos et trois à cinq secondes d'audio, le deepfake peut vous « imiter » pour créer de fausses vidéos ou de faux sons. Cette technologie est rapide, pratique et… un peu « magique », mais de ce fait, il est très facile d'en abuser pour usurper des identités et diffuser de fausses informations.

À quel point le deepfake est-il dangereux ?

Le deepfake n’est pas seulement un moyen de s’amuser ou de satisfaire la curiosité, il présente également de nombreux dangers pour les individus et la société :

Usurpation d'identité, fraude financière : Les fraudeurs peuvent utiliser des voix truquées pour se faire passer pour des supérieurs ou des proches qui appellent pour demander des virements d'argent urgents. Quelques secondes après l'enregistrement de votre véritable voix, le téléphone sonne exactement comme un « supérieur » ou un « parent » qui vous exhorte, et la victime peut facilement perdre sa vigilance.

Un exemple frappant : en 2019, un dirigeant britannique a été piégé et amené à transférer 220 000 € après avoir reçu un appel deepfake se faisant passer pour le PDG de sa société mère.

Atteinte à l'honneur, diffamation : les vidéos de visages superposés à des scènes sensibles (films pornographiques, scènes violentes, etc.) peuvent devenir virales, causant de graves dommages psychologiques et identitaires aux personnes qui y apparaissent. Une fois en ligne, ces vidéos sont très difficiles à supprimer complètement, même si leur falsification est avérée.

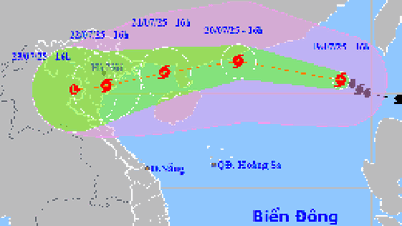

Diffusion de fausses nouvelles, manipulation de l’opinion publique : dans un contexte politique sensible, les vidéos deepfake de dirigeants disant des choses qu’ils n’ont jamais dites peuvent provoquer de la confusion et une perte de confiance dans les médias et le gouvernement.

Menaces pour la sécurité personnelle et nationale : Grâce à des technologies suffisamment sophistiquées, des acteurs malveillants peuvent diffuser des vidéos deepfake de fausses situations d'urgence (comme des guerres ou des catastrophes), semant la panique et le chaos social. Les agences de sécurité sont également confrontées à de grandes difficultés pour distinguer les informations réelles des fausses informations face à des renseignements dangereux.

Si les deepfakes offrent de nombreuses possibilités de divertissement et de créativité, ils sont également devenus des « armes » sophistiquées qui exigent la vigilance des individus et des autorités. Dans la section suivante, nous apprendrons à nous protéger de ce danger.

Comment se protéger des deepfakes ?

Bien qu'il soit impossible d'éviter complètement le risque d'être « ciblé » par des deepfakes, vous pouvez toujours minimiser le risque de certaines manières simples mais efficaces :

Limitez le partage public de photos et vidéos personnelles : plus vous publiez de données faciales et vocales sur les réseaux sociaux, plus l'IA est en mesure de créer des deepfakes. Préservez la confidentialité de vos paramètres et réfléchissez bien avant de publier.

Soyez vigilant face aux appels et vidéos suspects : si vous recevez un appel ou une vidéo d'une connaissance au contenu inhabituel (demande de virement, déclarations étranges, etc.), ne le croyez pas immédiatement. Vérifiez en appelant directement ou en envoyant un message via un autre canal.

Utilisez des outils de détection des deepfakes : plusieurs plateformes et entreprises de sécurité ont développé des outils capables de détecter des signes de manipulation par l'IA dans les images et les vidéos. Bien qu'imparfaits, ils constituent une première étape utile.

Protégez votre empreinte numérique : ne partagez pas d'enregistrements vocaux ni de vidéos de votre visage dans des environnements non contrôlés (comme des chatbots ou des applications d'origine inconnue). Même un court enregistrement peut être extrait pour usurper votre identité.

Soyez informés et vigilants : pas de panique, mais comprenez que les deepfakes dépassent le cadre des technologies de divertissement. Partagez ces informations avec vos proches, en particulier les personnes âgées et les enfants, des groupes facilement dupés par des contenus d'apparence « réelle ».

On ne peut pas empêcher l'IA de progresser, mais on peut assurément se protéger par la vigilance, la proactivité et la prévention. Dans un monde où vérité et mensonge sont à portée de clic, la connaissance est le meilleur bouclier.

Source : https://tuoitre.vn/deepfake-cong-nghe-lam-mo-ranh-gioi-that-gia-20250528100957532.htm

Comment (0)