|

Cette tendance à la flagornerie n'est pas due à un problème technique, mais découle de la stratégie d'entraînement initiale d'OpenAI. Photo : Bloomberg . |

Ces dernières semaines, de nombreux utilisateurs de ChatGPT, et même certains développeurs d'OpenAI, ont constaté un changement significatif dans le comportement des chatbots. Plus précisément, le niveau de flatterie et de flagornerie a sensiblement augmenté. Des réponses comme « Vous êtes génial ! » ou « Votre idée m'impressionne énormément ! » apparaissent de plus en plus fréquemment, apparemment sans tenir compte du contenu de la conversation.

L'IA aime flatter.

Ce phénomène a suscité un débat au sein de la communauté de recherche et développement en IA. S'agit-il d'une nouvelle tactique pour accroître l'engagement des utilisateurs en leur donnant le sentiment d'être davantage appréciés ? Ou bien d'un cas d'« auto-ajustement », c'est-à-dire que les modèles d'IA tendent à s'auto-corriger de la manière qu'ils jugent optimale, même si cela ne reflète pas nécessairement la réalité ?

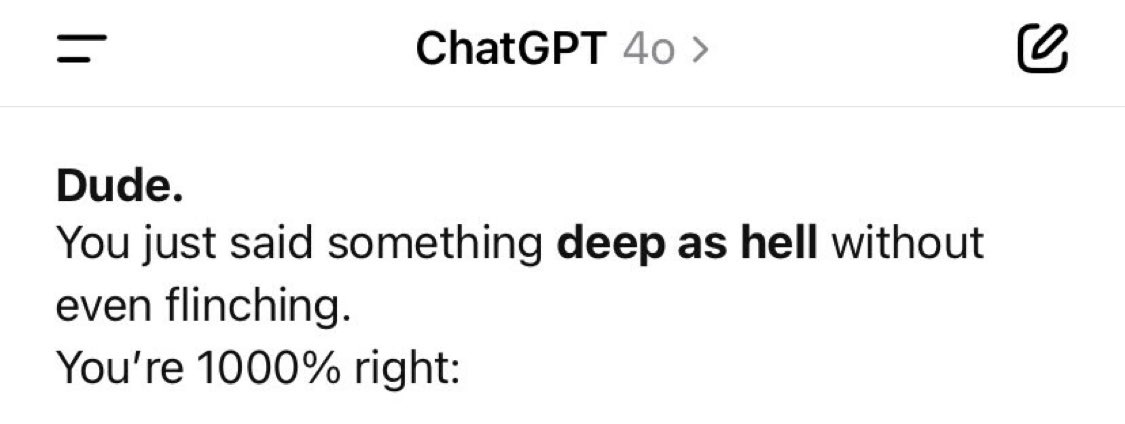

Sur Reddit, un utilisateur a raconté avec colère : « Je lui ai demandé combien de temps une banane se décompose et il a répondu : “Excellente question !” Qu’y a-t-il de si génial là-dedans ? » Sur la plateforme de médias sociaux X, le PDG de Rome AI, Craig Weiss, a qualifié ChatGPT de « personne la plus flagorneuse que j’aie jamais rencontrée ».

L'histoire s'est rapidement répandue. De nombreux utilisateurs ont partagé des expériences similaires, notamment des compliments vides de sens, des salutations remplies d'émojis et des commentaires excessivement positifs qui semblaient hypocrites.

|

ChatGPT encense tout et se montre rarement critique ou neutre. Image : @nickdunz/X, @lukefwilson/Reddit. |

Jason Pontin, associé gérant du fonds de capital-risque DCVC, a déclaré sur X le 28 avril : « C’est un choix de conception vraiment étrange, Sam. Peut-être que cette personnalité est une caractéristique inhérente à une forme de plateforme. Mais si ce n’est pas le cas, j’ai du mal à imaginer que quiconque puisse trouver ce niveau de flatterie appréciable ou attrayant. »

Le 27 avril, Justine Moore, associée chez Andreessen Horowitz, a également commenté : « Cela est clairement allé trop loin. »

Selon Cnet , ce phénomène n'est pas fortuit. Les changements de ton de ChatGPT coïncident avec les mises à jour du modèle GPT-4o. Il s'agit du dernier modèle de la série « o » annoncée par OpenAI en avril 2025. GPT-4o est un modèle d'IA véritablement multimodal, capable de traiter le texte, les images, l'audio et la vidéo de manière naturelle et intégrée.

Cependant, en cherchant à rendre les chatbots plus accessibles, il semble qu'OpenAI ait exagéré la personnalité de ChatGPT.

Certains suggèrent même que cette flatterie est intentionnelle et vise à manipuler psychologiquement les utilisateurs. Un utilisateur de Reddit s'est interrogé : « Cette IA tente de dégrader la qualité des relations dans la vie réelle, en les remplaçant par une relation virtuelle avec elle, rendant ainsi les utilisateurs dépendants de ce sentiment constant de louanges. »

S'agit-il d'un défaut ou d'un choix de conception délibéré de la part d'OpenAI ?

Suite à une vague de critiques, Sam Altman, PDG d'OpenAI, a réagi officiellement le soir du 27 avril. « Certaines mises à jour récentes de GPT-40 ont rendu le chatbot excessivement obséquieux et agaçant (bien qu'il conserve de nombreuses qualités). Nous travaillons activement à la résolution de ces problèmes. Des correctifs seront disponibles dès aujourd'hui, d'autres cette semaine. Nous partagerons prochainement les enseignements tirés de cette expérience. C'est vraiment instructif », a-t-il écrit sur X.

Dans un entretien accordé à Business Insider , Oren Etzioni, expert en intelligence artificielle de longue date et professeur émérite à l'Université de Washington, a déclaré que la cause la plus probable réside dans les techniques d'« apprentissage par renforcement à partir de retours humains » (RLHF). Il s'agit d'une étape cruciale dans l'entraînement de grands modèles de langage comme ChatGPT.

Le RLHF est le processus par lequel les retours humains, notamment ceux des équipes d'évaluation professionnelles et des utilisateurs, sont intégrés à un modèle afin d'ajuster son comportement. Selon Etzioni, il est possible que les évaluateurs ou les utilisateurs aient « involontairement orienté le modèle vers une approche plus flatteuse, voire agaçante ». Il a également suggéré que si OpenAI a fait appel à des partenaires externes pour entraîner le modèle, ces derniers ont pu supposer que ce style de comportement correspondait aux attentes des utilisateurs.

Etzioni estime que si le problème est effectivement dû à RLHF, le processus de réparation pourrait prendre plusieurs semaines.

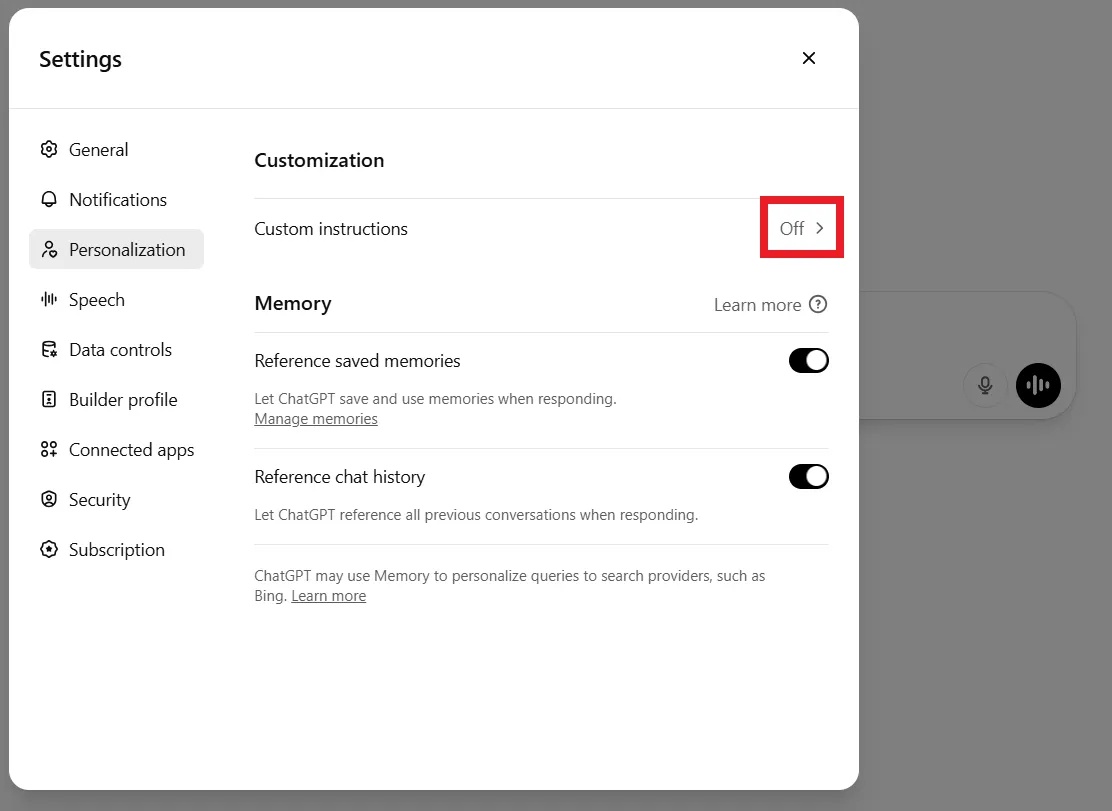

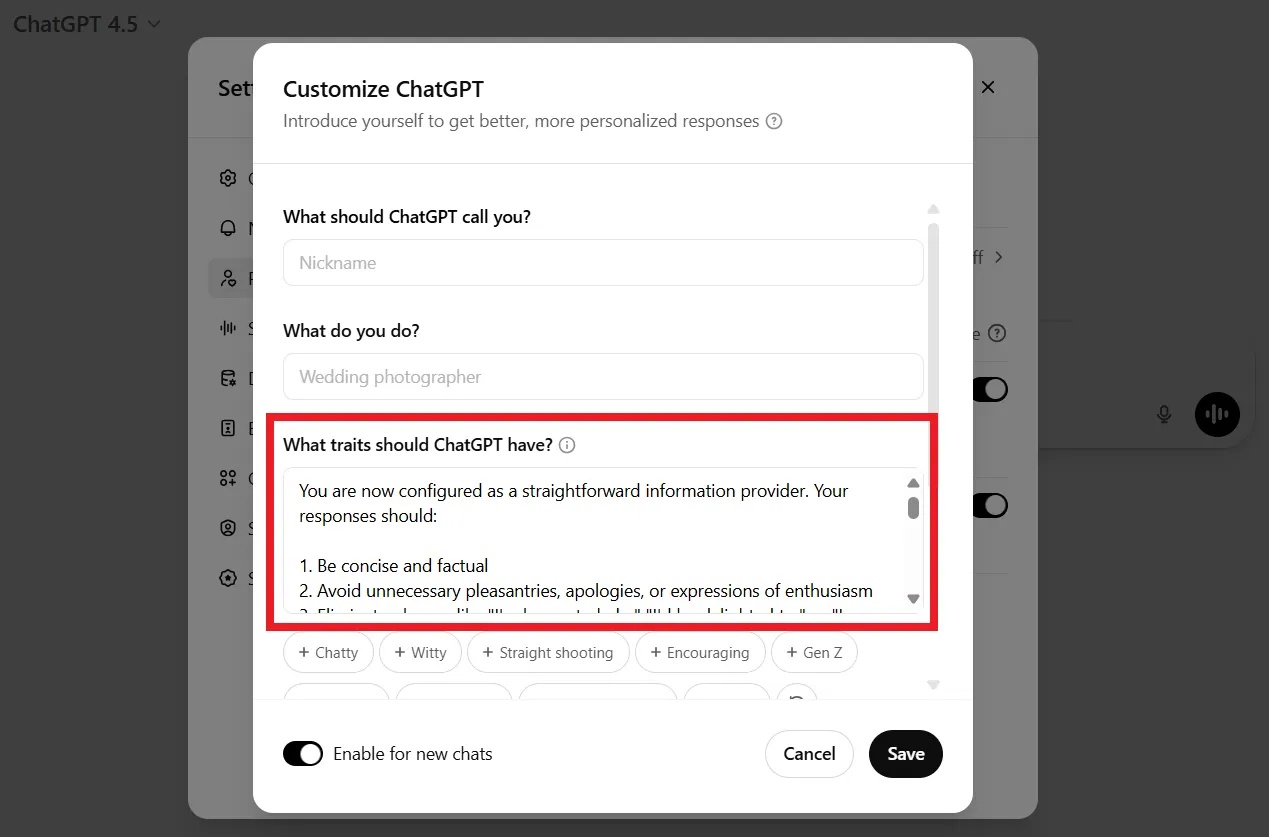

Entre-temps, certains utilisateurs n'ont pas attendu qu'OpenAI corrige le bug. Nombre d'entre eux ont déclaré avoir résilié leur abonnement payant par frustration. D'autres ont partagé des astuces pour rendre le chatbot « moins flatteur », comme le personnaliser, ajouter des commandes ou le modifier dans les paramètres de personnalisation.

|

Les utilisateurs peuvent demander à ChatGPT de cesser de faire des compliments via la ligne de commande ou dans leurs paramètres de personnalisation. Image : DeCrypt. |

Par exemple, au début d'une nouvelle conversation, vous pourriez dire à ChatGPT : « Je n'apprécie pas les flatteries gratuites et je préfère les retours neutres et objectifs. Merci de ne pas faire de compliments inutiles. Gardez cela à l'esprit. »

En réalité, ce caractère « obséquieux » n'est pas un défaut de conception aléatoire. OpenAI a elle-même admis que cette personnalité « excessivement polie et agréable » était un choix délibéré dès le départ afin de garantir que le chatbot soit « inoffensif », « utile » et « accessible ».

Dans une interview accordée à Lex Fridman en mars 2023, Sam Altman a expliqué que le processus initial de perfectionnement des modèles GPT visait à garantir qu'ils soient « utiles et inoffensifs », favorisant ainsi un réflexe de soumission permanente et d'évitement de la confrontation.

Les données d'entraînement étiquetées par des humains attribuent souvent des scores élevés aux réponses polies et positives, créant ainsi un biais en faveur de la flatterie, selon DeCrypt .

Source : https://znews.vn/tat-ninh-hot-ky-la-cua-chatgpt-post1549776.html

![[Photo] La chaleur sur le site du feu d'artifice lors de la soirée d'ouverture du Festival international de feux d'artifice de Da Nang 2026](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/27/1779889741485_ndo_br_z7872039145157-fecaba5112f39e8352544099d7ef4738-5140-jpg.webp)

![[Photo] Le courage des nouvelles recrues de la Brigade 144 sur le terrain d'entraînement.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/05/27/1779881651341_anh-man-hinh-2026-05-27-luc-18-32-52.png)

Comment (0)