מחלקת אבטחת המידע פרסמה לאחרונה אזהרה בנוגע להישנות מתמשכת של הונאות וידאו ותמונות מתקדמות.

בהתאם לכך, הרשויות הזהירו באופן נרחב למספר רב של אנשים מפני מצבם של פושעי סייבר המנצלים תמונות וסרטונים ציבוריים של אנשים כדי לערוך, לחתוך ולאיים לסחוט באמצעות סרטונים מזויפים.

באמצעות טכנולוגיית Deepfake המאפשרת שחזור של צליל ותמונה של אדם בדיוק גבוה, פושעים יכולים לחזות למנהיגים בפגישות מקוונות, או ליצור סרטונים ושיחות כדי לבצע הונאה פיננסית.

יתר על כן, הונאות אלו מנצלות לעתים קרובות גורמים פסיכולוגיים כמו דחיפות, פחד או כוח, וגורמות לקורבנות לפעול בחיפזון מבלי לבדוק בקפידה את האותנטיות.

זיופים עמוקים אינם מוגבלים להונאות השקעות פיננסיות. דוגמה נוספת היא הונאות רומנטיות, בהן זיופים עמוקים משמשים ליצירת דמויות בדיוניות המקיימות אינטראקציה עם קורבנות באמצעות שיחות וידאו; לאחר שזכו באמון הקורבן, הנוכל יבקש העברות כספים לפתרון מצבי חירום, הוצאות נסיעה או הלוואות.

לאור המצב הנ"ל, מחלקת אבטחת המידע ממליצה להיזהר מעצות השקעה של ידוענים ברשתות החברתיות; להיזהר מהודעות, מיילים או שיחות לא מוכרות; ולהתבונן היטב בהבעות פנים לא טבעיות בסרטונים.

אנשים צריכים גם להגביל פרסום תוכן הקשור למידע אישי ברשתות חברתיות כדי למנוע גניבה של מידע כמו תמונות, סרטונים או קולות על ידי אנשים רעים; במקביל, להגדיר חשבונות למצב פרטי כדי להגן על מידע אישי.

בשיחה עם כתבים של עיתון דאי דואן קט, אמר מומחה אבטחת הסייבר נגו מין הייאו, מייסד שותף של פרויקט מניעת הונאות הסייבר בווייטנאם (Chongluadao.vn), כי השימוש בטכנולוגיית Deepfake בבינה מלאכותית לזיוף שיחות וידאו למטרות הונאה עדיין מסובך. נבדקים מנצלים טכנולוגיה זו כדי להגביר את אמינות "הטרף" שלהם.

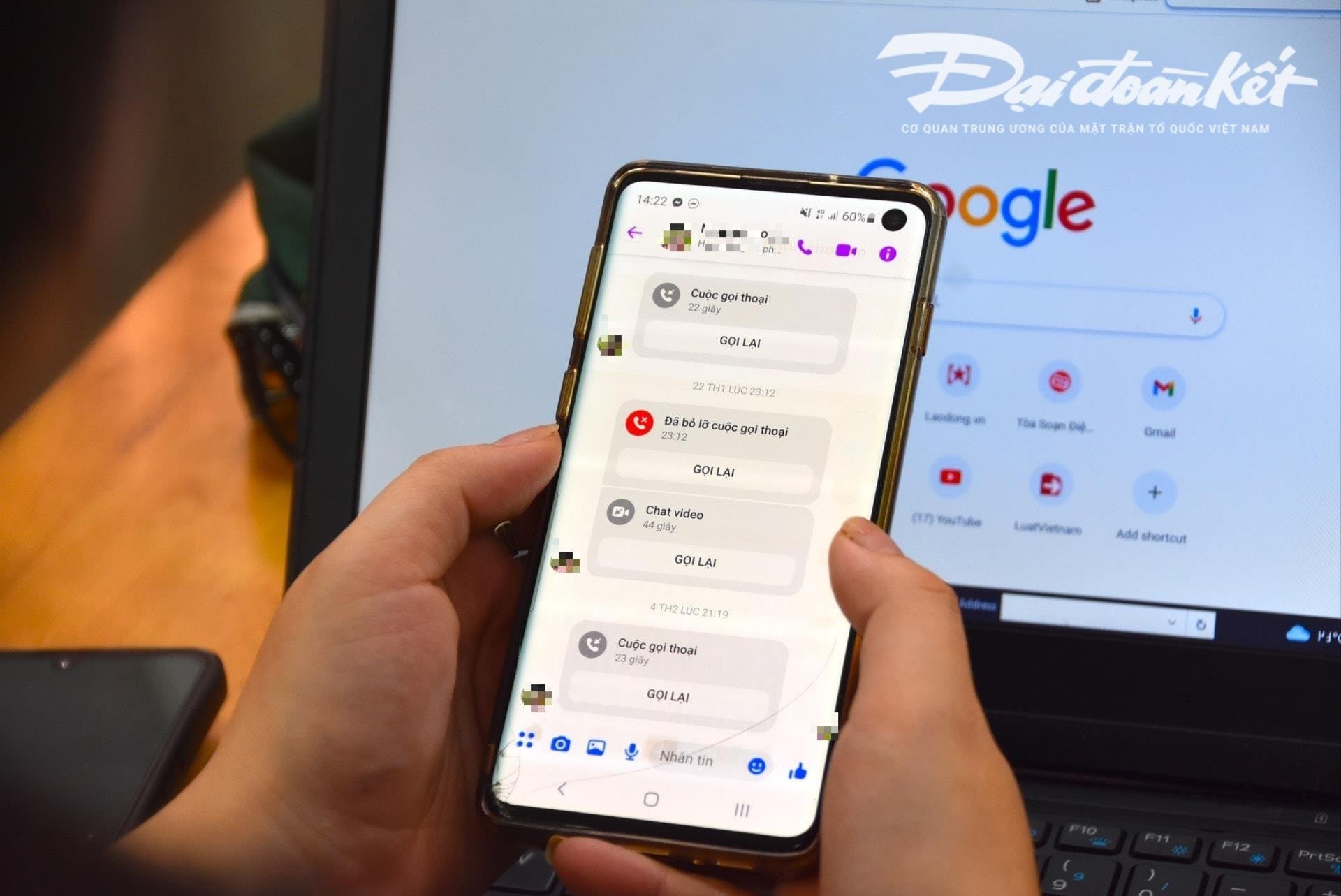

באופן ספציפי, הנבדקים יבצעו באופן יזום שיחות וידאו לקורבנות מתמונות וסרטונים "גנובים" בעבר, ויתמרנו את הטכניקה, יעוותו את הצליל או יעשו בעיות תמונה מזויפות כדי לזכות באמון הקורבן.

בדרך כלל, שיחות אלו קצרות מאוד, נמשכות רק כמה שניות, ואז הם משתמשים בתירוץ של רשת לא יציבה, הימצאות ברחוב וכו' כדי לבקש מהקורבן למלא את בקשותיו של הנוכל.

מומחים מזהירים כי השימוש בבינה מלאכותית לצורך הונאות סייבר צפוי לגדול משמעותית בעתיד הקרוב. לכן, אנשים חייבים להגביר את ערנותם באופן יזום, במיוחד כאשר הם מקבלים הודעות מוזרות, שיחות וידאו וקישורים.

על פי ניתוח של מומחה זה, אלגוריתם הבינה המלאכותית (AI) הנוכחי של Deepfake במהלך שיחות בזמן אמת לא יוכל להתמודד עם זה אם המתקשר יפנה שמאלה, יפנה ימינה או יקום...

חולשה אחת שאנשים צריכים לשים לב אליה בעת קבלת שיחות כאלה היא השיניים. בהתאם לכך, אלגוריתמים של בינה מלאכותית עכשווית אינם יכולים לשחזר את שיניו של האדם שאליו מתחזה.

אם משתמשים ב-Deepfake, ייתכן שלדמות האדם הפותח את פיו אין שיניים, ולחלק מהאנשים יהיו 3 או אפילו 4 לסתות. לכן, מאפייני השיניים הם האלמנט המוכר ביותר בשיחה מזויפת באמצעות Deepfake.

"להאט את הקצב" ואי-מילוי מיידי לבקשה הם תנאי הכרחי כדי להימנע מנפילה למלכודת ההונאה. כאשר אנשים מקבלים הודעה או שיחה דרך רשתות חברתיות, עליהם להתקשר ישירות לקרוביהם כדי לוודא בדיוק מי יוצר איתם קשר, תוך זמן מינימלי של יותר מ-30 שניות, או להיפגש פנים אל פנים.

במקרה של חשד להתחזות לקרובי משפחה ברשתות חברתיות לצורך הונאה או גניבת רכוש, יש לדווח מיד למשטרה הקרובה לקבלת תמיכה וטיפול בזמן.

[מודעה_2]

מקור: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

![[תמונה] דא נאנג: מאות אנשים משתפים פעולה כדי לנקות נתיב תיירותי חיוני לאחר סופה מספר 13](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/07/1762491638903_image-3-1353-jpg.webp)

תגובה (0)