ホアン・オアン(役名は変更されています)はハノイの会社員です。Facebookメッセンジャーで友人とチャットしていたところ、友人は別れを告げて会話を終えたのですが、突然メッセージに戻り、お金を借りたいと言い、銀行口座に振り込むよう提案してきました。

アカウント名は友人の名前と一致していましたが、ホアン・オアンさんは少し疑念を抱き、確認のためにビデオ通話をリクエストしました。友人はすぐに同意しましたが、通話は「ネットワークの断続的な不具合」のため数秒しか続きませんでした。ビデオ通話で友人の顔を確認し、声もその人物のものだったため、ホアン・オアンさんはもう疑うことなく送金しました。しかし、送金が成功した後になって初めて、彼女は自分がハッカーの罠に陥っていたことに気づきました。

ユーザーであるホアン・オアン氏のケースは、人工知能技術を使って被害者の友人や親族の画像や音声を作成し、彼らを騙して財産を奪おうとする詐欺グループの「罠に落ちた」多くの被害者のうちの1人にすぎません。

Bkavの専門家によると、2023年後半、特に2024年の旧正月頃に、この情報セキュリティ会社は、上記と同様の詐欺事件に関する被害者からの報告や支援要請を継続的に受けていたという。

同社の専門家の分析によると、ユーザー Hoang Oanh の場合、犯人は Facebook アカウントを乗っ取ったものの、すぐに完全に乗っ取ったわけではなく、密かにフォローし、被害者のふりをして友人や親戚に金銭を借りるよう依頼する機会を待っていたという。

詐欺師はAIを駆使し、Facebookアカウント所有者の顔と声を模倣した偽の動画(ディープフェイク)を作成します。認証のためにビデオ通話を要求されると、詐欺師は通話に応じますが、すぐに発覚を避けるために切断してしまいます。

Bkavマルウェア研究センター所長のグエン・ティエン・ダット氏は、たとえビデオ通話で親戚や友人の顔が見え、声を聞いたとしても、必ずしもその人と話しているとは限らないと強調した。最近、ディープフェイクや人工知能技術を利用した金融詐欺の被害者が増えている。

「AIを通じてユーザーデータを収集・分析できる能力は、高度な不正戦略の構築を可能にします。これはまた、ディープフェイクとGPTを組み合わせた場合の不正シナリオの複雑さが増し、不正検出がはるかに困難になることを意味します」とグエン・ティエン・ダット氏は述べています。

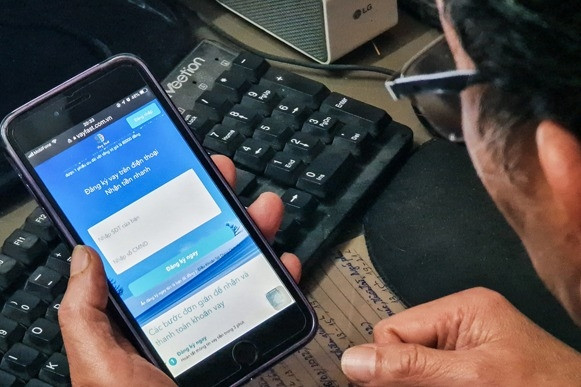

Bkavの専門家は、ユーザーに特に注意を促し、個人情報(IDカード、銀行口座、ワンタイムパスワードなど)を提供しないよう推奨しています。詐欺の兆候がある電話、ソーシャルネットワーク、ウェブサイトを通じて見知らぬ人に送金しないでください。ソーシャルネットワーク経由で口座への融資/送金のリクエストがあった場合は、電話やその他の通信チャネルを使用して再度確認するなど、他の認証方法を使用する必要があります。

2024 年のサイバー攻撃の傾向を予測した専門家は、AI の急速な発展が明らかなメリットをもたらすだけでなく、サイバーセキュリティに重大なリスクも生み出すという点で一致しています。

今日、AI技術に直面する企業や組織にとって最大の課題は、詐欺と高度な持続的脅威(APT)です。特にディープフェイクとGPTを組み合わせることで、詐欺シナリオはますます複雑化しています。AIを通じてユーザーデータを収集・分析できるようになったことで、高度な詐欺戦略が構築され、ユーザーによる詐欺の特定が困難になっています。

AIセキュリティの強化は、今後の紛れもないトレンドです。国際社会は緊密に協力し、新たなセキュリティ対策を開発するとともに、AIの潜在的なリスクに関するユーザーの知識と意識を高める必要があります。

偽のブランドメッセージを拡散する詐欺に注意してください

2024年の旧正月期間中に発生する5つのオンライン詐欺に関する警告

ベトナムにおけるフィッシング攻撃全体の9%は、当局のなりすましによるもの

[広告2]

ソース

![[写真] ファム・ミン・チン首相が住宅政策と不動産市場に関する中央指導委員会の初会合を主宰](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/22/c0f42b88c6284975b4bcfcf5b17656e7)

![[写真] ベトナム国家エネルギー産業グループに一級労働勲章を授与するト・ラム書記長](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/9/21/0ad2d50e1c274a55a3736500c5f262e5)

コメント (0)