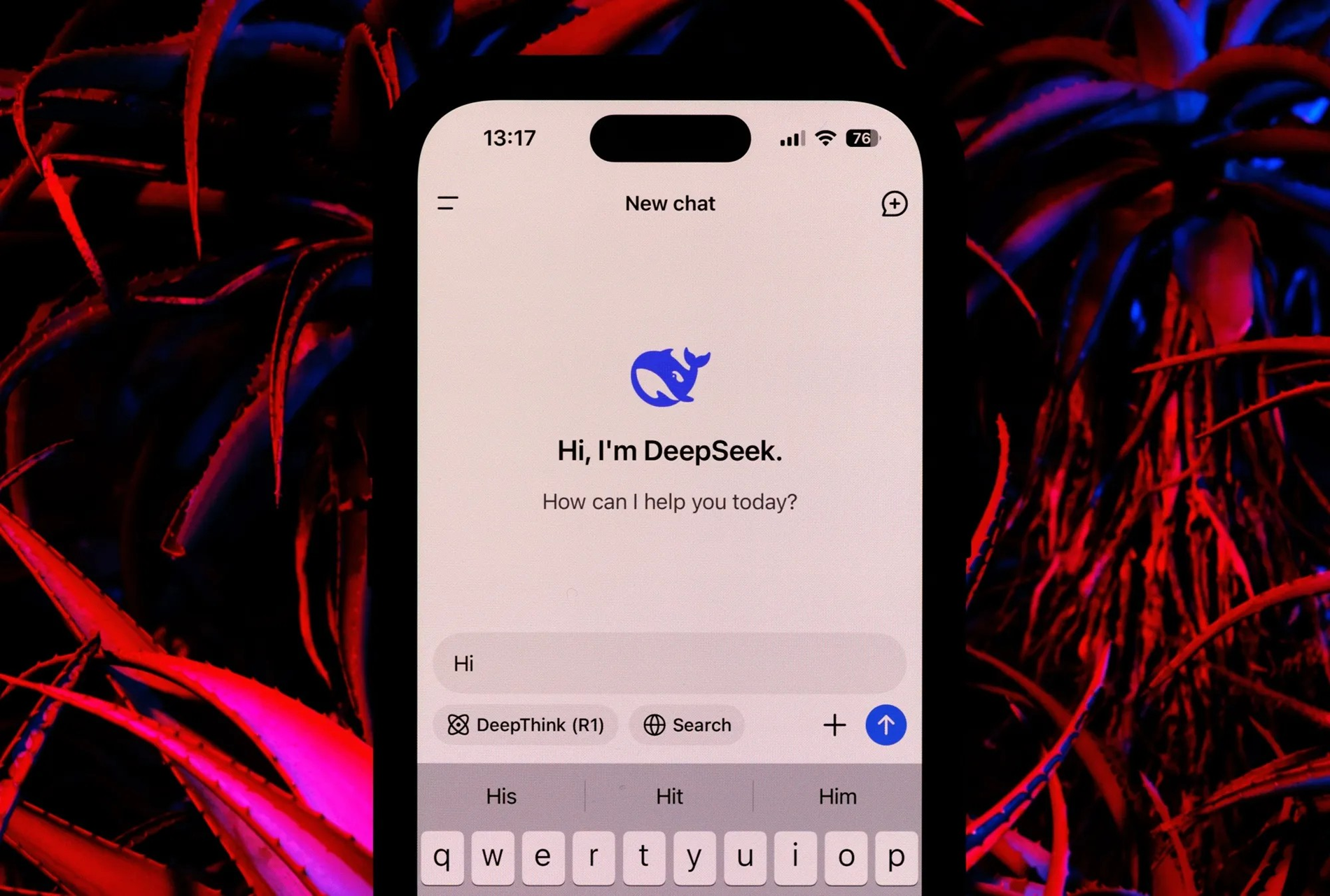

DeepSeek, syarikat baharu China yang paling hangat sejak kebelakangan ini, telah menimbulkan keraguan tentang dakwaannya mencipta AI setanding dengan OpenAI dengan hanya $5 juta.

DeepSeek membuat liputan media dan media sosial yang meluas pada awal Tahun Ular, menyebabkan gegaran yang ketara dalam pasaran saham global.

Walau bagaimanapun, satu laporan baru-baru ini oleh firma perunding kewangan Bernstein memberi amaran bahawa, meskipun terdapat pencapaian yang mengagumkan, dakwaan untuk mewujudkan sistem AI yang setanding dengan OpenAI dengan hanya $5 juta adalah tidak tepat.

Menurut Bernstein, kenyataan DeepSeek itu mengelirukan dan tidak mencerminkan gambaran yang lebih besar.

“Kami percaya DeepSeek tidak ‘mencipta OpenAI dengan $5 juta’; model-modelnya hebat tetapi kami tidak fikir ia adalah keajaiban; dan panik sepanjang hujung minggu nampaknya telah dibesar-besarkan,” kata laporan itu.

DeepSeek membangunkan dua model AI utama: DeepSeek-V3 dan DeepSeek R1. Model bahasa V3 berskala besar memanfaatkan seni bina MOE, menggabungkan model yang lebih kecil untuk mencapai prestasi tinggi sambil menggunakan sumber pengkomputeran yang lebih sedikit berbanding model tradisional.

Sebaliknya, model V3 mempunyai 671 bilion parameter, dengan 37 bilion parameter aktif pada bila-bila masa, menggabungkan inovasi seperti MHLA untuk mengurangkan penggunaan memori dan menggunakan FP8 untuk kecekapan yang lebih tinggi.

Latihan model V3 memerlukan sekumpulan 2,048 GPU Nvidia H800 dalam tempoh dua bulan, bersamaan dengan 5.5 juta jam GPU. Walaupun beberapa anggaran meletakkan kos latihan pada kira-kira $5 juta, laporan Bernstein menekankan bahawa angka ini hanya meliputi sumber pengkomputeran dan tidak mengambil kira kos yang ketara berkaitan dengan penyelidikan, pengujian dan perbelanjaan pembangunan lain.

Model DeepSeek R1 dibina berdasarkan asas V3 dengan menggunakan Pembelajaran Pengukuhan (RL) dan teknik lain untuk memastikan keupayaan inferens.

Model R1 boleh bersaing dengan model OpenAI dalam tugasan penaakulan. Walau bagaimanapun, Bernstein menegaskan bahawa pembangunan R1 memerlukan sumber yang besar, walaupun ini tidak diperincikan dalam laporan DeepSeek.

Mengulas tentang DeepSeek, Bernstein memuji model-model tersebut sebagai sesuatu yang mengagumkan. Contohnya, model V3 berprestasi sebaik atau lebih baik daripada model bahasa utama lain dalam linguistik, pengaturcaraan dan matematik sambil memerlukan sumber yang lebih sedikit.

Proses pra-latihan V3 hanya memerlukan 2.7 juta jam kerja GPU, atau 9% daripada sumber pengkomputeran beberapa model peringkat tinggi yang lain.

Bernstein menyimpulkan bahawa, walaupun kemajuan DeepSeek patut diberi perhatian, seseorang mesti berhati-hati dengan dakwaan yang dibesar-besarkan. Idea untuk mewujudkan pesaing kepada OpenAI dengan hanya $5 juta nampaknya salah arah.

(Menurut Times of India)

[iklan_2]

Sumber: https://vietnamnet.vn/deepseek-khong-the-lam-ai-tuong-duong-openai-voi-5-trieu-usd-2367340.html

![[Imej] Pejabat Parti Pusat meringkaskan kerja pada tahun 2025](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F18%2F1766065572073_vptw-hoi-nghi-tong-ket-89-1204-jpg.webp&w=3840&q=75)

![[Video] Pelancaran dua buah buku mengenai sejarah dan pemeliharaan warisan](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/18/1766072185865_2663241292917005256-4230-jpg.webp)

Komen (0)