Aby lepiej zrozumieć tę kwestię, reporterzy gazety Journalist & Public Opinion przeprowadzili rozmowę z dziennikarzem Nguyen Cao Cuongiem – zastępcą dyrektora Centrum Produkcyjnego Programu VTVcab, ekspertem w dziedzinie komunikacji i mediów społecznościowych.

Produkty zawierające sztuczną inteligencję powinny być odpowiednio oznakowane w momencie ich użycia.

+ Szanowny Panie, jak Pan ocenia obecny rozwój technologii AI, zwłaszcza że ostatnio pojawiła się także aplikacja Sora (brat ChatGPT w firmie OpenAI), która potrafi tworzyć filmy z tekstu?

- Technologia sztucznej inteligencji stosowana w mediach poczyniła ogromne postępy. Wcześniej wykorzystywaliśmy ją głównie do tworzenia statycznych i prostych obrazów. Teraz AI zaczęła również produkować filmy. Właśnie uruchomiono aplikację Sora firmy OpenAI, która umożliwia konwersję tekstu do krótkich filmów o maksymalnej długości poniżej 1 minuty. Sora tworzy filmy z żywymi obrazami, płynnymi ruchami i starannie dobranymi tłami, które nadają im realizmu... Stwarza to ogromne możliwości dla firm technologicznych, firm specjalizujących się w branży medialnej, a nawet agencji prasowych i mediowych, aby wykorzystać ruchome obrazy w formie klipów do ilustrowania swoich produktów medialnych.

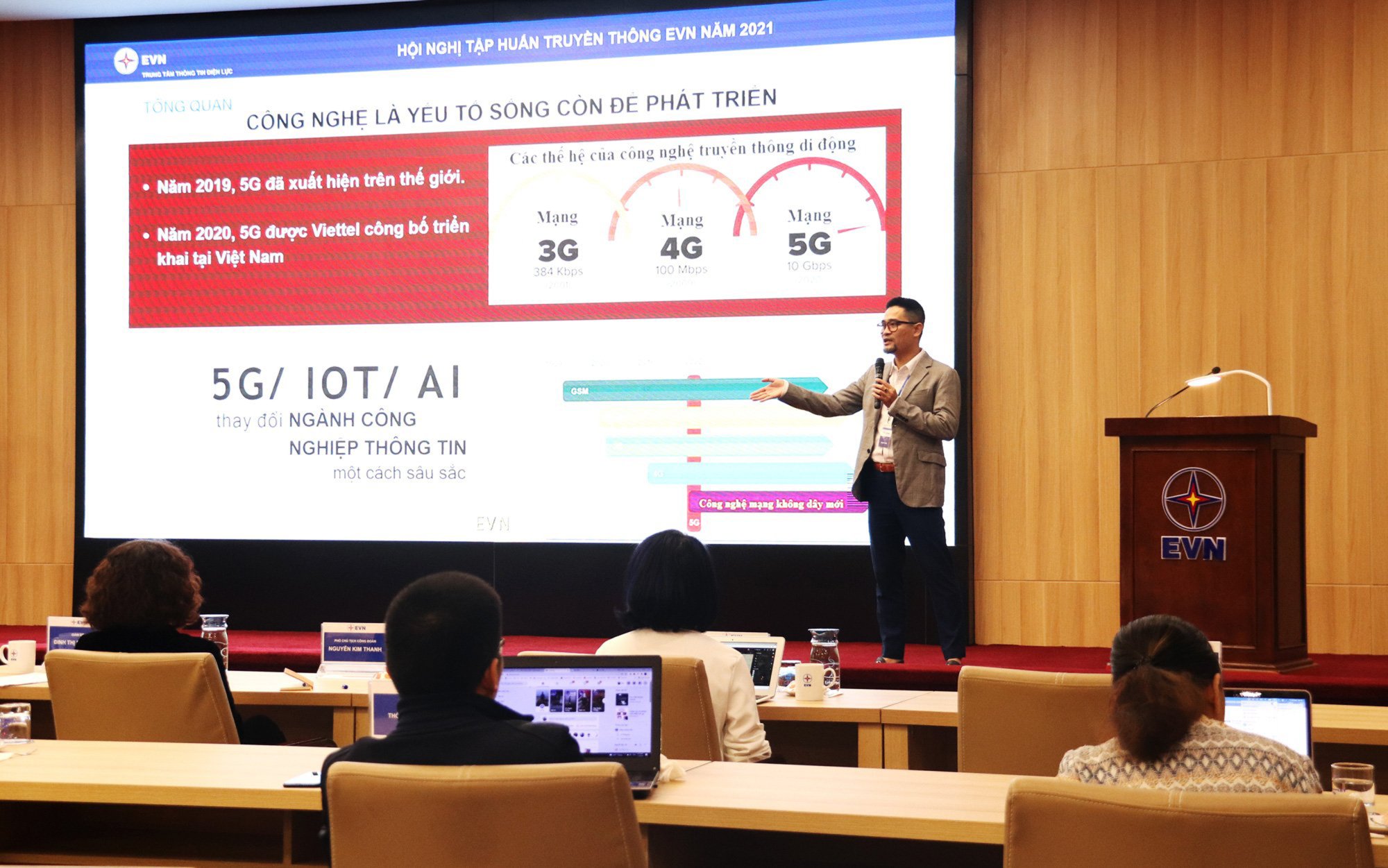

Dziennikarz Nguyen Cao Cuong, zastępca dyrektora Centrum Produkcyjnego Programu VTVcab, na sesji szkoleniowej dla mediów.

Jednak wszystkie strony nadal ostrożnie podchodzą do wykorzystywania produktów sztucznej inteligencji, a wiele krajów rozważa nawet wprowadzenie przepisów regulujących wykorzystanie sztucznej inteligencji w dziennikarstwie, aby zapewnić sobie jasny korytarz prawny. Chociaż jest to bardzo dobre i użyteczne narzędzie dla osób pracujących w prasie, sposób jego zastosowania wymaga poważnego rozważenia, zwłaszcza w dziennikarstwie. Samo dziennikarstwo ma w sobie element poszanowania obiektywnej prawdy. Tymczasem korzystamy z produktów sztucznej inteligencji, które są jedynie produktami tworzonymi przez maszyny, syntezą, a zatem mają jedynie charakter ilustracyjny.

+ Szanse zawsze wiążą się z ryzykiem. Im bardziej zaawansowane jest zastosowanie sztucznej inteligencji, tym większe ryzyko stwarza. Co sądzisz o tym stwierdzeniu?

Wraz z rozwojem technologii istnieje ryzyko, że sztuczna inteligencja będzie tworzyć wiele fałszywych obiektów, które będą wyglądać jak prawdziwi ludzie. Ludzkie wizerunki w internecie przedstawiają działania, które wyglądają jak prawdziwe osoby. To stwarza niepewność informacyjną, którą znaliśmy już w przeszłości, co jest sytuacją, gdy Deepfake fałszuje obrazy i głosy, aby popełniać oszustwa internetowe, co jest dość powszechne. Wady Deepfake i sztucznej inteligencji budzą nasze obawy, ponieważ stopniowo ludzie przestają wierzyć w obrazy tworzone przez sztuczną inteligencję.

Obecnie agencje prasowe i agencje rządowe nie mają żadnych regulacji dotyczących sztucznej inteligencji. Dlatego też, korzystając z tej technologii, redakcje powinny w większym lub mniejszym stopniu oznaczać produkty AI. Ma to również na celu ostrzeżenie opinii publicznej, że są to produkty sztucznej inteligencji, a nie stworzone przez ludzi. Jednocześnie podkreśla się, że są to obrazy ilustracyjne, a nie rzeczywiste, aby uniknąć nieporozumień.

Dziennikarz Nguyen Cao Cuong pomaga studentom w ćwiczeniu produkcji medialnej.

W dziennikarstwie, korzystając ze sztucznej inteligencji, trzeba zachować szczególną ostrożność i umiejętności.

+ Panie, w jaki sposób agencje prasowe mogą w niedalekiej przyszłości wykorzystać zalety sztucznej inteligencji?

- Agencje prasowe korzystają z ilustracji generowanych przez sztuczną inteligencję, które mogą być grafikami, reklamami, zdjęciami wprowadzającymi lub ilustracyjnymi, więc wymagania dotyczące absolutnej dokładności nie są zbyt wysokie, więc można je wykorzystać. Jednak w przypadku artykułu śledczego, reportażu lub po prostu artykułu informacyjnego, użycie obrazów generowanych przez sztuczną inteligencję jest zdecydowanie niedozwolone, ponieważ odbiorcy będą myleni między obrazami rzeczywistymi a obrazami tworzonymi przez sztuczną inteligencję.

Dlatego w dziennikarstwie, stosując sztuczną inteligencję, musimy być bardzo ostrożni i umiejętni. Jeśli jest to produkt firmy medialnej, jednostki specjalizującej się w produkcji produktów medialnych w celu reklamowania produktów firmowych, ich sprzedaży, kierowania klientami, to zastosowanie sztucznej inteligencji jest całkowicie możliwe. Służy to jedynie szybkiemu tworzeniu atrakcyjnych, kreatywnych obrazów do ilustracji. W zależności od zadania, jakiemu służy praca w mediach, zostanie ona oznaczona lub nie. Moim zdaniem jest to jednak nowe zjawisko, które powinno zostać oznaczone.

Na przykład, narzędzie, które tworzy obraz wydarzenia sprzed dziesiątek lub setek lat, możemy wesprzeć sztuczną inteligencją. Jednak to, co to narzędzie wykreśli, zależy w dużej mierze od wiedzy dziennikarza – musi on rozumieć wydarzenie z danego roku, aby dostarczyć AI, a także tekst i polecenia do niej wysyłane. A jeśli dziennikarz użyje sztucznej inteligencji do odtworzenia obrazu ze sceną wojny z udziałem ludzi z dynastii Tran, ale nie będzie miał podstawowej wiedzy o tym, jacy byli żołnierze dynastii Tran? Jakie mieli stroje i broń? Łatwo będzie pomylić to z inną epoką.

Aplikacja Sora firmy OpenAI generuje filmy o długości do minuty, zawierające złożone sceny, ruchy kamery i wiele postaci o silnym ładunku emocjonalnym. Zrzut ekranu z klipu wygenerowanego przez aplikację Sora.

+ Jeśli jakaś praca dziennikarska została wyprodukowana przez sztuczną inteligencję lub w dużej mierze wygenerowana przez sztuczną inteligencję, jak oceniłbyś ją pod względem prawnym, gdyby miała zostać nagrodzona za wysokiej jakości dziennikarstwo lub zgłoszona do nagród dziennikarskich?

- Obecnie przepisy Ministerstwa Informacji i Komunikacji lub Wietnamskiego Stowarzyszenia Dziennikarzy dotyczące wykorzystania sztucznej inteligencji w pracach dziennikarskich nie zawierają żadnych konkretnych instrukcji ani regulacji. Jednak agencje prasowe, które wykorzystują sztuczną inteligencję w jakiejkolwiek części lub sekcji, powinny to wyraźnie oznaczyć. Uważam, że niezależnie od tego, czy praca zostanie zgłoszona do konkursu, czy nie, o ile zostanie udostępniona publicznie, dziennikarze muszą zachować szczególną ostrożność, zwłaszcza mając rozległą i kompleksową wiedzę, aby wyraźnie to rozróżnić. Wprowadzaj informacje dokładnie, aby podczas tworzenia produktu przez sztuczną inteligencję było mniej nieporozumień. Po otrzymaniu produktu od sztucznej inteligencji jesteśmy zmuszeni do ponownego jego sprawdzenia. W tym czasie dziennikarze muszą mieć nastawienie redaktora, aby sprawdzić, czy jest on standardowy, czy nie. W początkach sztucznej inteligencji, gdy dane wejściowe są nadal skąpe i brakuje ich, prawdopodobieństwo pomyłki jest bardzo wysokie, musimy zwracać na to większą uwagę.

Firma OpenAI właśnie zaprezentowała Sora, aplikację AI, która potrafi generować realistyczne filmy na podstawie poleceń tekstowych.

+ Czy Twoim zdaniem agencje prasowe powinny zwiększyć liczbę szkoleń i rozwoju dla reporterów i dziennikarzy, aby mogli oni w pełni wykorzystać potencjał sztucznej inteligencji, zwłaszcza jej nowych funkcji?

– Oczywiście. W przypadku treści wideo, filmów wertykalnych, produkcji audio i tekstowych, zdjęć… my, dziennikarze, zawsze chcemy przyciągać czytelników i odbiorców, dlatego musimy aktualizować swoją wiedzę. Najważniejsze jest to, jak korzystać z narzędzi, jak dobre jest nasze myślenie o edycji, redakcji i weryfikacji. Czy wiedza dziennikarzy w danej dziedzinie jest wystarczająca? Krótko mówiąc, każdy reporter, dziennikarz i redaktor musi zwrócić uwagę na: Im łatwiejszy dostęp do narzędzi AI, tym większe prawdopodobieństwo popełnienia błędów.

W pracy dziennikarskiej lub telewizyjnej można użyć ich dowolnej liczby, o ile treść i obrazy tworzą logikę, autentyczność i precyzję w odniesieniu do wydarzenia w kontekście danego czasu – to jest ważne. Jeśli produkt dziennikarski stworzony przez sztuczną inteligencję jest dobrze kontrolowany, autentyczny i odpowiedni, myślę, że nie będzie problemu. W przypadku zdjęć, obrazów i filmów będących rekonstrukcjami historycznymi możemy je wykorzystać, ale możemy je oznaczyć, aby publiczność znała kontekst, okres, czas i treść, w których zrekonstruowane obrazy zostały stworzone przez sztuczną inteligencję…

+ Czy ze względu na kwestie prawne i bezpieczeństwa agencje prasowe powinny korzystać z produktów opartych na sztucznej inteligencji, aby tworzyć materiały prasowe przeznaczone wyłącznie do publikowania w mediach społecznościowych?

– Jeśli stworzenie produktu AI tylko po to, by udostępnić go w mediach społecznościowych, wymaga zbyt dużego wysiłku, to myślę, że powinniśmy to przemyśleć. Jeśli wymaga to zbyt dużego wysiłku, produkty powinny znaleźć się na stronie agencji prasowej. Platformy takie jak Facebook, TikTok, YouTube… to wciąż platformy zewnętrzne, możemy również generować przychody z takich kanałów, ale jasne jest, że długoterminowa strategia musi nadal polegać na rozwijaniu kanału, którym zarządzamy. Dlatego najbardziej wartościowe i pracochłonne treści powinny znajdować się na oficjalnym kanale właściciela.

+ Dziękuję bardzo!

Le Tam (wykonane)

Źródło

![[Zdjęcie] Wycinanie wzgórz, aby umożliwić ludziom poruszanie się drogą 14E, która ucierpiała wskutek osuwisk](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/08/1762599969318_ndo_br_thiet-ke-chua-co-ten-2025-11-08t154639923-png.webp)

![[Wideo] Pomniki w Hue ponownie otwarte dla zwiedzających](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/05/1762301089171_dung01-05-43-09still013-jpg.webp)

Komentarz (0)