Biuro Prokuratora Generalnego New Hampshire ogłosiło w poniedziałek, że wszczyna dochodzenie w sprawie możliwych manipulacji wyborczych po skargach na fałszywy głos, który brzmiał dokładnie jak głos prezydenta USA Joe Bidena i wzywał wyborców, aby nie głosowali w stanowych prawyborach.

Naukowcy ostrzegają również przed wykorzystywaniem materiałów audio z technologią deepfake do podszywania się pod polityków i przywódców. Głośne przypadki tego typu działań miały miejsce w 2023 r. w Wielkiej Brytanii, Indiach, Nigerii, Sudanie, Etiopii i Słowacji.

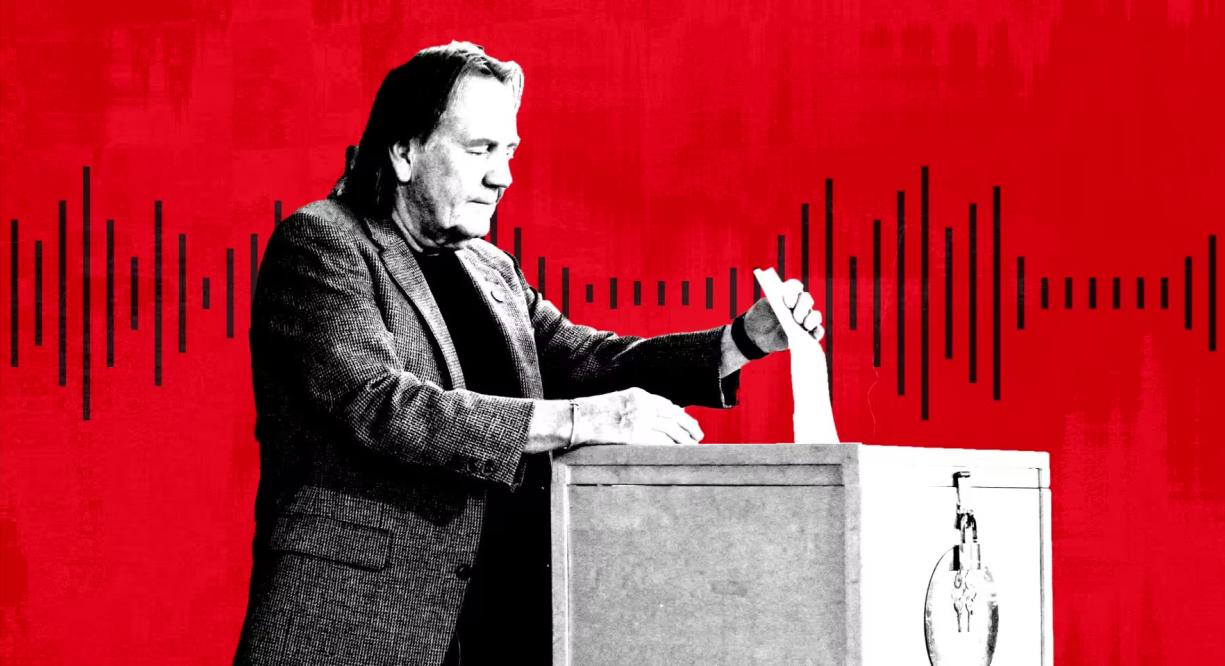

Osoba głosuje w prawyborach w New Hampshire, USA. Zdjęcie: Getty

Według ekspertów, deepfake audio stał się popularną formą dezinformacji ze względu na pojawienie się szeregu tanich i skutecznych narzędzi AI od startupów. Microsoft opracował również nowy model AI, który potrafi kopiować głosy z zaledwie trzech sekund nagrania.

„Jeśli chodzi o manipulację wizualną, wszyscy znają Photoshopa, a przynajmniej wiedzą, że istnieje” – powiedział Henry Ajder, ekspert ds. sztucznej inteligencji i deepfake’ów oraz konsultant w firmach Adobe, Meta i EY. „Bardzo mało osób wie, jak można manipulować dźwiękiem, więc moim zdaniem to naprawdę nas podatnych na ataki”.

We wrześniu NewsGuard, system oceniający jakość i wiarygodność serwisów informacyjnych, odkrył sieć kont TikToka podszywających się pod legalne serwisy informacyjne, wykorzystujących treści generowane przez sztuczną inteligencję do szerzenia teorii spiskowych i dezinformacji politycznej. Nagrania deepfake, w tym głos byłego prezydenta USA Baracka Obamy, zgromadziły setki milionów wyświetleń.

Jak podaje NewsGuard, fałszywe komentarze głosowe najprawdopodobniej zostały wygenerowane przez narzędzie dostarczone przez firmę ElevenLabs, wspieraną przez Andreessen Horowitz. Klipy obejrzało setki milionów osób.

„Ponad 99% użytkowników naszej platformy tworzy ciekawe, kreatywne i przydatne treści. Zdajemy sobie jednak sprawę, że zdarzają się przypadki nadużyć, dlatego nieustannie opracowujemy i wprowadzamy środki ochrony, aby je ograniczyć” – oświadczył ElevenLabs.

Firma ElevenLabs, założona dwa lata temu przez byłych pracowników Google i Palantir, Piotra Dąbkowskiego i Matiego Staniszewskiego, oferuje za darmo podstawowe narzędzia do generowania dźwięku oparte na sztucznej inteligencji (AI) za pomocą jednego kliknięcia. Plany subskrypcji wahają się od 1 do 330 dolarów miesięcznie, a nawet więcej, dla osób poszukujących bardziej złożonych usług.

W zeszłym roku amerykańskie agencje wywiadowcze ostrzegły w raporcie, że „liczba oszustw związanych z personalizowaną sztuczną inteligencją znacznie wzrosła ze względu na udostępnienie zaawansowanych i dobrze wyszkolonych modeli klonowania głosu za pomocą sztucznej inteligencji”.

Oprócz oszustw motywowanych finansowo, eksperci polityczni biją teraz na alarm w związku z viralowymi nagraniami audio typu deepfake, a także wykorzystywaniem deepfake'ów w automatycznych połączeniach telefonicznych lub kampaniach. „Można zbudować potężną, szeroko zakrojoną kampanię dezinformacyjną, atakując telefony” – powiedział AJ Nash, wiceprezes i wybitny ekspert ds. wywiadu w firmie zajmującej się cyberbezpieczeństwem ZeroFox.

Niektóre z tych firm aktywnie poszukiwały innych sposobów zwalczania dezinformacji. Microsoft wydał oświadczenie etyczne, wzywając użytkowników do zgłaszania wszelkich nadużyć w korzystaniu z jego narzędzia do analizy dźwięku za pomocą sztucznej inteligencji. Firma ElevenLabs opracowała własne narzędzia do wykrywania nagrań audio tworzonych przez jej system.

Jak podaje organizacja zajmująca się prawami człowieka Freedom House, podczas wyborów w Nigerii w 2023 r. w mediach społecznościowych pojawił się zmanipulowany przez sztuczną inteligencję klip, który rzekomo sugerował, że kandydat opozycji planuje sfałszować wybory.

Na Słowacji, zaledwie kilka dni przed wrześniowymi wyborami prezydenckimi, w internecie pojawiło się fałszywe nagranie audio kandydata opozycji Michala Šimečki, na którym najwyraźniej planował sfałszowanie wyborów.

„Deepfake z New Hampshire przypomina nam, jak wiele sposobów deepfake może wprowadzać w błąd i oszukiwać” – powiedział Robert Weissman, prezes organizacji non-profit Public Citizen, działającej na rzecz praw konsumentów. „Nadszedł moment politycznego deepfake’a. Decydenci muszą działać szybko, aby wprowadzić zabezpieczenia, w przeciwnym razie czeka nas chaos wyborczy”.

Mai Anh (według FT)

Źródło

![[Zdjęcie] Głębinowe złoża piasku, starożytny drewniany statek An Bang zagrożony ponownym zakopaniem](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/13/1763033175715_ndo_br_thuyen-1-jpg.webp)

![[Zdjęcie] Panorama z II Wietnamsko-Kambodżańskiej Wymiany Przyjaźni w Ochronie Granicy](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/13/1763033233033_image.jpeg)

![Przejście Dong Nai OCOP: [Artykuł 3] Powiązanie turystyki z konsumpcją produktów OCOP](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

Komentarz (0)