A Nvidia já foi conhecida como fabricante de chips usados na indústria de videogames, mas mudou seu foco para o mercado de data centers nos últimos anos.

A empresa americana de semicondutores prosperou rapidamente durante a pandemia, impulsionada pela alta demanda por jogos e aplicativos em nuvem, juntamente com a febre global da mineração de criptomoedas. Ao final do ano fiscal encerrado em 29 de janeiro, o segmento de chips para data centers representava mais de 50% da receita da empresa.

Entretanto, o chatbot ChatGPT, extremamente popular, elevou a geração de inteligência artificial (IA) a um novo patamar este ano. Essa tecnologia utiliza vastas quantidades de dados disponíveis para criar conteúdo inédito sobre diversos temas, da poesia à programação de computadores.

A Microsoft e a Alphabet, duas gigantes da tecnologia e importantes empresas no setor de IA, acreditam que a tecnologia generativa pode mudar a forma como as pessoas trabalham. Ambas lançaram uma corrida para integrar a IA em mecanismos de busca e softwares de escritório, com a ambição de dominar o setor.

O Goldman Sachs estima que o investimento dos EUA em IA poderá representar aproximadamente 1% da produção econômica do país até 2030.

Os supercomputadores usados para processamento de dados e geração de IA dependem de unidades de processamento gráfico (GPUs). As GPUs são projetadas para lidar com as tarefas computacionais específicas envolvidas na IA e são significativamente mais eficientes do que as unidades centrais de processamento (CPUs) de outros fabricantes de chips, como a Intel. Por exemplo, o ChatGPT da OpenAI é alimentado por milhares de GPUs da Nvidia.

Enquanto isso, a Nvidia detém aproximadamente 80% do mercado de GPUs. Seus principais concorrentes incluem a Advanced Micro Devices e os chips de IA internos de empresas de tecnologia como Amazon, Google e Meta Platforms.

Segredos para alcançar a transcendência

O grande salto dessa empresa se deveu ao H100, um chip baseado na nova arquitetura "Hopper" da Nvidia – nomeada em homenagem à ícone da programação americana Grace Hopper. O boom da IA transformou o H100 no produto mais cobiçado do Vale do Silício.

Esses chips gigantescos, usados em data centers, possuem 80 bilhões de transistores, cinco vezes o número de chips de silício que equipam os iPhones mais recentes. Embora custe o dobro do seu antecessor, o A100 (lançado em 2020), os usuários do H100 afirmam que o chip oferece três vezes mais desempenho.

O H100 está se mostrando particularmente popular entre grandes empresas de tecnologia como Microsoft e Amazon, que estão construindo data centers inteiros focados em cargas de trabalho de IA, e startups de IA de próxima geração como OpenAI, Anthropic, Stability AI e Inflection AI, pois promete maior desempenho, o que pode acelerar o lançamento de produtos ou reduzir os custos de treinamento ao longo do tempo.

“Este é um dos recursos técnicos mais escassos no momento”, disse Brannin McBee, diretor de estratégia e fundador da CoreWeave, uma startup de nuvem com inteligência artificial e uma das primeiras empresas a receber um lote do H100 no início deste ano.

Outros clientes não tiveram a mesma sorte que a CoreWeave, tendo que esperar até seis meses para receber o produto necessário para treinar seus enormes conjuntos de dados. Muitas startups de IA temem que a Nvidia não consiga atender à demanda do mercado.

Elon Musk também encomendou milhares de chips da Nvidia para sua startup de IA, afirmando que "as GPUs estão mais difíceis de encontrar do que medicamentos atualmente".

“Os custos dos computadores dispararam. O valor mínimo necessário para o hardware de servidor usado na construção de IA inovadora chegou a US$ 250 milhões”, compartilhou o CEO da Tesla.

Embora a H100 tenha chegado no momento certo, o avanço da Nvidia em IA teve origem duas décadas antes, impulsionado pela inovação em software, e não em hardware. Em 2006, a empresa lançou o software CUDA, que utilizava GPUs para acelerar tarefas além da área gráfica.

“A Nvidia enxergou o futuro antes dos outros e direcionou seu foco para o desenvolvimento de GPUs programáveis. A empresa identificou a oportunidade, apostou alto e superou consistentemente seus concorrentes”, disse Nathan Benaich, sócio da Air Street Capital e investidor em startups de IA.

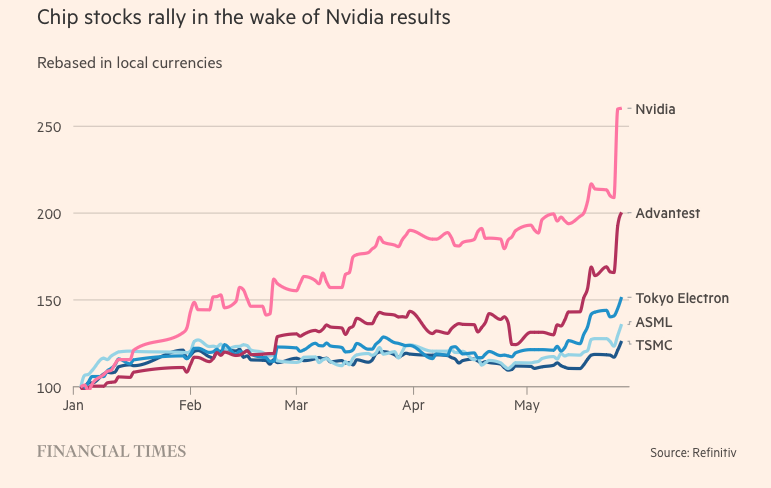

(Segundo a Reuters e o Financial Times)

Fonte

![[Foto] O primeiro-ministro Pham Minh Chinh conversa por telefone com o CEO da corporação russa Rosatom.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

Comentário (0)