A gigante da tecnologia está sob crescente pressão nos EUA e na Europa devido a alegações de que seus aplicativos são viciantes e causam problemas de saúde mental entre os jovens.

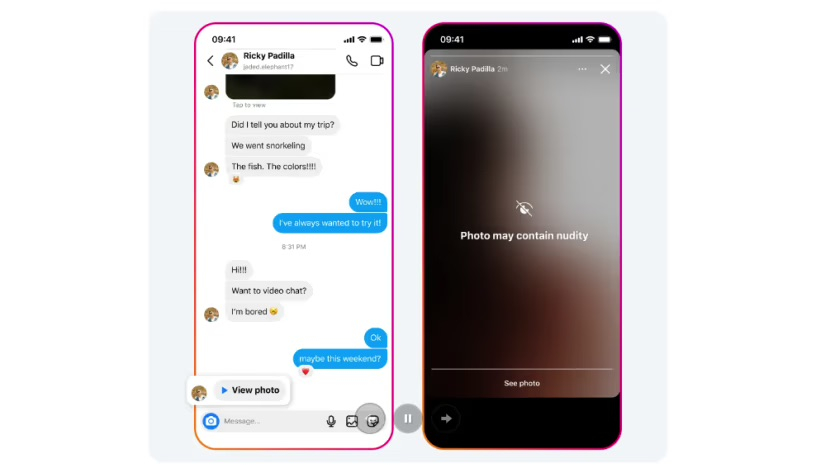

Quando alguém recebe uma mensagem do Instagram contendo uma foto nua, a imagem fica automaticamente desfocada abaixo da tela de aviso. Foto: Meta

O recurso de proteção de mensagens diretas do Instagram usará aprendizado de máquina no dispositivo para analisar se as imagens enviadas pelo serviço contêm nudez, disse a Meta.

Este recurso será habilitado por padrão para usuários menores de 18 anos, e o Meta notificará os adultos para incentivá-los a habilitá-lo.

“Como as imagens são analisadas no próprio dispositivo, a proteção contra nudez também funcionará em chats criptografados de ponta a ponta, onde o Meta não terá acesso a essas imagens — a menos que alguém decida denunciá-las para nós”, disse a empresa.

Ao contrário dos aplicativos Messenger e WhatsApp da Meta, as mensagens diretas do Instagram não são criptografadas, mas a empresa diz que planeja implementar criptografia no serviço de compartilhamento de fotos.

A Meta também disse que está desenvolvendo tecnologia para ajudar a identificar contas que podem estar envolvidas em golpes de sextorsão e está testando a ativação de novas notificações para usuários que podem ter interagido com essas contas.

Em janeiro, a Meta disse que ocultaria mais conteúdo de adolescentes no Facebook e no Instagram, acrescentando que isso tornaria mais difícil para os jovens acessarem conteúdo sensível, como suicídio, automutilação e transtornos alimentares.

Trinta e três estados americanos, incluindo Califórnia e Nova York, processaram a Meta em outubro de 2023, alegando que a empresa de tecnologia mentiu repetidamente ao público sobre os perigos de sua plataforma. A Comissão Europeia também ordenou que a Meta proteja crianças de conteúdo ilegal e prejudicial.

Mai Anh (de acordo com a CNA)

[anúncio_2]

Fonte

![[Foto] Cerimônia de encerramento do 18º Congresso do Comitê do Partido de Hanói](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/17/1760704850107_ndo_br_1-jpg.webp)

![[Foto] Jornal Nhan Dan lança “Pátria no Coração: O Filme Concerto”](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/16/1760622132545_thiet-ke-chua-co-ten-36-png.webp)

Comentário (0)