Produse ale IA: Rasism și prejudecăți

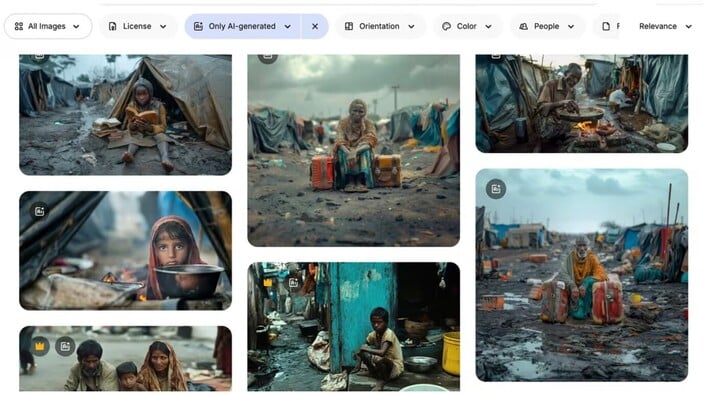

Imaginile generate de inteligența artificială cu subiecte precum sărăcia, copiii și victimele violenței sexuale inundă arhivele foto online, iar organizațiile non-guvernamentale (ONG-uri) le utilizează din ce în ce mai mult, potrivit experților în sănătate la nivel global. Experții avertizează că acest lucru ar putea semnala o „nouă eră a culturii exploatării sărăciei”.

„Aceste imagini reflectă viziunea implicită asupra sărăciei – copii care țin boluri goale, pământ crăpat... foarte stereotipe”, a spus Arsenii Alenichev, cercetător la Institutul de Medicină Tropicală din Anvers, care studiază producerea de imagini despre sănătatea globală .

Dl. Alenichev a colectat peste 100 de imagini generate de inteligența artificială ale sărăciei extreme, care au fost folosite de persoane fizice sau ONG-uri în campanii pe rețelele de socializare împotriva foametei și a violenței sexuale.

Imaginile pe care le-a distribuit publicației The Guardian prezintă scene exagerate, stereotipice: copii ghemuiți în bălți de noroi; o fată africană în rochie de mireasă, cu lacrimi șiroindu-i pe față. Într-un comentariu recent publicat în revista Lancet Global Health, el a susținut că imaginile reprezintă „pornografie despre sărăcie versiunea 2.0”.

Captură de ecran care prezintă o imagine generată de inteligență artificială a „sărăciei” pe un site web de fotografii. (Foto: Freepik)

Dl. Alenichev și mulți alți experți spun că utilizarea imaginilor bazate pe inteligență artificială este în creștere din cauza îngrijorărilor legate de drepturile de autor și costuri. Reducerile bugetare ale guvernului SUA pentru ONG-uri au agravat problema.

„Evident, multe organizații încep să ia în considerare utilizarea imaginilor bazate pe inteligență artificială în loc de fotografii reale, deoarece este ieftin. De asemenea, nu trebuie să vă faceți griji cu privire la drepturile de autor și la multe alte lucruri”, a spus el.

Responsabilitatea este a utilizatorului sau a platformei?

Imaginile generate de inteligența artificială cu privire la sărăcie apar pe zeci de site-uri de fotografii, inclusiv Adobe Stock Photos și Freepik. Multe au subtitrări precum: „copil suprarealist într-o tabără de refugiați”; „copii asiatici înotând într-un râu plin de gunoaie”; „voluntar alb care oferă sfaturi medicale copiilor de culoare dintr-un sat african”; și multe altele. Adobe vinde drepturile asupra ultimelor două imagini de pe această listă pentru aproximativ 60 de lire sterline.

„Aceste fotografii sunt în mod flagrant rasiste și nu ar trebui să li se permită publicarea, deoarece reprezintă cele mai grave stereotipuri despre Africa, India sau orice altceva la care vă puteți gândi”, a spus Alenichev.

Joaquín Abela, CEO al Freepik, a declarat că responsabilitatea pentru utilizarea unor astfel de imagini extreme aparține utilizatorilor, nu platformelor precum a sa. În opinia sa, fotografiile de stoc realizate cu inteligență artificială sunt create de o comunitate globală de utilizatori, care pot primi drepturi de autor atunci când clienții Freepik aleg să le cumpere fotografiile.

Freepik a încercat să combată prejudecățile din bibliotecile sale foto prin „injectarea diversității”. În același timp, încearcă să asigure echilibrul de gen în fotografiile avocaților și directorilor.

Dar, spune el, platforma sa poate face doar atât. „E ca și cum ai încerca să usuci oceanul. Am încercat, dar realitatea este că, dacă clienții din întreaga lume vor ca imaginile lor să arate într-un anumit fel, nu există absolut nimic ce poate face nimeni în privința asta.”

Imagine generată de inteligența artificială din campania organizației caritabile Plan International din 2023, care își propune să protejeze „intimitatea și demnitatea fetelor”. (Foto: Plan International)

Multe organizații prestigioase au folosit imagini generate de inteligența artificială, chiar și Națiunile Unite.

Anul trecut, Națiunile Unite au postat pe YouTube un videoclip care conținea „reconstituiri” ale unor acte de violență sexuală, inclusiv mărturia unei femei burundeze care descrie cum a fost violată și lăsată să moară de trei bărbați în 1993. Conținutul a fost generat în întregime de inteligența artificială. Videoclipul a fost eliminat după ce The Guardian a contactat ONU pentru un interviu.

Un purtător de cuvânt al ONU a explicat ulterior de ce videoclipul a fost eliminat. „Credem că videoclipul a fost generat în mod necorespunzător de inteligența artificială și poate prezenta riscuri pentru integritatea informațiilor, combinând imagini reale cu conținut artificial care pare a fi real.”

Produsele generate de inteligența artificială au fost mult timp considerate a fi imitații, uneori exagerând adevărul. Dl. Alenichev a spus că proliferarea acestor imagini părtinitoare ar putea agrava problema, deoarece imaginile pot fi răspândite pe vastul internet și folosite pentru a antrena următoarea generație de inteligență artificială.

Un purtător de cuvânt al Plan International a declarat că ONG-ul „recomandă în prezent împotriva utilizării inteligenței artificiale pentru a reprezenta copiii”.

Minh Hoan

Sursă: https://vtcnews.vn/chuyen-gia-bao-dong-tinh-trang-ai-tao-anh-rap-khuon-phong-dai-ar972160.html

Comentariu (0)