На прошлой неделе в Пекине собралась группа видных международных экспертов, которые определили «красные линии» в развитии ИИ, включая создание биологического оружия и проведение кибератак.

В заявлении, опубликованном через несколько дней после встречи, ученые предупредили, что необходим единый подход к безопасности ИИ, чтобы предотвратить «катастрофические или даже экзистенциальные риски для человечества в течение нашей жизни».

«В разгар холодной войны международное правительственное и научное сотрудничество помогло предотвратить ядерную катастрофу. Человечество должно вновь объединить усилия, чтобы предотвратить катастрофу, которая может возникнуть из-за беспрецедентных технологий», — говорится в заявлении.

Эксперты Международного диалога по безопасности ИИ в Пекине обозначили «красные линии» в развитии ИИ. Фото: FT

Среди подписавших письмо — Джеффри Хинтон и Йошуа Бенджио, которых часто называют «отцами» искусственного интеллекта; Стюарт Рассел, профессор компьютерных наук Калифорнийского университета; и Эндрю Яо, один из самых выдающихся китайских ученых-компьютерщиков.

Заявление было сделано после состоявшегося на прошлой неделе в Пекине Международного диалога по безопасности ИИ, на встрече с участием официальных лиц правительства Китая, которые выразили свое одобрение форуму и его результатам.

Президент США Джо Байден и председатель КНР Си Цзиньпин встретились в ноябре прошлого года и обсудили безопасность ИИ, договорившись начать диалог по этому вопросу. Ведущие мировые компании в сфере ИИ также в последние месяцы проводили частные встречи с китайскими экспертами в этой области.

В ноябре 2023 года 28 стран, включая Китай, и ведущие компании в области ИИ договорились о широком обязательстве по совместной работе над устранением экзистенциальных рисков, возникающих из-за передового ИИ, в ходе саммита по безопасности ИИ, проведенного канцлером Великобритании Риши Сунаком.

На прошлой неделе в Пекине эксперты обсудили угрозы, связанные с развитием «общего искусственного интеллекта» (ОИИ), или систем ИИ, которые равны человеку или превосходят его.

«Главным предметом обсуждения стали красные линии, которые не должна пересекать ни одна мощная система ИИ и которые правительствам всего мира следует устанавливать при разработке и внедрении ИИ», — сказал Бенжио.

Эти красные линии гарантируют, что «ни одна система ИИ не сможет воспроизводить или совершенствовать себя без явного согласия и поддержки человека» или «предпринимать действия, которые неоправданно увеличивают ее мощь и влияние».

Ученые добавили, что ни одна система не «существенно расширит возможности субъектов по разработке оружия массового уничтожения, нарушению Конвенции о биологическом или химическом оружии» или не сможет «автоматически осуществлять кибератаки, которые приведут к серьезным финансовым потерям или эквивалентному вреду».

Хоанг Хай (по данным FT)

Источник

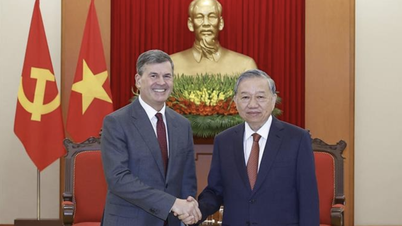

![[Фото] Генеральный секретарь То Лам принимает директора Академии государственной службы и народного хозяйства при Президенте Российской Федерации](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F08%2F1765200203892_a1-bnd-0933-4198-jpg.webp&w=3840&q=75)

Комментарий (0)