Google Lens är en bildsökmotor utvecklad av Google - Foto: KLMOBILE

Enligt Full Fact rör ovanstående fall videor som påstås handla om kriget i Ukraina och Gaza, konflikten mellan Indien och Pakistan, Air Indias flygplanskrasch i juni 2025 och invandrare som kommer till Storbritannien med små båtar.

Full Fact använde Google Lens för att söka efter skärmdumpar från falska videor som de hade faktagranskat.

I minst 10 fall misslyckades AI-sammanfattningarna med att känna igen det falska innehållet, och upprepade till och med samma felaktiga information som på sociala medier.

I fyra exempel upprepar AI-översikten ordagrant falska påståenden som Full Fact har motbevisat. Dessutom kan AI-sammanfattningsresultaten ändras varje gång den söker, även efter samma bild, vilket leder till inkonsekvent information.

Google medger att vissa av dessa fel kan uppstå och säger att de kommer från bildsökningsresultat, inte från AI-översiktssystemet.

Enligt Google kan bildsökningsresultat inkludera webbkällor eller inlägg på sociala medier som innehåller både matchande bilder och falsk information, och det påverkar AI-sammanfattningar.

Google säger att de alltid strävar efter att visa relevant och högkvalitativ information, ständigt förbättrar sig och när problem upptäcks kommer de att hanteras enligt policyn.

Även om Google hävdar att AI-översikt sällan "fabricerar" information (även känt som AI-"hallucinationer"), sprider de fortfarande felinformation om viktiga och känsliga frågor.

Till exempel påstod en viral video falskeligen att asylsökande anlände till Dover Beach i Storbritannien, när händelsen i själva verket utspelade sig på en strand i Goa i Indien. Google Lens, när de sökte efter skärmdumpar från videon, sammanfattade den som "människor som samlas på Dover Beach i Storbritannien".

Eller vissa falska videor om kriget i Ryssland-Ukraina, till och med bilder från videospelet Arma 3, beskrivs som verkliga av AI-översikten utan förvarning om att det är falskt innehåll.

Det finns ett fall där samma videospel men två olika bilder sammanfattas av AI som en scen där C-RAM-försvarssystemet avlyssnar artillerigranater och en scen där en SpaceX-raketuppskjutning sker, vilket inte betyder att dessa är falska bilder.

Google Lens AI-syntes gav falsk information när den påstod att det var en bild på flyktingar som anlände till staden Dover, England - Foto: FULL FACT

Google Lens är en bildsökmotor som låter användare söka efter foton eller ramar från videor för att jämföra med liknande bilder online.

Ibland visas en AI-sammanfattning högst upp på sidan, som samlar relevant information från webben. Trots varningen att "AI kan göra misstag" kan det lätt vilseleda allmänheten om felinformation visas tydligt.

Full Fact rekommenderar att Google Lens AI-översiktsverktyg ses som en utgångspunkt, inte en ersättning för manuell faktakontroll, och att ytterligare tillförlitliga källor söks för jämförelse.

Det här är inte första gången Googles sökresultat har visat felaktig information. Full Fact säger att de har fått finansiering från Google och Google.org men behåller fullständig redaktionell oberoende.

Källa: https://tuoitre.vn/google-lens-hien-thi-thong-tin-sai-lech-ve-hinh-anh-20250814110509932.htm

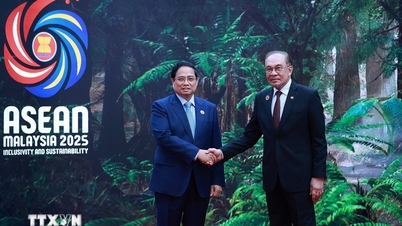

![[Foto] Premiärminister Pham Minh Chinh deltar i öppnandet av det 47:e ASEAN-toppmötet](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/26/1761452925332_c2a-jpg.webp)

![[Foto] Nationalförsamlingens ordförande Tran Thanh Man tar emot FN:s generalsekreterare António Guterres](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/25/1761390815792_ctqh-jpg.webp)

![[Foto] Premiärminister Pham Minh Chinh och FN:s generalsekreterare António Guterres deltar i presskonferensen vid undertecknandet av Hanoi-konventionen.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/25/1761391413866_conguoctt-jpg.webp)

![[Foto] Premiärminister Pham Minh Chinh tar emot FN:s generalsekreterare António Guterres](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/25/1761390212729_dsc-1484-jpg.webp)

Kommentar (0)