Det är en stor språkmodell (LLM) utvecklad av kinesiska forskare som kan befalla militära drönare att attackera fiendens radarsystem.

|

Forskare inom Kinas försvarsindustri har utvecklat en typ av AI som kan förbättra prestandan hos drönare för elektronisk krigföring, enligt SCMP.

Denna stora språkmodell (LLM), liknande ChatGPT, skulle kunna befalla drönare utrustade med elektroniska krigföringsvapen att attackera fiendens flygplansradar eller kommunikationssystem.

Testresultat visar att dess beslutsfattande prestanda i luftstrid inte bara överträffar traditionella artificiell intelligens (AI)-tekniker som förstärkningsinlärning, utan också överträffar erfarna experter.

Detta är den första allmänt publicerade studien som direkt tillämpar stora språkmodeller på vapen.

Tidigare var denna AI-teknik i stort sett begränsad till krigsrum, där den tillhandahöll underrättelseanalys eller beslutsstöd till mänskliga befälhavare.

Forskningsprojektet genomfördes gemensamt av Chengdu Aircraft Design Institute of Aviation Industry Corporation of China och Northwestern Polytechnical University i Xi'an, Shaanxi-provinsen.

Institutet är konstruktören av Kinas tunga stealth-stridsflygplan J-20.

Arbetet, som fortfarande är i sin experimentella fas, är det bästa på att förstå mänskligt språk bland befintliga AI-tekniker, enligt en artikel som projektgruppen publicerade den 24 oktober i den vetenskapligt granskade tidskriften Detection & Control.

Projektgruppen försåg LLM med en mängd olika resurser, inklusive "en serie böcker om radar, elektronisk krigföring och relaterade dokumentsamlingar."

Andra dokument, inklusive luftstridsregister, register över upprättande av vapendepåer och manualer för elektronisk krigföring, införlivades också i modellen.

Enligt forskare är det mesta utbildningsmaterialet på kinesiska.

|

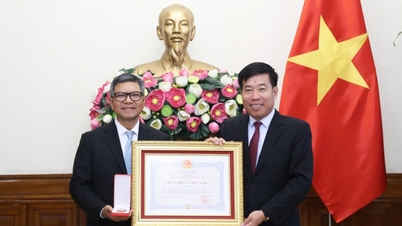

| Konstruktören av Kinas stealth-stridsflygplan J-20 är en del av ett forskarteam som är involverat i AI-projektet. Foto: Weibo |

I elektronisk krigföring släpper angriparen ut specifika elektromagnetiska vågor för att undertrycka radarsignalerna som avges av målet.

Omvänt kommer försvararen att försöka undvika dessa attacker genom att ständigt ändra signalen, vilket tvingar motståndaren att justera sin strategi i realtid baserat på övervakningsdata.

Tidigare trodde man att LLM:er inte var lämpliga för sådana uppgifter på grund av deras oförmåga att tolka data som samlats in från sensorer.

Artificiell intelligens kräver ofta också längre tanketider och lyckas inte uppnå reaktionshastigheter på millisekundnivå – avgörande i elektronisk krigföring.

För att undvika dessa utmaningar har forskare outsourcat bearbetningen av rådata till en mindre komplex modell för förstärkningsinlärning. Denna traditionella AI-algoritm utmärker sig på att förstå och analysera stora mängder numerisk data.

De "observationsvärdesvektorparametrar" som extraheras från denna preliminära process omvandlas sedan till mänskligt språk genom en maskinöversättare. Den stora språkmodellen tar sedan över, bearbetar och analyserar denna information.

Kompilatorn konverterar den stora modellens svar till utdatakommandon, som i slutändan styr den elektroniska krigföringsstöraren.

Enligt forskarna bekräftade de experimentella resultaten teknikens genomförbarhet. Med hjälp av förstärkningsinlärningsalgoritmer kan den generativa AI:n snabbt justera attackstrategier upp till 10 gånger per sekund.

Jämfört med traditionell AI och mänsklig expertis är LLM överlägsen på att skapa ett flertal falska mål på fiendens radarskärmar. Denna strategi anses vara mer värdefull inom området elektronisk krigföring än att bara blockera med brus eller avböja radarvågor bort från verkliga mål.

[annons_2]

Källa

![[Foto] Premiärminister Pham Minh Chinh leder det andra mötet i styrkommittén för privat ekonomisk utveckling.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/01/1762006716873_dsc-9145-jpg.webp)

Kommentar (0)