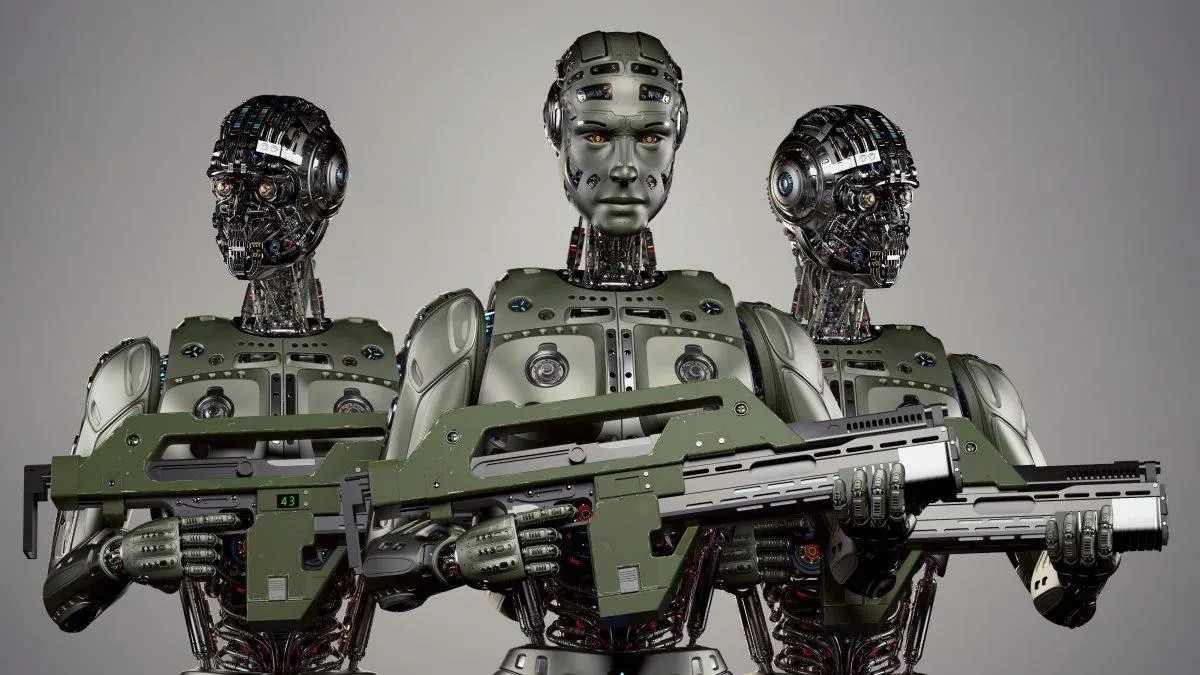

ภาพที่ซับซ้อนของการใช้หุ่นยนต์สังหาร AI

การอนุญาตให้ AI ควบคุมระบบอาวุธอาจหมายถึงการระบุเป้าหมาย โจมตี และทำลายเป้าหมายโดยปราศจากการแทรกแซงของมนุษย์ เรื่องนี้ก่อให้เกิดคำถามสำคัญทางกฎหมายและจริยธรรม

เพื่อเน้นย้ำถึงความร้ายแรงของสถานการณ์ รัฐมนตรี ต่างประเทศ ออสเตรีย นายอเล็กซานเดอร์ ชัลเลนเบิร์ก กล่าวว่า “นี่คือช่วงเวลาออพเพนไฮเมอร์แห่งยุคสมัยของเรา”

หุ่นยนต์และอาวุธที่ใช้ปัญญาประดิษฐ์เริ่มถูกนำมาใช้อย่างแพร่หลายในกองทัพของหลายประเทศ ภาพ: Forbes

อันที่จริงแล้ว ขอบเขตที่ “ยักษ์จินนีหนีออกจากขวดได้” กลายเป็นคำถามเร่งด่วน เนื่องจากโดรนและปัญญาประดิษฐ์ (AI) ถูกนำมาใช้กันอย่างแพร่หลายในกองทัพทั่ว โลก

“การใช้โดรนในความขัดแย้งยุคใหม่ของรัสเซียและยูเครน การใช้โดรนของสหรัฐฯ ในปฏิบัติการโจมตีแบบกำหนดเป้าหมายในอัฟกานิสถานและปากีสถาน และตามที่เปิดเผยเมื่อเดือนที่แล้ว ซึ่งเป็นส่วนหนึ่งของโครงการ Lavender ของอิสราเอล แสดงให้เห็นว่าความสามารถในการประมวลผลข้อมูลของ AI ถูกนำมาใช้โดยกองทัพทั่วโลกอย่างจริงจังเพื่อเสริมสร้างอำนาจการรุก” วิลสัน โจนส์ นักวิเคราะห์ด้านกลาโหมของ GlobalData กล่าว

การสืบสวนโดยสำนักงานข่าวสืบสวนสงคราม (Office of War Investigative Journalism) ซึ่งตั้งอยู่ในลอนดอน พบว่าระบบปัญญาประดิษฐ์ลาเวนเดอร์ (Lavender AI) ของกองทัพอิสราเอลมีความแม่นยำถึง 90% ในการระบุตัวบุคคลที่มีความเชื่อมโยงกับกลุ่มฮามาส ซึ่งหมายความว่ามี 10% ที่ไม่เกี่ยวข้อง ส่งผลให้มีพลเรือนเสียชีวิตเนื่องจากความสามารถในการระบุตัวตนและการตัดสินใจของปัญญาประดิษฐ์

ภัยคุกคามต่อความมั่นคงของโลก

การใช้ AI ในลักษณะนี้เน้นย้ำถึงความจำเป็นในการจัดการเทคโนโลยีในระบบอาวุธ

“การใช้ AI ในระบบอาวุธ โดยเฉพาะอย่างยิ่งเมื่อใช้เพื่อการกำหนดเป้าหมาย ก่อให้เกิดคำถามพื้นฐานเกี่ยวกับเรา – มนุษย์ – และความสัมพันธ์ของเรากับ สงคราม และโดยเฉพาะอย่างยิ่งสมมติฐานของเราเกี่ยวกับวิธีที่เราอาจใช้ความรุนแรงในความขัดแย้งทางอาวุธ” ดร. อเล็กซานเดอร์ บลานชาร์ด นักวิจัยอาวุโสในโครงการการกำกับดูแลปัญญาประดิษฐ์ที่สถาบันวิจัยสันติภาพนานาชาติสตอกโฮล์ม (SIPRI) ซึ่งเป็นกลุ่มวิจัยอิสระที่มุ่งเน้นด้านความมั่นคงระดับโลก อธิบายให้ Army Technology ฟัง

ระบบ AI เมื่อใช้ในสภาพแวดล้อมที่วุ่นวาย อาจทำงานแบบคาดเดาไม่ได้และอาจระบุเป้าหมายได้อย่างแม่นยำ ภาพ: MES

“ปัญญาประดิษฐ์ (AI) เปลี่ยนแปลงวิธีที่กองทัพเลือกเป้าหมายและใช้กำลังกับเป้าหมายเหล่านั้นหรือไม่? การเปลี่ยนแปลงเหล่านี้ก่อให้เกิดคำถามมากมายทั้งทางกฎหมาย จริยธรรม และการปฏิบัติการ ข้อกังวลที่สำคัญที่สุดคือด้านมนุษยธรรม” ดร. บลานชาร์ด กล่าวเสริม

“หลายคนกังวลว่าระบบอัตโนมัติเหล่านี้อาจทำให้พลเรือนและบุคคลอื่น ๆ ที่ได้รับความคุ้มครองตามกฎหมายระหว่างประเทศมีความเสี่ยงที่จะได้รับอันตรายมากขึ้น ขึ้นอยู่กับการออกแบบและการใช้งาน” ผู้เชี่ยวชาญของ SIPRI อธิบาย “นี่เป็นเพราะระบบ AI โดยเฉพาะอย่างยิ่งเมื่อใช้งานในสภาพแวดล้อมที่วุ่นวาย อาจทำงานแบบคาดเดาไม่ได้ และอาจไม่สามารถระบุเป้าหมายและโจมตีพลเรือนได้อย่างแม่นยำ หรือไม่สามารถระบุตัวผู้สู้รบที่ไม่ได้เข้าร่วมการสู้รบได้”

วิลสัน โจนส์ นักวิเคราะห์ด้านการป้องกันประเทศของ GlobalData อธิบายเพิ่มเติมเกี่ยวกับประเด็นนี้ว่า ประเด็นเกี่ยวกับวิธีการพิจารณาความผิดอาจเป็นเรื่องที่น่าสงสัย

“ภายใต้กฎหมายสงครามปัจจุบัน มีแนวคิดเรื่องความรับผิดชอบในการบังคับบัญชา” นายโจนส์กล่าว “นั่นหมายความว่า นายทหาร นายพล หรือผู้นำคนอื่นๆ จะต้องรับผิดชอบตามกฎหมายต่อการกระทำของกองกำลังภายใต้การบังคับบัญชา หากกองกำลังก่ออาชญากรรมสงคราม นายทหารผู้นั้นต้องรับผิดชอบแม้ว่าจะไม่ได้เป็นผู้ออกคำสั่งก็ตาม ภาระการพิสูจน์ตกอยู่ที่พวกเขาที่จะต้องพิสูจน์ว่าได้ทำทุกอย่างที่เป็นไปได้เพื่อป้องกันอาชญากรรมสงครามแล้ว”

“ระบบ AI ทำให้เรื่องซับซ้อนขึ้น ช่างเทคนิคไอทีรับผิดชอบหรือไม่? นักออกแบบระบบรับผิดชอบหรือไม่? ยังไม่ชัดเจน หากไม่ชัดเจน การกระทำของพวกเขาอาจก่อให้เกิดอันตรายทางศีลธรรมได้ หากผู้กระทำความผิดคิดว่าการกระทำของตนไม่ได้รับการคุ้มครองตามกฎหมายที่มีอยู่” คุณโจนส์เน้นย้ำ

ทหารสหรัฐฯ กำลังลาดตระเวนด้วยสุนัขหุ่นยนต์ ภาพ: Forbes

อนุสัญญาควบคุมอาวุธ ข้อตกลงระหว่างประเทศที่สำคัญหลายฉบับจำกัดและควบคุมการใช้อาวุธบางประเภท ได้แก่ การห้ามใช้อาวุธเคมี สนธิสัญญาไม่แพร่ขยายอาวุธนิวเคลียร์ และอนุสัญญาว่าด้วยอาวุธบางประเภท ซึ่งห้ามหรือจำกัดการใช้อาวุธบางชนิดที่ถือว่าก่อให้เกิดความทุกข์ทรมานที่ไม่จำเป็นหรือไม่สมเหตุสมผลแก่คู่สงคราม หรือส่งผลกระทบต่อพลเรือนอย่างไม่เลือกปฏิบัติ

“การควบคุมอาวุธนิวเคลียร์ต้องอาศัยความร่วมมือระหว่างประเทศและสนธิสัญญาที่ตามมาหลายทศวรรษกว่าจะบังคับใช้ได้” วิลสัน โจนส์ นักวิเคราะห์ด้านกลาโหมอธิบาย “ถึงกระนั้น เราก็ยังคงทดสอบบรรยากาศอย่างต่อเนื่องจนถึงช่วงทศวรรษ 1990 เหตุผลสำคัญประการหนึ่งที่ทำให้การไม่แพร่ขยายอาวุธนิวเคลียร์ประสบความสำเร็จคือความร่วมมือระหว่างสหรัฐอเมริกาและสหภาพโซเวียตในระเบียบโลกสองขั้ว ซึ่งไม่มีอยู่อีกต่อไปแล้ว และเทคโนโลยีที่สร้างปัญญาประดิษฐ์ (AI) นั้นเข้าถึงได้ง่ายกว่าพลังงานนิวเคลียร์ในหลายประเทศ”

สนธิสัญญาที่มีผลผูกพันจะต้องนำผู้ที่เกี่ยวข้องทั้งหมดมาเจรจาตกลงกันที่จะไม่ใช้เครื่องมือที่จะเพิ่มอำนาจทางทหาร ซึ่งไม่น่าจะได้ผล เพราะปัญญาประดิษฐ์สามารถเพิ่มประสิทธิภาพทางทหารได้โดยมีต้นทุนทางการเงินและวัสดุน้อยที่สุด

แนวโน้มภูมิรัฐศาสตร์ในปัจจุบัน

แม้ว่าประเทศต่างๆ ในสหประชาชาติจะยอมรับถึงความจำเป็นในการใช้ AI ทางทหารอย่างมีความรับผิดชอบ แต่ก็ยังมีงานอีกมากที่ต้องทำ

“หากไม่มีกรอบการกำกับดูแลที่ชัดเจน ข้อเรียกร้องเหล่านี้ก็ยังคงเป็นเพียงความปรารถนา” ลอรา เปโตรเน นักวิเคราะห์หลักจากโกลบอลดาต้า กล่าวกับอาร์มี เทคโนโลยี “จึงไม่น่าแปลกใจที่บางประเทศต้องการรักษาอำนาจอธิปไตยของตนเองไว้เมื่อต้องตัดสินใจเรื่องการป้องกันประเทศและความมั่นคงแห่งชาติ โดยเฉพาะอย่างยิ่งในสภาพภูมิรัฐศาสตร์ปัจจุบัน”

นางเปโตรเนกล่าวเสริมว่า แม้ว่าพระราชบัญญัติ AI ของสหภาพยุโรปจะกำหนดข้อกำหนดบางประการสำหรับระบบ AI แต่ก็ไม่ได้ระบุถึงระบบ AI เพื่อวัตถุประสงค์ทางทหาร

“ดิฉันคิดว่าแม้จะมีข้อยกเว้นนี้ แต่พระราชบัญญัติ AI ก็เป็นความพยายามสำคัญในการสร้างกรอบการทำงานสำหรับการประยุกต์ใช้ AI ที่รอคอยกันมานาน ซึ่งอาจนำไปสู่ความสม่ำเสมอของมาตรฐานที่เกี่ยวข้องในระดับหนึ่งในอนาคต” เธอกล่าว “ความสม่ำเสมอนี้จะมีความสำคัญต่อ AI ในภาคการทหารด้วย”

เหงียน ข่านห์

ที่มา: https://www.congluan.vn/moi-nguy-robot-sat-thu-ai-dang-de-doa-an-ninh-toan-cau-post304170.html

![การเปลี่ยนผ่าน OCOP ของจังหวัดด่งนาย: [มาตรา 3] การเชื่อมโยงการท่องเที่ยวกับการบริโภคผลิตภัณฑ์ OCOP](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/11/10/1762739199309_1324-2740-7_n-162543_981.jpeg)

การแสดงความคิดเห็น (0)