Eine Britin, die an der Motoneuronenkrankheit (MND) leidet und deshalb nicht mehr sprechen kann, ist dank künstlicher Intelligenz (KI) und einer achtsekündigen Aufnahme aus einem alten Familienvideo wieder in der Lage, mit ihrer eigenen Stimme zu kommunizieren.

Sarah Ezekiel, eine Künstlerin aus Nordlondon, verlor ihre Sprechfähigkeit, nachdem bei ihr im Alter von 34 Jahren, während ihrer zweiten Schwangerschaft vor 25 Jahren, ALS diagnostiziert wurde.

Die Krankheit schädigt das Nervensystem, schwächt die Muskeln in Zunge, Mund und Rachen und führt bei manchen Patienten zum vollständigen Verlust der Sprechfähigkeit.

Jahrelang nutzte Ezekiel einen Computer und eine Sprachausgabetechnologie zur Kommunikation, doch die Stimme klang nicht wie ihre eigene. Ihre beiden Kinder, Aviva und Eric, wuchsen auf, ohne jemals die wahre Stimme ihrer Mutter kennengelernt zu haben.

In den letzten Jahren ist es Experten gelungen, mithilfe von Technologie die ursprüngliche Stimme einer Person nachzubilden. Dieses Verfahren erfordert jedoch lange, qualitativ hochwertige Aufnahmen, und die resultierende Stimme wird oft als „monoton“ empfunden.

Simon Poole, ein Vertreter des britischen medizinischen Medienunternehmens Smartbox, sagte, das Unternehmen habe Frau Ezekiel zunächst gebeten, eine 60-minütige Aufnahme zur Verfügung zu stellen.

Frau Ezekiel konnte jedoch nur einen sehr kurzen und qualitativ minderwertigen Ausschnitt finden, der aus einem Heimvideo aus den 1990er Jahren stammte. Der Ausschnitt war nur 8 Sekunden lang, hatte verzerrten Ton und Rauschen vom Fernseher.

Herr Poole wandte sich an eine Technologie von ElevenLabs, einem in New York ansässigen Unternehmen für KI-Sprachgenerierung, die realistische Stimmen mit sehr wenigen Daten erzeugen kann.

Herr Poole verwendete ein KI-Tool, um die Stimme aus der alten Aufnahme zu extrahieren, und nutzte dann ein weiteres Tool – das mit realen Sprachdaten trainiert wurde –, um das Endprodukt zu erstellen.

Das Ergebnis berührte Ezekiel zutiefst. Die rekonstruierte Stimme ähnelte ihrer eigenen sehr, mit ihrem unverwechselbaren Londoner Akzent und dem leichten Lispeln, das sie zuvor abgelehnt hatte.

Laut MND UK leiden bis zu acht von zehn Menschen mit dieser Erkrankung nach der Diagnose unter Sprachschwierigkeiten. Die derzeit verwendeten computergenerierten Stimmen werden jedoch häufig als rhythmus- und emotionslos beurteilt.

Herr Poole erklärte, der Fortschritt der KI-Technologie bestehe heute in der Fähigkeit, menschenähnliche und emotionale Stimmen zu erzeugen und so zuvor leblosen Computerstimmen „Leben einzuhauchen“. Er betonte, dass die Personalisierung der Stimme auch ein Weg sei, die persönliche Identität zu bewahren.

Menschen, die aufgrund von Erkrankungen wie ALS Gefahr laufen, ihre Sprechfähigkeit zu verlieren, werden heutzutage oft dazu ermutigt, ihre Stimme so früh wie möglich aufzuzeichnen, um ihre Identität zu bewahren und die zukünftige Kommunikation zu erleichtern.

Bevor Smartphones jedoch populär wurden, war es nicht einfach, ordentliche Aufnahmen zu machen.

Quelle: https://www.vietnamplus.vn/ai-tai-tao-giong-noi-cho-mot-phu-nu-anh-mat-kha-nang-noi-25-nam-post1057350.vnp

![[Foto] Wir brauchen dringend Hilfe, damit diese Menschen schnellstmöglich eine Unterkunft finden und ihr Leben stabilisieren können.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F09%2F1765248230297_c-jpg.webp&w=3840&q=75)

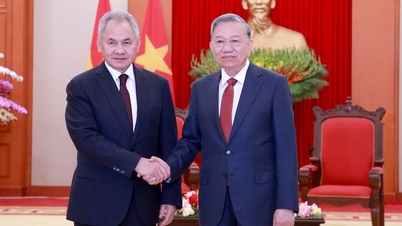

![[Foto] Generalsekretär To Lam arbeitet mit den Ständigen Ausschüssen der Unterausschüsse des 14. Parteitags zusammen.](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/09/1765265023554_image.jpeg)

Kommentar (0)