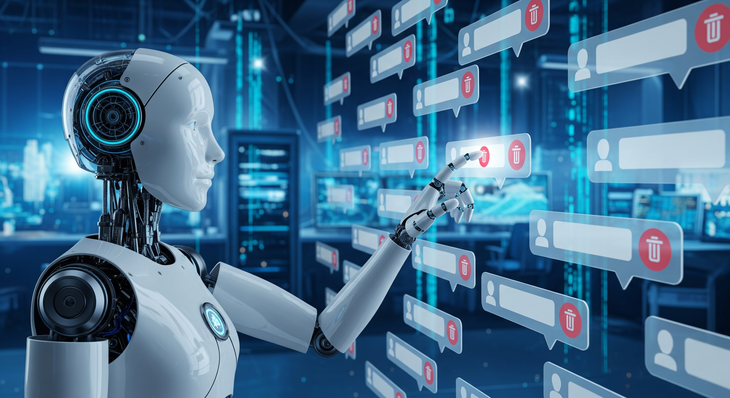

KI scannt und löscht Kommentare in sozialen Medien

Wenn Nutzer einen Kommentar zu einem YouTube- Video , einem Facebook-Beitrag oder einem Online-Artikel hinterlassen, wissen sie nicht, ob dieser überhaupt jemanden erreicht. Der Grund dafür liegt nicht in einem Rechtschreibfehler oder in einer illegalen Handlung, sondern wird einfach durch einen automatisierten Filteralgorithmus blockiert.

Tech-Plattformen setzen mittlerweile Kommentarfiltersysteme ein, um Hassreden, Pornografie, Gewalt und spaltende Äußerungen zu entfernen. Ziel ist es, die Community zu schützen. Doch sind diese Tools so hygienisch, dass sie unsensibel werden?

Wenn KI zum Wächter der Sprache wird

Anders als in den Anfängen des Internets, als „rohe“ Kommentare frei veröffentlicht werden durften, delegieren die meisten großen Plattformen die Verantwortung für die Inhaltsfilterung heute an künstliche Intelligenz. Dank maschinellem Lernen können Systeme täglich Millionen von Textzeilen scannen und dabei Sprache, Ton und sogar den „Kontext“ bewerten, um zu entscheiden, ob sie behalten oder löschen.

Dieses System ist jedoch nicht immer genau.

Frau Ngoc Vy (HCMC) teilte mit: „Mein Kommentar zu einem Produkt wurde aus unbekannten Gründen ausgeblendet. Keine Schimpfwörter, kein Spam, nur ein Kommentar, der nach ein paar Sekunden verschwand.“

Viele Inhalte werden einfach deshalb entfernt, weil sie sensible Wörter in einem ganz normalen Kontext verwenden. Ausdrücke wie „Armut“, „Hunger“, „Politik“ oder „System“ werden manchmal als negativ missverstanden, wenn die Maschine den Sinn des Satzes nicht „lesen“ kann.

Kritik filtern oder eliminieren?

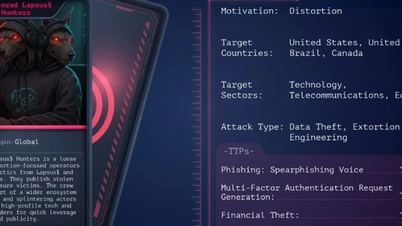

Einer Warnung der deutschen Organisation AlgorithmWatch zufolge können automatisierte Zensursysteme abweichende Meinungen, insbesondere von benachteiligten Gruppen oder Minderheitengruppen, unbeabsichtigt ausschalten, da diese Systeme vom Verhalten der Mehrheit lernen, die hinsichtlich Kultur und Ansichten nicht vielfältig genug ist.

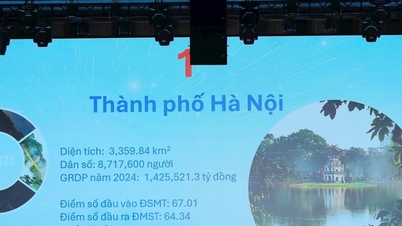

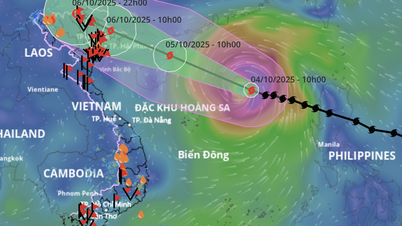

In Vietnam kommt es immer häufiger zu einer strengen Kontrolle der Inhalte sozialer Medien, insbesondere bei stark interaktiven Nachrichtenseiten. Kommentare zu aktuellen und gesellschaftlichen Themen dürfen oft nicht angezeigt werden oder müssen vorab freigegeben werden. Viele fragen sich daher: Gibt es im Cyberspace noch Meinungsfreiheit?

Beunruhigend ist, dass Nutzer selten erfahren, warum Kommentare ausgeblendet oder gelöscht werden. Es gibt keine Benachrichtigungen, keine transparenten Feedback-Mechanismen. Alles geschieht im Stillen, und in einer von Algorithmen gesteuerten Welt kann Schweigen die subtilste Form der Zensur sein.

Halten Sie das Internet sauber, aber beschönigen Sie die Konversation nicht

Ein sauberer Cyberspace sollte nicht steril sein. Die Gesellschaft ist ein Ort, an dem unterschiedliche Meinungen geäußert, konstruktiv, kritisch und diskutiert werden. Wir brauchen Algorithmen, um schädliche Äußerungen herauszufiltern, aber wir müssen auch das Recht schützen, anderer Meinung zu sein, Fragen zu stellen und Unannehmlichkeiten anzusprechen.

Wenn jeder Kommentar „moderiert“ werden muss, müssen wir uns fragen: Schützt die Technologie die Community oder filtert sie, was die Community hören darf?

Technologie kann den Menschen bei wertvollen Entscheidungen nicht ersetzen. Und im Zeitalter der KI sind Transparenz und das Recht auf Feedback die fairsten „Algorithmen“ für das gesamte System.

Die Technologie sollte den Menschen dabei helfen, ihre Meinung zu äußern, und nicht für sie entscheiden, was sie sagen sollen.

Quelle: https://tuoitre.vn/khi-ai-quyet-dinh-ban-duoc-noi-gi-tren-mang-20250701231035288.htm

![[Foto] Feierliche Eröffnung des 8. Kongresses des Zentralkomitees der Partei für öffentliche Sicherheit, Amtszeit 2025–2030](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/f3b00fb779f44979809441a4dac5c7df)

![[Foto] Generalsekretär To Lam nimmt am 8. Kongress des Zentralkomitees der Partei für öffentliche Sicherheit teil](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/79fadf490f674dc483794f2d955f6045)

![[Foto] Lebhaftes Mittherbstfest im Museum für Völkerkunde](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/4/da8d5927734d4ca58e3eced14bc435a3)

![[VIDEO] Zusammenfassung der Zeremonie zum 50. Jahrestag von Petrovietnam](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/10/4/abe133bdb8114793a16d4fe3e5bd0f12)

![[VIDEO] GENERALSEKRETÄR VON LAM VERLEIHT PETROVIETNAM 8 GOLDENE WORTE: „PIONIER – EXZELLENZ – NACHHALTIG – GLOBAL“](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/7/23/c2fdb48863e846cfa9fb8e6ea9cf44e7)

Kommentar (0)