Nachdem das Startup OpenAI Ende 2022 seine erste KI-Anwendung ChatGPT auf den Markt gebracht hatte, wurde eine Welle der KI-Anwendungsentwicklung, insbesondere im Bereich der generativen KI, ausgelöst, die viele Vorteile für alle Lebensbereiche mit sich brachte. Dies birgt jedoch auch viele Risiken.

Verletzung der Privatsphäre

In den letzten Jahren haben viele Organisationen und Privatpersonen erhebliche Verluste erlitten, da Cyberkriminelle mithilfe von KI gefälschte Videoclips erstellt haben, die das Bild und die Stimme echter Personen täuschend echt imitieren. Ein Paradebeispiel hierfür ist der Deepfake-Betrug, bei dem die betroffene Person getäuscht wird und sich als real ausgibt.

Laut dem von Sumsub Ende November 2023 veröffentlichten Bericht über Identitätsbetrug haben sich Deepfake-Betrügereien weltweit in den zwei Jahren zwischen 2022 und 2023 verzehnfacht. Dies war auch der Zeitraum, in dem KI-generierte Anwendungen weltweit einen regelrechten Boom erlebten.

Status Labs stellt fest, dass die Deepfake-Technologie erhebliche Auswirkungen auf Kultur, Privatsphäre und persönlichen Ruf hat. Ein Großteil der Berichterstattung und Aufmerksamkeit rund um Deepfakes konzentrierte sich auf Prominentenpornografie, Racheinhalte, Desinformation, Fake News, Erpressung und Betrug. So wurde beispielsweise 2019 ein US-amerikanisches Energieunternehmen um 243.000 US-Dollar betrogen, indem Hacker sich als Unternehmensleiter und deren Stimmen ausgaben und von den Mitarbeitern die Überweisung von Geld an Partner forderten.

Reuters berichtete, dass im Jahr 2023 weltweit rund 500.000 Deepfake-Video- und Audiodateien in sozialen Medien geteilt wurden. Neben Deepfakes, die zum Spaß erstellt werden, gibt es auch Betrugsversuche, bei denen Kriminelle die Öffentlichkeit täuschen wollen. Einige Quellen gehen davon aus, dass Deepfake-Betrug im Jahr 2022 weltweit Schäden in Höhe von schätzungsweise 11 Millionen US-Dollar verursacht hat.

Viele Technologieexperten warnen vor den Schattenseiten der KI, darunter Probleme mit Urheberrechten und Authentizität sowie Streitigkeiten um geistiges Eigentum zwischen KI-generierten Werken. Beispielsweise könnte jemand mithilfe einer KI ein Bild zu einem bestimmten Thema malen, und eine andere Person könnte dasselbe mit einer KI tun, was zu sehr ähnlichen Gemälden führen würde.

Dies führt leicht zu Eigentumsstreitigkeiten. Bislang hat die Welt jedoch noch keine Einigung darüber erzielt, ob das Urheberrecht für KI-generierte Inhalte anerkannt werden soll (weder für Einzelpersonen, die KI-generierte Inhalte in Auftrag geben, noch für Unternehmen, die KI-Anwendungen entwickeln).

Ein von einer KI-Anwendung erstelltes Bild.

Es ist schwierig, zwischen Original und Fälschung zu unterscheiden.

Können KI-generierte Inhalte also Urheberrechte verletzen? Technisch gesehen werden KI-generierte Inhalte von Algorithmen aus Trainingsdaten erstellt. Diese Datenbanken werden von KI-Anwendungsentwicklern aus verschiedenen Quellen zusammengetragen, vorwiegend aus dem riesigen Wissensbestand des Internets. Viele dieser Werke sind bereits urheberrechtlich geschützt.

Am 27. Dezember 2023 reichte die New York Times Klage gegen OpenAI (mit ChatGPT) und Microsoft ein. Sie warf den beiden Unternehmen vor, Millionen ihrer Artikel zum Trainieren von KI-Chatbots und -Plattformen verwendet zu haben. Zu den vorgelegten Beweisen gehörten von den Chatbots auf Nutzeranfrage generierte Inhalte, die den Artikeln ähnelten oder mit ihnen identisch waren. Die Zeitung konnte nicht länger ignorieren, dass ihr geistiges Eigentum von diesen Unternehmen gewinnbringend genutzt wurde.

Die New York Times ist die erste große amerikanische Zeitung, die eine Urheberrechtsklage im Zusammenhang mit KI eingereicht hat. Es ist möglich, dass in Zukunft weitere Zeitungen ebenfalls klagen werden, insbesondere nach dem erfolgreichen Fall der New York Times.

Zuvor hatte OpenAI im Juli 2023 Lizenzvereinbarungen mit Associated Press und im Dezember 2023 mit Axel Springer – dem deutschen Verlag, dem Politico und Business Insider gehören – abgeschlossen.

Die Schauspielerin Sarah Silverman war im Juli 2023 ebenfalls in mehrere Klagen verwickelt. Sie warf Meta und OpenAI vor, ihre Memoiren als Trainingsmaterial für KI-Programme verwendet zu haben. Viele Autoren äußerten sich besorgt, nachdem bekannt wurde, dass KI-Systeme Zehntausende von Büchern in ihre Datenbanken aufgenommen hatten, was zu Klagen von Autoren wie Jonathan Franzen und John Grisham führte.

Unterdessen hat auch Getty Images, ein Fotodienstleistungsunternehmen, ein KI-Unternehmen verklagt, weil dieses angeblich Bilder auf der Grundlage von Texteingaben erstellt hatte, und zwar unter unerlaubter Verwendung des urheberrechtlich geschützten Bildmaterials des Unternehmens.

Nutzer können auf Urheberrechtsprobleme stoßen, wenn sie „unachtsam“ Werke verwenden, die sie mithilfe von KI-Tools in Auftrag gegeben haben. Experten raten daher stets dazu, KI-Tools nur für Forschungszwecke, Datenerhebung und als Referenzmaterial zu nutzen.

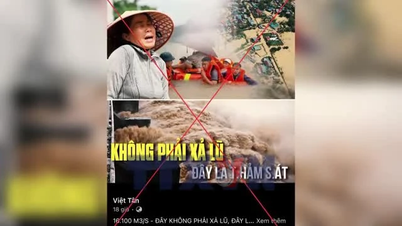

Ein weiteres Problem besteht darin, dass KI-Anwendungen Nutzer verwirren, indem sie es erschweren, zwischen echten und gefälschten Inhalten zu unterscheiden. Verlage und Redaktionen sind möglicherweise verunsichert, wenn sie Manuskripte erhalten. Auch Lehrkräfte haben Schwierigkeiten festzustellen, ob in Schülerarbeiten KI zum Einsatz kam.

Die Nutzer müssen nun wachsamer sein, da es schwierig ist, zwischen echten und gefälschten Inhalten zu unterscheiden. Beispielsweise wird es für den Durchschnittsnutzer schwer sein zu erkennen, ob ein Foto manipuliert oder von einer KI bearbeitet wurde.

Es bedarf rechtlicher Regelungen hinsichtlich des Einsatzes von KI.

Bis zur Entwicklung von Werkzeugen zur Erkennung von KI-Eingriffen müssen Regulierungsbehörden klare und spezifische rechtliche Regelungen für die Nutzung dieser Technologie zur Erstellung von Originalinhalten festlegen. Diese Regelungen sollten der Öffentlichkeit deutlich machen, welche Inhalte oder Werke durch KI manipuliert wurden, beispielsweise durch das standardmäßige Hinzufügen eines Wasserzeichens zu KI-verarbeiteten Bildern.

Quelle: https://nld.com.vn/mat-trai-cua-ung-dung-tri-tue-nhan-tao-196240227204333618.htm

![[Foto] Bezaubernder, alter Rosengarten am Berghang in Nghe An](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766109900916_vuon-hong-chin-do-thu-hut-du-khach-toi-check-in-o-ha-noi-3-20162778-1671624890024-1671624890104198100259.jpeg&w=3840&q=75)

![[Foto] Generalsekretär To Lam besucht den Ausstellungsraum, in dem Bücher, Fotoausstellungen und Errungenschaften der digitalen Transformation im Journalismus präsentiert werden.](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F19%2F1766110879215_1766110240024-jpg.webp&w=3840&q=75)

![[INFOGRAFIK] Überblick über das Projekt „Eisenbahn- und Spezialstahlproduktionsanlage Hoa Phat Dung Quat“](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/19/1766111183203_z7339170069817-126a3e5a095f62e606a0be41015c1b80.jpeg)

Kommentar (0)