Laut VNA wird Japan eine neue Agentur gründen, deren Aufgabe es ist, Sicherheitsstandards für künstliche Intelligenz (KI) zu entwickeln, um auf Risiken wie den Missbrauch von KI zur Erstellung gefälschter Inhalte und Verbreitung falscher Informationen zu reagieren, die immer häufiger auftreten.

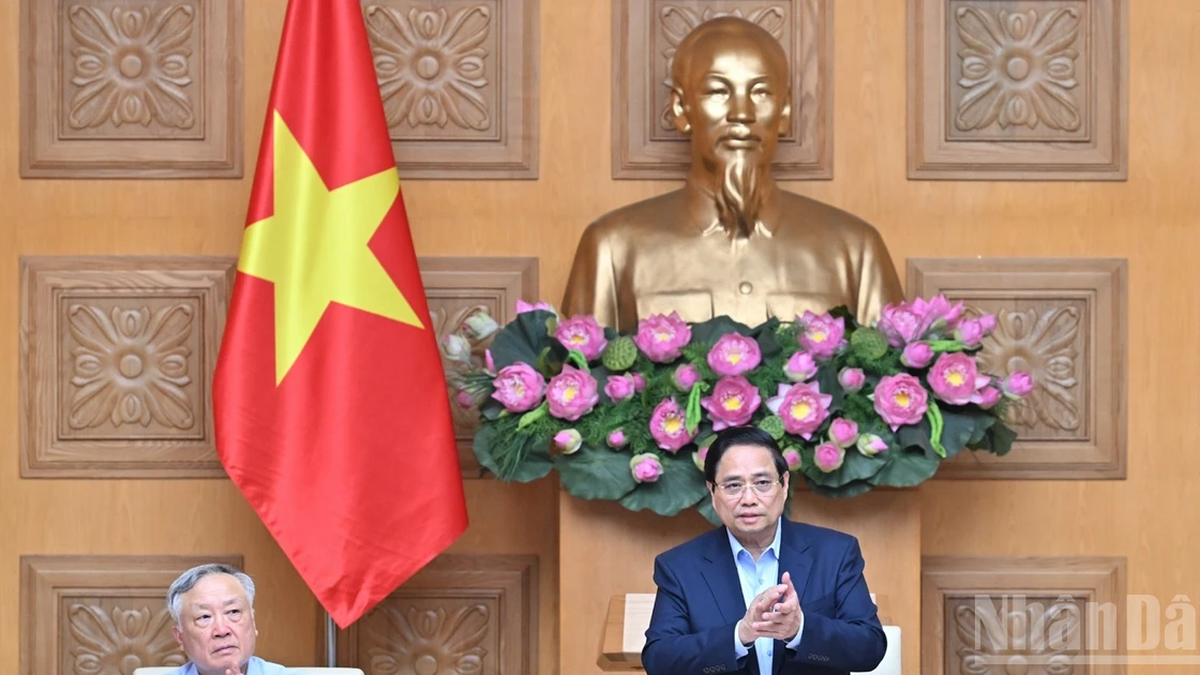

Die oben genannten Informationen wurden von Premierminister Fumio Kishida auf der Sitzung des AI Strategy Council am 21. Dezember in Tokio bekannt gegeben.

Die neue Organisation soll im Januar 2024 unter dem Namen „AI Safety Institute“ (AISI) der Information Technology Promotion Agency (IPA) des japanischen Ministeriums für Wirtschaft , Handel und Industrie (METI) unterstellt werden.

AISI wird aus KI- und Cybersicherheitsexperten bestehen, die für die Festlegung von Sicherheitsbewertungsstandards für Unternehmen, die KI entwickeln, und die Überprüfung des Risikos eines KI-Missbrauchs verantwortlich sind.

Auf dem Treffen diskutierte der KI-Rat außerdem die „KI-Leitlinien“, die zehn Grundsätze umfassen und inländische Unternehmen dazu auffordern, bei der Entwicklung und Nutzung von KI den Menschen in den Mittelpunkt zu stellen.

Wie geplant werden die „KI-Leitlinien“ im März 2024 offiziell verabschiedet und gelten für Entwickler, KI-Dienstleister und Anwender.

Die Grundsätze der „KI-Leitlinien“ bauen auf dem „Hiroshima-KI-Prozess“ der Gruppe der Sieben (G7) zur Entwicklung internationaler Regeln auf.

Im Einklang mit dem menschenzentrierten Prinzip fordern die Leitlinien Unternehmen auf, Menschenrechte und Vielfalt zu respektieren, Maßnahmen zur Bekämpfung von Fehlinformationen zu ergreifen und strikt auf die Entwicklung, Bereitstellung und Nutzung von KI-Diensten zu verzichten, die menschliche Entscheidungen und Emotionen negativ beeinflussen. Darüber hinaus enthalten die Leitlinien weitere Grundsätze wie den Schutz der Privatsphäre sowie die Gewährleistung von Fairness, Sicherheit und Transparenz.

Anfang Oktober kündigte der britische Premierminister Rishi Sunak die Gründung des weltweit ersten Instituts für KI-Sicherheit an, um neue Formen der KI zu testen, zu bewerten und zu erproben. So können Regulierungsbehörden die Fähigkeiten jedes neuen Modells erfassen und alle Risiken identifizieren – von sozialen Schäden wie Voreingenommenheit und Fehlinformationen bis hin zu den größten Risiken.

Kurz darauf kündigte US-Handelsministerin Gina Raimondo an, dass die USA in Zusammenarbeit mit dem National Institute of Standards and Technology ein AI Safety Institute gründen würden, um die Sicherheit und Zuverlässigkeit künstlicher Intelligenz zu gewährleisten.

Künstliche Intelligenz hat in jüngster Zeit einen neuen Durchbruch in der Investitionswelle in Technologie bewirkt. Technologieexperten weisen jedoch darauf hin, dass künstliche Intelligenz mit vielen Risiken und Herausforderungen verbunden ist und Bedenken hinsichtlich des Vertrauens in Daten, Algorithmen und Anwendungen bestehen.

Um den größtmöglichen Nutzen aus künstlicher Intelligenz zu ziehen, ist es daher wichtig, der Öffentlichkeit das Vertrauen zu vermitteln, dass diese Technologie verantwortungsvoll entwickelt und eingesetzt wird.

Vor Kurzem haben 18 Länder, darunter die USA, Großbritannien, Deutschland, Italien, die Tschechische Republik, Polen, Australien, Chile und Singapur, eine Vereinbarung unterzeichnet, um Unternehmen zu ermutigen, künstliche Intelligenzsysteme zu entwickeln, die bereits in der Entwurfsphase sicher sind, um das Risiko eines Missbrauchs zu vermeiden.

Dies gilt als die jüngste einer Reihe von Initiativen von Regierungen auf der ganzen Welt, die die Entwicklung künstlicher Intelligenz fördern sollen, die einen immer größeren Einfluss auf die Industrie und die Gesellschaft im Allgemeinen hat.

Minh Hoa (t/h)

[Anzeige_2]

Quelle

![[Foto] Vorsitzender der Nationalversammlung nimmt am Seminar „Aufbau und Betrieb eines internationalen Finanzzentrums und Empfehlungen für Vietnam“ teil](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/7/28/76393436936e457db31ec84433289f72)

Kommentar (0)