Weltweit sehen sich die Musik- und Filmindustrien mit den rechtlichen und ethischen Implikationen von KI-Modellen konfrontiert, die nach dem Training mit populären Werken eigene Produkte erstellen können, ohne die Urheber der Originalinhalte unbedingt zu bezahlen, so Paul McCartney.

Im Dezember 2024 schlug die britische Regierung einen Weg vor, wie Künstler ihre Werke für das Training von KI-Technologien lizenzieren können, sagte aber auch, dass es eine Ausnahme geben sollte, „um die großflächige Nutzung einer breiten Palette von Materialien durch KI-Entwickler zu unterstützen, bei denen keine Rechte reserviert wurden“.

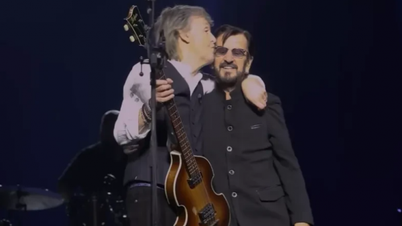

Paul McCartney warnt davor, dass KI zum „Betrug“ von Künstlern missbraucht werden könnte

In einem am 27. Januar ausgestrahlten BBC- Interview äußerte Paul McCartney seine Besorgnis darüber, dass nur die Tech-Giganten profitieren würden, wenn das Urheberrecht nicht ausreichend geschützt würde.

„KI ist eine wunderbare Sache, aber sie sollte den Urhebern nicht ihre Rechte nehmen. Der Staat muss die Künstler schützen, sonst wird es keine mehr geben. So einfach ist das“, sagte McCartney.

Die Regierung berät über eine Reform des Urheberrechts und erklärt, es herrsche Rechtsunsicherheit darüber, wie das geltende Recht in Großbritannien anzuwenden sei, was Investitionen und die Akzeptanz von KI-Technologien zu untergraben drohe.

Der Musiker, der 2023 mithilfe von KI die Stimme des verstorbenen Beatles John Lennon anhand einer alten Kassettenaufnahme nachbildete, sagte, es bestehe die Gefahr, dass Künstler das Nachsehen hätten, wenn die Änderungen nicht ordnungsgemäß umgesetzt würden.

Paul McCartney fügte hinzu: „Es kommen junge Männer und Frauen daher. Sie schreiben einen tollen Song, aber er gehört ihnen nicht, sie haben nichts damit zu tun, und jeder, der will, kann ihn kopieren. Die Wahrheit ist, wissen Sie, dass alles auf Streaming-Plattformen verfügbar sein wird.“

Quelle: https://thanhnien.vn/paul-mccartney-nhom-the-beatles-canh-bao-ai-co-the-duoc-su-dung-de-lua-dao-185250127105058921.htm

![[Foto] Da Nang: Hunderte Menschen helfen nach Sturm Nr. 13 bei der Reinigung einer wichtigen Touristenroute.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/07/1762491638903_image-3-1353-jpg.webp)

Kommentar (0)