Es hora de que cada usuario se convierta en un "escudo digital", estando alerta, vigilante y siendo responsable con cada clic y cada vez que comparte contenido.

Los beneficios y la delgada línea que separa la IA

Nunca antes la inteligencia artificial había estado tan presente en nuestra vida cotidiana. Con tan solo unos clics y una breve instrucción, podemos crear voces, imágenes e incluso vídeos con un realismo asombroso. La IA ahorra tiempo, reduce los costes de producción de contenido e inaugura una era de medios digitales flexibles.

Sin embargo, esta misma capacidad de "simular la realidad de forma realista" se ha convertido en un arma de doble filo. Recientemente, las redes sociales se han inundado de vídeos creados con tecnología deepfake, en los que se manipulan y distorsionan los rostros de los jefes de policía y las imágenes de los agentes del orden en casos delicados, añadiendo voces en off para engañar y dividir a la opinión pública.

Este tipo de imágenes manipuladas son cada vez más comunes en las redes sociales.

En un vídeo viral de TikTok, se yuxtapusieron imágenes de un agente de policía de tráfico en servicio con un diálogo ofensivo, acompañado del hashtag "multas solo para aparentar", dando a entender que el agente abusaba de su poder para beneficio personal. Muchos usuarios, sobre todo jóvenes, creyeron fácilmente este contenido debido al realismo de las imágenes y a que la voz coincidía con los movimientos de los labios, lo que hacía extremadamente difícil distinguir entre lo real y lo falso.

Un joven youtuber de Dien Bien , simplemente por querer "presumir" de sus habilidades en tecnología de IA, ha pagado las consecuencias con una multa administrativa y una disculpa pública forzada. En la tarde del 24 de enero, la policía provincial de Dien Bien anunció que el Departamento de Ciberseguridad y Prevención de Delitos de Alta Tecnología había impuesto una multa administrativa de 7,5 millones de VND a Tong Van T. (nacido en 2001, residente en el distrito de Muong Ang) por usar IA para crear un vídeo manipulado con contenido distorsionado e insultante sobre los agentes de policía de tráfico.

En concreto, el 7 de enero, T. subió un vídeo de más de 3 minutos a su cuenta de YouTube "Tuyen Vlog" con el impactante título: "Mientras estaba fuera de casa, me persiguió la policía de tráfico". En el vídeo, las imágenes y situaciones fueron recreadas mediante tecnología de IA, simulando a la policía de tráfico persiguiendo a ciudadanos, y se combinaron con efectos y comentarios ofensivos y difamatorios hacia las fuerzas del orden.

En colaboración con la policía, T. admitió que todo el contenido del video era un montaje creado con fines de entretenimiento y para demostrar su habilidad con la tecnología de IA. Además de la multa, las autoridades le ordenaron a T. eliminar el video falso y disculparse públicamente con la policía de tránsito en su canal personal de YouTube.

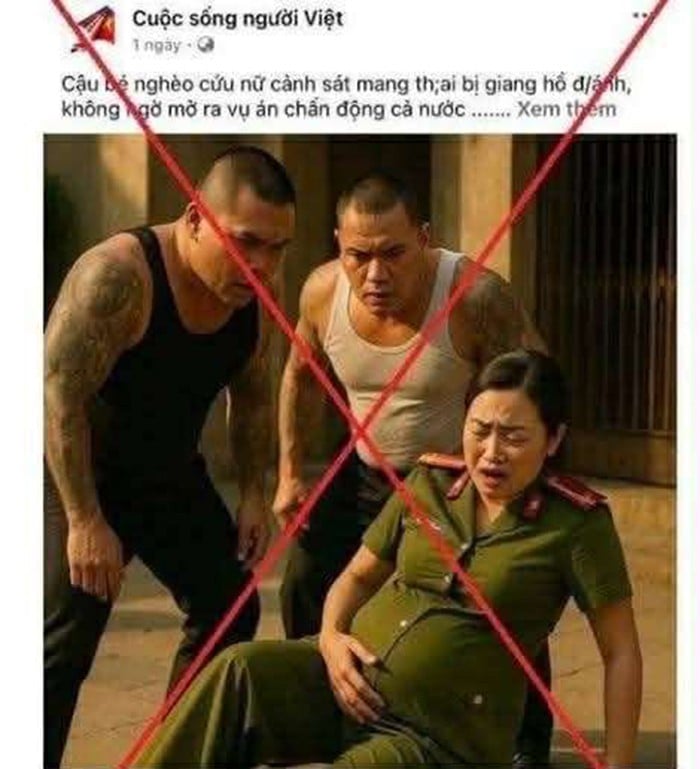

En la era de la revolución digital , especialmente con el rápido desarrollo de la inteligencia artificial, las fuerzas hostiles y reaccionarias no han dudado en explotar esta herramienta para crear imágenes y relatos falsos con el objetivo de distorsionar y empañar la imagen de la Policía Popular de Vietnam. Una fotografía que circula recientemente en las redes sociales, en la que se ve a una mujer embarazada con uniforme policial siendo amenazada por dos hombres con aspecto de gánster, es una clara muestra de esta táctica.

La imagen, creada mediante inteligencia artificial, se ha vuelto viral recientemente en las redes sociales.

A primera vista, los espectadores podrían confundir fácilmente esta escena con una real, acompañada de titulares sensacionalistas como: «Un pobre chico salva a una policía embarazada que estaba siendo atacada por gánsteres, descubriendo sin saberlo un caso que conmociona a toda la nación…». Sin embargo, en realidad se trata de una escena montada, posiblemente de una película o producto de entretenimiento, o peor aún, una imagen creada por IA para engañar las emociones del lector, llevándolo a sentir lástima y a dudar de la autenticidad de las fuerzas del orden.

Lo más preocupante es que la difusión de este tipo de contenido no solo daña la reputación e imagen de la Policía Popular, que trabaja día y noche para proteger la seguridad y el orden social, sino que también constituye una forma sofisticada de guerra psicológica. Cuando la confianza del pueblo en las autoridades se ve erosionada por imágenes engañosas, los motivos ocultos de las fuerzas hostiles para dividir la unidad nacional se irán haciendo realidad.

Por lo tanto, es necesario que cada ciudadano aumente su nivel de vigilancia, desarrolle habilidades de pensamiento crítico y la capacidad de identificar información falsa, y que denuncie y refute con firmeza el contenido falso, contribuyendo así a proteger los fundamentos ideológicos y a mantener la estabilidad social frente a la actual ola de información dañina en internet.

En Ciudad Ho Chi Minh, un video de casi un minuto de duración se viralizó inesperadamente en las redes sociales. En él se ve a una persona con uniforme policial "coaccionando" a un sospechoso para que confesara una infracción de tránsito en una oficina. En el video, la persona, que se cree que es un agente de policía, muestra una actitud agresiva, gritando constantemente e incluso usando lenguaje grosero, lo que provocó indignación pública.

Sin embargo, poco después de que el vídeo se viralizara, la policía de Ciudad Ho Chi Minh investigó rápidamente y confirmó que se trataba de un sofisticado deepfake. Según sus conclusiones, los rostros del vídeo fueron extraídos de la grabación de una conferencia policial interna y manipulados por individuos malintencionados mediante inteligencia artificial para superponerlos a una escena montada, haciendo creer a los espectadores que se trataba de un evento real.

En concreto, el audio que lo acompaña incluye voces amenazantes e insultantes que en realidad no son las palabras reales de ningún funcionario, sino voces sintetizadas por IA, programadas y editadas para engañar a las emociones del espectador.

Este incidente es un claro ejemplo del uso de la tecnología deepfake para distorsionar y difamar a la Policía Popular, una táctica cada vez más explotada por fuerzas reaccionarias y subversivas en el ciberespacio. Es importante destacar que, si no se denuncian con prontitud, estos productos falsos pueden tener graves consecuencias: socavar la confianza pública en las fuerzas del orden, incitar a la resistencia en la comunidad y facilitar la difusión de información falsa. Esto constituye una clara advertencia sobre la urgente necesidad de mejorar las capacidades de comunicación para refutar, detectar y combatir las noticias falsas, y hace un llamado a todos los ciudadanos a mantenerse vigilantes y abstenerse de compartir o comentar precipitadamente contenido no verificado de fuentes oficiales.

En otro caso reciente, relacionado con la gestión de irregularidades en un centro de inspección vehicular en el sur del país, elementos hostiles difundieron un video falso en el que un jefe de la policía provincial hablaba en defensa de los funcionarios corruptos. Este video, difundido en Telegram y redes sociales con el título "respaldado por fuerzas poderosas", era en realidad un montaje de inteligencia artificial y no apareció en ninguna conferencia de prensa ni documento oficial.

Una peligrosa tendencia se está extendiendo silenciosamente en internet: ciberdelincuentes utilizan inteligencia artificial para crear vídeos falsos con fines fraudulentos y de extorsión. Recientemente, muchas personas han sido víctimas cuando sus imágenes, especialmente las de personas respetadas socialmente como abogados, médicos y empresarios, se superponen a vídeos que anuncian la "recuperación de dinero perdido en estafas online".

En estos vídeos, se utiliza inteligencia artificial para imitar la voz y el rostro de abogados, engañando a los espectadores y llevándolos a proporcionar fácilmente información personal o transferirles dinero. Aún más peligroso, algunos delincuentes utilizan tecnología deepfake para superponer los rostros de las víctimas en vídeos sexuales y luego enviarlos a sus parejas o compañeros de trabajo con la intención de amenazarlos o coaccionarlos para que transfieran dinero a cambio de su silencio.

En marzo de 2025, se produjo un incidente impactante cuando una víctima en Hanói fue obligada a transferir decenas de millones de dongs tras recibir un vídeo sexual falso en el que aparecía. Mientras tanto, en Ciudad Ho Chi Minh, otra persona fue extorsionada con 2.000 millones de dongs a cambio de impedir la difusión del vídeo comprometedor. El Ministerio de Seguridad Pública inició una investigación, identificando a varios grupos criminales transnacionales, principalmente de China y el sudeste asiático, que operaban estas redes utilizando tarjetas SIM desechables, monederos electrónicos y plataformas de redes sociales para ocultar sus identidades.

Esto ya no es una estafa menor, sino una forma de «guerra psicológica de alta tecnología» que explota profundamente los temores relacionados con el honor y las relaciones sociales para presionar a las víctimas. Sin una mayor vigilancia y sin habilidades para identificar información y comportamientos inusuales, cualquiera puede convertirse en presa de estos delincuentes tecnológicos. Ante esta sofisticada ola de suplantación de identidad, todos los ciudadanos deben mantenerse alerta, abstenerse por completo de compartir información personal indiscriminadamente y estar dispuestos a denunciar las actividades ilegales, contribuyendo así a proteger su propia seguridad y la de la comunidad.

Se necesita un "escudo digital" por parte de la comunidad para combatir la amenaza de los deepfakes.

Según el Departamento de Radiodifusión, Televisión e Información Electrónica (Ministerio de Cultura, Deportes y Turismo), en 2024, las plataformas digitales en Vietnam tuvieron que eliminar más de 4000 videos con información falsa y distorsionada, la mayoría de los cuales eran productos creados con tecnología de IA, como deepfakes y clonación de voces. Solo a TikTok, una plataforma popular entre los jóvenes, se le pidió que eliminara más de 1300 videos deepfake, principalmente relacionados con la policía, el gobierno y las políticas sociales.

En la era del auge tecnológico, la inteligencia artificial está desplegando un potencial revolucionario, pero también conlleva peligros sin precedentes, especialmente los deepfakes que contienen contenido distorsionado y que atentan contra la reputación de las agencias gubernamentales. Una encuesta del Instituto de Investigación de Medios MICRI revela que el 62 % de los usuarios de redes sociales en Vietnam no pueden distinguir entre información real y falsa sin advertencias de los medios de comunicación tradicionales o las autoridades. Esta es una "brecha cognitiva" que fuerzas malintencionadas están explotando al máximo para difundir desinformación y perturbar la psicología social.

Tong Van T. en la comisaría.

Según el general de división, profesor asociado y doctor Do Canh Thin, experto en criminología, el uso de la IA para crear vídeos falsos que suplanten la identidad de líderes, editen declaraciones falsas o distorsionen las acciones profesionales de la policía es una táctica nueva pero particularmente peligrosa. «El deepfake no es simplemente un producto de entretenimiento, sino una forma de guerra de información moderna, capaz de socavar la confianza, provocar inestabilidad social y es muy difícil de controlar», afirmó el general de división Do Canh Thin.

En realidad, los vídeos manipulados con IA distan mucho de ser inofensivos; a menudo abordan temas delicados como la gestión de infracciones, la investigación de delitos y la lucha contra la corrupción, lo que genera confusión pública y desconfianza hacia las fuerzas del orden. Aún más preocupante es que muchos vídeos se comparten en plataformas importantes como YouTube y TikTok, donde acumulan cientos de miles de visualizaciones antes de ser eliminados, creando un efecto dominó negativo.

El experto en medios digitales Hoang Minh advierte: "Un simple 'me gusta' o un 'compartir' sin pensar puede convertirte en cómplice de noticias falsas. Todos los usuarios de internet deben comprender que las acciones en el espacio digital también tienen consecuencias reales".

En este contexto, lo que se necesita más que nunca es construir un «escudo digital» desde dentro de la propia comunidad: es decir, vigilancia, inmunidad informativa y un sentido de responsabilidad hacia el entorno en línea. La tecnología puede ser neutral, pero la forma en que las personas la utilicen determinará si la IA se convierte en un motor de desarrollo o en una fuerza destructiva contra la confianza social. Mantener la firmeza ideológica y proteger la imagen del agente de policía es proteger los cimientos de la seguridad nacional, una tarea que no solo corresponde a las autoridades competentes, sino a todos los ciudadanos en la era digital.

Fuente: https://baolangson.vn/tinh-hai-mat-cua-ai-5050403.html

![[Foto] El primer ministro Pham Minh Chinh preside un diálogo con empresarios japoneses.](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2026/03/21/1774097547316_ndo_br_dsc-0448-jpg.webp)

Kommentar (0)