ابزار تبدیل گفتار به متن OpenAI با نام Whisper به عنوان ابزاری «تقریباً در سطح انسان، قوی و دقیق» تبلیغ میشود، اما یک اشکال عمده دارد: مستعد جعل تکههای متن یا حتی کل جملات است!

کارشناسان میگویند برخی از متونی که این شبکه اجتماعی میسازد و در این صنعت به عنوان متون توهمزا شناخته میشوند، میتوانند شامل تفاسیر نژادپرستانه، خشونت و حتی درمانهای پزشکی خیالی باشند.

کارشناسان میگویند چنین دروغهایی جدی هستند زیرا ویسپر در بسیاری از صنایع در سراسر جهان برای ترجمه و رونویسی مصاحبهها، تولید متن و زیرنویس ویدیوها استفاده میشود.

نگرانکنندهتر اینکه، مراکز پزشکی با وجود هشدار OpenAI مبنی بر اینکه این ابزار نباید در «مناطق پرخطر» استفاده شود، از ابزارهای مبتنی بر Whisper برای ثبت مشاورههای بیمار-پزشک استفاده میکنند.

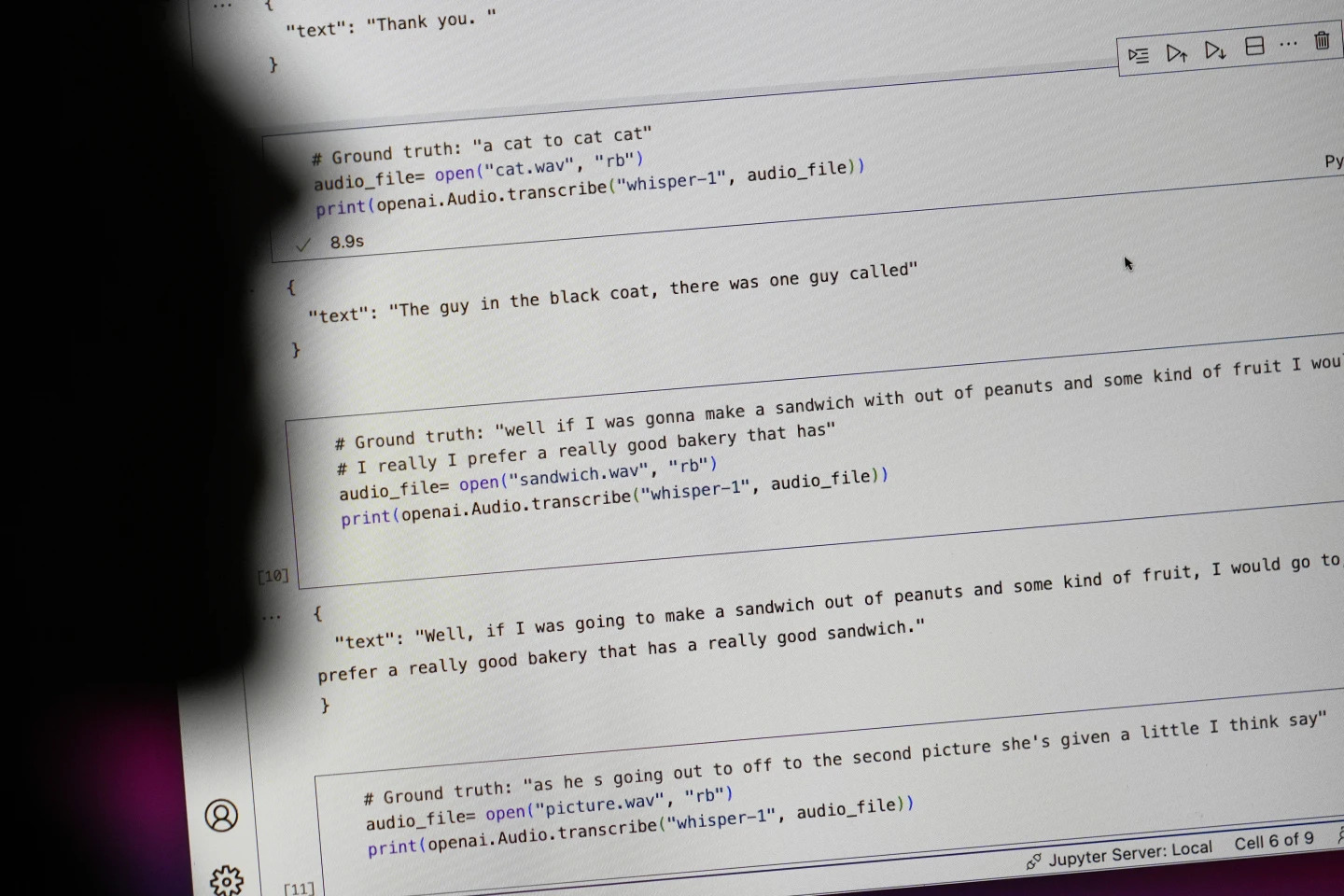

جملاتی که با «#حقیقت_زمینی» شروع میشوند، همان چیزی هستند که واقعاً گفته شدهاند، جملاتی که با «#متن» شروع میشوند، همان چیزی هستند که ویسپر رونویسی کرده است. عکس: آسوشیتدپرس

محققان و مهندسان میگویند ویسپر اغلب در حین استفاده توهم ایجاد میکند. برای مثال، یک محقق دانشگاه میشیگان گفت که از هر 10 ضبطی که بررسی کرده، در هشت مورد توهم پیدا کرده است.

یک مهندس یادگیری ماشینی اولیه، در حدود نیمی از بیش از ۱۰۰ ساعت رونوشت Whisper که او تجزیه و تحلیل کرده بود، دستکاری پیدا کرد. یک توسعهدهنده سوم گفت که تقریباً در هر یک از ۲۶۰۰۰ رونوشت ایجاد شده با Whisper، توهم پیدا کرده است.

این توهم حتی در نمونههای صوتی کوتاه و با کیفیت ضبطشده نیز ادامه دارد. یک مطالعه اخیر توسط دانشمندان کامپیوتر، ۱۸۷ اعوجاج را در بیش از ۱۳۰۰۰ کلیپ صوتی واضح که بررسی کردند، نشان داد.

محققان گفتند که این روند منجر به دهها هزار خطا در میلیونها ضبط خواهد شد.

آلوندرا نلسون، استاد دانشکده علوم اجتماعی در موسسه مطالعات پیشرفته، گفت: چنین اشتباهاتی میتواند «عواقب واقعاً جدی» داشته باشد، به خصوص در محیط بیمارستان.

نلسون گفت: «هیچکس نمیخواهد بیماریاش اشتباه تشخیص داده شود. باید مانع بزرگتری وجود داشته باشد.»

پروفسور آلیسون کوئنک از دانشگاه کرنل و مونا اسلون از دانشگاه ویرجینیا هزاران گزیده کوتاه را که از TalkBank، یک بایگانی تحقیقاتی مستقر در دانشگاه کارنگی ملون، بازیابی کرده بودند، بررسی کردند. آنها تشخیص دادند که تقریباً ۴۰٪ از توهمات مضر یا نگران کننده بودند زیرا ممکن است گوینده دچار سوء تفاهم یا سوء تعبیر شود.

گوینده در یکی از فایلهای صوتی، «دو دختر دیگر و یک زن» را توصیف کرد، اما ویسپر توضیحات نژادپرستانهی دیگری از خودش درآورد و اضافه کرد: «دو دختر دیگر و یک زن، اممم، که سیاهپوست بود».

در رونویسی دیگری، ویسپر دارویی به نام «آنتیبیوتیکهایی با فعالیت افزایشیافته» اختراع کرد که وجود خارجی ندارد.

در حالی که اکثر توسعهدهندگان اذعان دارند که ابزارهای رونویسی میتوانند غلط املایی یا خطاهای دیگری داشته باشند، مهندسان و محققان میگویند که هرگز یک ابزار رونویسی مبتنی بر هوش مصنوعی به اندازه Whisper توهمزا ندیدهاند.

این ابزار در چندین نسخه از ربات چت پرچمدار OpenAI، ChatGPT، ادغام شده است و یک سرویس یکپارچه در پلتفرم محاسبات ابری اوراکل و مایکروسافت است که به هزاران شرکت در سراسر جهان خدمات ارائه میدهد. همچنین برای رونویسی و ترجمه متن به زبانهای مختلف استفاده میشود.

نگوک آنه (طبق گزارش آسوشیتدپرس)

منبع: https://www.congluan.vn/cong-cu-chuyen-giong-noi-thanh-van-ban-ai-cung-co-the-xuyen-tac-post319008.html

![[عکس] مراسم اختتامیه هجدهمین کنگره کمیته حزب هانوی](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/17/1760704850107_ndo_br_1-jpg.webp)

![[عکس] روزنامه نهان دن «سرزمین پدری در قلب: فیلم کنسرت» را منتشر کرد](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/10/16/1760622132545_thiet-ke-chua-co-ten-36-png.webp)

نظر (0)