«پدرخواندههای هوش مصنوعی»، برندگان جایزه VinFuture 2024، معتقدند که دانشمندان باید اطمینان حاصل کنند که سناریوهای هوش مصنوعی، بقای بشریت را تهدید نمیکنند.

امروز، ۷ دسامبر، برندگان جایزه VinFuture 2024 با دانشجویان و دانشمندان جوان دانشگاه VinUni در مورد تحقیقات علمی و همچنین چشمانداز آینده زمینههایی که دنبال میکنند، تعامل داشتند. در اینجا، برندگان جایزه اصلی، دانشمندان برجستهای که آثار پیشگامانهشان پایه و اساس انقلاب هوش مصنوعی امروزی را بنا نهاده است، در مورد پیشرفتهای شگفتانگیز هوش مصنوعی صحبت کردند.

پروفسور یان لکان (وسط) و پروفسور یوشع بنگیو (جلد سمت چپ) در جلسه تبادل نظر

انگار ده سال به آینده پریدهایم.»

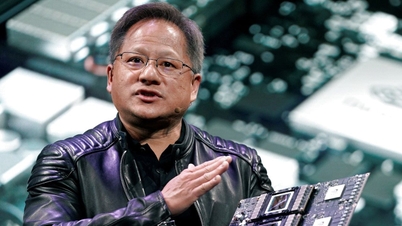

پروفسور جفری هینتون، از دانشگاه تورنتو، کانادا، که برای دریافت جایزه به ویتنام نیامده بود، در این تبادل ویدیویی شرکت کرد. او، پروفسور یان لکان و پروفسور یوشوا بنگیو، جایزه تورینگ (جایزهای که به عنوان جایزه نوبل در زمینه علوم کامپیوتر شناخته میشود) را در سال ۲۰۱۸ دریافت کردند و همگی توسط رسانههای بینالمللی "پدرخواندههای هوش مصنوعی" نامیده شدند. اکنون، هر سه نفر آنها همچنان توسط VinFuture 2024 در جایزه اصلی به همراه دو دانشمند دیگر، پروفسور فی فی لی (ایالات متحده آمریکا) و آقای جنسن هوانگ (مدیرعامل NVIDIA) مورد تقدیر قرار میگیرند.

به گفته پروفسور هینتون، رونق اخیر در هوش مصنوعی نتیجه سه عامل است. اول، تحقیق برای توسعه روشهای کارآمدتر برای یادگیری شبکههای عصبی است که او، پروفسور یوشوا، پروفسور یان و بسیاری دیگر انجام دادهاند. سپس قدرت محاسباتی بسیار سریع واحدهای پردازش گرافیکی (GPU) و حجم عظیم دادههایی که میتوانیم جمعآوری کنیم، وجود دارد.

پروفسور جفری هینتون از طریق ویدئو به اشتراک میگذارد

پروفسور هینتون گفت: «یکی از جنبههای عالی این جایزه (VinFuture 2024) به رسمیت شناختن کار آقای جنسن هوانگ در پیشگامی در ساخت بردهای GPU مفید برای هوش مصنوعی است. ترکیب برد GPU جنسن هوانگ و مجموعه دادههای پروفسور فی فی لی نقش مهمی در توسعه مدرن هوش مصنوعی ایفا کرده است. بسیار عالی است که کار آنها در کنار کسانی که روی الگوریتمهای شبکه عصبی کار میکنند، مورد تقدیر قرار میگیرد.»

پروفسور هینتون گفت: «ما دریافتیم که وقتی از پردازندههای گرافیکی برای آموزش شبکههای عصبی استفاده میکنیم، آنها 30 برابر سریعتر میشوند. این یک جهش کوانتومی بود. انگار سرعت محاسبات 10 سال از زمان خود جلوتر بود. ناگهان ما 10 سال از نظر سرعت محاسبات از آینده جلوتر بودیم. این یک تغییر اساسی در هوش مصنوعی بود، شگفتانگیز بود!»

دانشمندان هنوز در تلاشند تا ارتباطات موجود در شبکههای عصبی را بیشتر درک کنند. این امر به دانشمندان کمک میکند تا هوش مصنوعیای ایجاد کنند که بیشتر شبیه هوش انسانی باشد و حتی بتواند شهود را توضیح دهد. رویکردهای منطقی سنتی هرگز قادر به انجام این کار نخواهند بود.

«کم کم دارم از هوش مصنوعی میترسم»

پروفسور هینتون گفت که شبکههای عصبی بزرگ امروزی، شهودی مشابه انسانها دارند. از سال گذشته، او نگران این بود که هوش مصنوعی تنها ۵ تا ۲۰ سال طول بکشد تا به اندازه انسان هوشمند شود. پروفسور هینتون گفت: «آن زمان بود که من نگران هوش مصنوعی شدم. توقف توسعه یک گزینه نیست. بنابراین تنها گزینه این است که سعی کنیم بفهمیم چگونه میتوانیم ایمنی را هنگامی که از ما باهوشتر میشود، تضمین کنیم.»

پروفسور هینتون میگوید: «اما من فکر نمیکنم پایان دنیا اجتنابناپذیر باشد. با این حال، نمیتوان احتمالات را نادیده گرفت و ما باید برای جلوگیری از آن سخت تلاش کنیم. امیدواریم که بااستعدادترین دانشجویان، مطالعهی ایمنی هوش مصنوعی را انتخاب کنند و به طیف وسیعی از تهدیدها، از تهدیدهای بلندمدت مانند تصاحب هوش مصنوعی گرفته تا تهدیدهای کوتاهمدت مانند جرایم سایبری، بپردازند.»

پروفسور یوشوا بنجیو و پروفسور یان لکون

پروفسور یان لکون گفت که او همچنین نگران این خطر است که هوش مصنوعی وقتی به اندازه انسان باهوش شود، بر انسان تسلط یابد. با این حال، پاسخ فعلی هنوز مشخص نیست. پروفسور یان گفت: «ما ممکن است هنگام بازی شطرنج با یک اسباببازی کوچک به ارزش 30 یورو ببازیم. آیا این خطرناک است؟ پاسخ منفی است. هوش مصنوعی فقط زمانی خطرناک میشود که ما برای هوش مصنوعی انگیزه (برای کنترل انسانها) ایجاد کنیم. اما در حال حاضر، هوش مصنوعی فقط دانش دارد، نه انگیزه.»

به گفته پروفسور یان، ایجاد هوش مصنوعی که به طور فعال در خدمت انسانها باشد، فقط یک مشکل فنی است. از آنجا که هوش مصنوعی هوشمند است، این فکر که هوش مصنوعی بر انسانها تسلط خواهد یافت، یک تعصب است، زیرا واقعیت نشان میدهد که در جامعه افراد باهوش زیادی وجود داشتهاند اما بر جهان تسلط نیافتهاند! هوش مصنوعی هنوز یک ابزار است، مشکل از انسانهاست، نه خود هوش مصنوعی.

به گفته پروفسور یوشع بنجیو، ما نمیتوانیم ذهنی باشیم، فقط یک مشکل کوچک میتواند بر بقای بشریت تأثیر بگذارد. انسانها میتوانند به ماشینها انگیزه بدهند. به عنوان مثال، کسی میخواهد ماشین را به یک انسان تبدیل کند، و کاری کند که ماشین به نظر برسد که نیاز به "بقا" دارد، ما میخواهیم ماشین را خاموش کنیم اما از خاموش شدن امتناع میکند. پروفسور بنجیو گفت: "البته باید مطمئن شویم که این سناریو اتفاق نمیافتد."

منبع: https://thanhnien.vn/vinfuture-award-2024-recipient-of-award-cannot-do-anyone-does-the-extinction-of-humanity-185241207195331155.htm

![[عکس] دبیرکل تو لام از معاون رئیس گروه Luxshare-ICT (چین) استقبال کرد](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/15/1763211137119_a1-bnd-7809-8939-jpg.webp)

![[عکس] نخست وزیر فام مین چین با نمایندگان معلمان برجسته دیدار میکند](https://vphoto.vietnam.vn/thumb/1200x675/vietnam/resource/IMAGE/2025/11/15/1763215934276_dsc-0578-jpg.webp)

نظر (0)