در زمانی که هوش مصنوعی (AI) به سرعت در حال شتاب گرفتن است و هر سیستمی از جامعه بشری، از آموزش، مراقبتهای بهداشتی، اقتصاد گرفته تا امنیت ملی را تغییر شکل میدهد، بزرگترین سوال دیگر حول محور میزان هوشمندی هوش مصنوعی نمیچرخد، بلکه بر چگونگی مدیریت، استفاده و کنترل این فناوری برای محافظت از مردم تمرکز دارد.

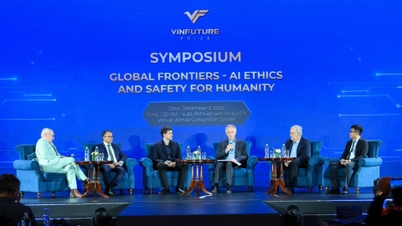

میزگرد «هوش مصنوعی برای بشریت: اخلاق و ایمنی هوش مصنوعی در عصر جدید» که در تاریخ ۲ دسامبر ۲۰۲۵ در چارچوب هفته علم و فناوری VinFuture 2025 برگزار شد، به محفلی تبدیل شده است که بسیاری از چهرههای تأثیرگذار دوران هوش مصنوعی - از یوشع بنگیو، جفری هینتون، وینتون سرف گرفته تا توبی والش - را گرد هم آورده است. تحلیل دقیق آنها نشان میدهد که خطرات احتمالی هوش مصنوعی ممکن است از پیشبینیهای سازندگان آن فراتر رود، در حالی که الزامات شفافیت، انصاف در دادهها، نظارت انسانی و اعتماد اجتماعی به تنگناهای جهانی تبدیل میشوند.

هوش مصنوعی با سرعت بیسابقهای در حال شتاب گرفتن است و چالشهای اخلاقی ایجاد میکند.

هوش مصنوعی با سرعتی بسیار فراتر از انتظارات جامعه علمی در حال پیشرفت است. تنها در عرض چند سال، مدلهای یادگیری عمیق از تشخیص تصویر اولیه به تولید محتوای خودجوش، شبیهسازی احساسات، تصمیمگیریهای پیچیده، طراحی پروتئینها و مشارکت در فرآیندهای خلاقانه رسیدهاند. این جهش فرصتهای بیسابقهای را به ارمغان آورده است، اما همچنین مجموعهای از خطرات غیرقابل پیشبینی را ایجاد کرده است، از سوگیری دادهها، تهدیدات حریم خصوصی، اطلاعات نادرست و سیستمهای خودکاری که دیگر برای انسانها شفاف نیستند.

پروفسور یوشوا بنجیو - برنده مشترک جایزه تورینگ ۲۰۱۸ - معتقد است که بزرگترین چالش امروز این نیست که هوش مصنوعی چه کاری میتواند انجام دهد، بلکه این است که جامعه هنوز قادر به پیشبینی رفتارهایی نیست که از مدلهای پیچیده ناشی میشوند. او هشدار میدهد که مدلهای در مقیاس بزرگ، اگر به درستی کنترل نشوند، میتوانند به گونهای خود را بهینه کنند که باعث شود انسانها «کنترل فناوریای را که خلق میکنند از دست بدهند».

به همین ترتیب، پروفسور جفری هینتون - که به عنوان «پدر هوش مصنوعی» و برنده جایزه نوبل فیزیک ۲۰۲۴ شناخته میشود - اشاره میکند که یادگیری عمیق در حال ورود به مرحلهای است که در آن مدلها به پاسخهای پیچیدهای فراتر از توانایی توضیح دست مییابند. این امر باعث میشود خطرات اخلاقی و ایمنی دیگر فرضی نباشند، بلکه واقعی باشند. هینتون تأکید میکند که برخلاف فناوریهای سنتی، هوش مصنوعی فقط یک ابزار نیست، بلکه میتواند به عنوان یک «عامل» رفتار کند، بنابراین الزام نظارت انسانی باید به یک اصل مطلق ارتقا یابد.

دکتر وینتون سرف - «پدر اینترنت» یک دیدگاه تاریخی را به اشتراک میگذارد: اینترنت با این باور ساخته شد که پیشرفت را به ارمغان خواهد آورد، اما به دلیل فقدان استانداردهای اخلاقی از ابتدا، عواقب بیشماری از اطلاعات نادرست گرفته تا جرایم سایبری به همراه داشته است. در مورد هوش مصنوعی، اگر به روش «اول اجرا کن - بعد مدیریت کن» به توسعه خود ادامه دهد، خطر برای جامعه چندین برابر بیشتر خواهد شد.

این تحلیلها نشان میدهد که اجماع بالایی بین پیشگامان وجود دارد: هوش مصنوعی سریعتر از توانایی جهان در ایجاد چارچوبهای قانونی در حال توسعه است.

ویتنام مصمم است فناوری هوش مصنوعی را بر اساس فلسفه باز توسعه دهد.

بویی دِ دوی، معاون وزیر علوم و فناوری، در سخنرانی خود در این رویداد گفت که ویتنام اولین استراتژی هوش مصنوعی خود را در سال ۲۰۲۱ منتشر کرد. اما هوش مصنوعی با سرعت فوقالعادهای در حال توسعه است، بنابراین در پایان امسال، ما استراتژی و قانون بهروز شده هوش مصنوعی را اعلام خواهیم کرد. این نه تنها یک چارچوب قانونی، بلکه اعلامیهای از چشمانداز ملی است که مشخص میکند هوش مصنوعی باید به زیرساخت فکری ویتنام تبدیل شود و به رفاه اجتماعی، توسعه پایدار و افزایش رقابتپذیری ملی کمک کند.

آقای بویی دِ دوی گفت: «امروزه هوش مصنوعی فقط یک فناوری کاربردی نیست، بلکه در حال تبدیل شدن به یک زیرساخت ضروری مانند برق، مخابرات یا اینترنت است؛ هر کشوری که بر هوش مصنوعی تسلط داشته باشد، از مزیت برتری در اقتصاد-اجتماعی و امنیت و دفاع ملی برخوردار خواهد بود. بنابراین، ویتنام در حال ساخت یک مرکز ابررایانه ملی هوش مصنوعی، یک اکوسیستم داده باز و یک زیرساخت هوش مصنوعی ویتنامی به سمت خودمختاری است، در عین حال که هوش مصنوعی جامع را با سرعت بالایی پیادهسازی میکند و هوش مصنوعی را به یک «دستیار هوشمند» جهانی برای همه مردم تبدیل میکند تا بهرهوری اجتماعی را بهبود بخشد و دسترسی به دانش را گسترش دهد، گامی رو به جلو که قبلاً فقط رهبران عالی رتبه به آن دسترسی داشتند.»

معاون وزیر تأیید کرد که ویتنام مصمم است فناوری هوش مصنوعی را بر اساس فلسفه باز توسعه دهد: استانداردهای باز، دادههای باز، کد منبع باز. «باز» راهی برای دریافت دانش جهانی، تسلط بر فناوری، توسعه ساخت ویتنام و کمک به بشریت است. «باز» همچنین شرطی برای تضمین ایمنی و شفافیت در کاربردهای هوش مصنوعی است.

برای توسعه هوش مصنوعی، بازار داخلی باید به اندازه کافی بزرگ باشد؛ بدون کاربرد، بازاری وجود نخواهد داشت و شرکتهای هوش مصنوعی ویتنامی نمیتوانند بالغ شوند. بنابراین، دولت کاربرد هوش مصنوعی را در صنایع و سازمانهای دولتی ترویج خواهد کرد و همزمان، صندوق ملی نوآوری فناوری 30 تا 40 درصد از منابع پشتیبانی، از جمله کوپنهای هوش مصنوعی را برای شرکتهای کوچک و متوسط اختصاص خواهد داد تا بازار ویتنام واقعاً بتواند به مهد شرکتهای قوی هوش مصنوعی تبدیل شود.

ویتنام از «مزیت دیرآمدن» برخوردار است

دانشیار لو آنه توآن، مدیر اجرایی مرکز تحقیقات هوش مصنوعی در دانشگاه وین یونی، در مورد این موضوع گفت که زبان ویتنامی بسیار پیچیده است، بنابراین مدلهای زبان خارجی نمیتوانند آن را درک کنند. علاوه بر این، ما به شدت به مدلهای زبان خارجی وابسته هستیم و فاقد یک استاندارد مدل زبان ویتنامی بزرگ هستیم.

«ما از صفر شروع میکنیم، در حالی که کشورهای دیگر مجموعه دادههایی دارند که دههها پیش توسعه یافتهاند، بنابراین این یک مزیت است، زیرا بار زیادی وجود ندارد، بنابراین فرصتی برای ساختن از پایه وجود دارد و میتوان از ابتدا دادههای پاک ایجاد کرد. ویتنام با مزیت دیرآمدن، این فرصت را نیز دارد که از جدیدترین فناوریهای جهان بهره ببرد. اول، ما باید یک انبار داده پاک بسازیم که همه زمینهها را پوشش دهد و زمینه ویتنام را با گویشهای گروههای قومی ویتنامی داشته باشد. علاوه بر این، یک مکانیسم اخلاقی برای جلوگیری از اطلاعات نادرست و اخبار جعلی وجود دارد.» این گفته دانشیار لو آنه توآن است.

دانشیار لو آنه توآن تأکید کرد که ویتنام باید حاکمیت هوش مصنوعی را تضمین کند، از مسیر متنباز پیروی کند و دولت باید دستورالعملهای روشنی در این زمینه داشته باشد. علاوه بر این، باید یک چارچوب اخلاق ملی هوش مصنوعی، دستورالعملهای دقیق در مورد استقرار مدلهای زبانی بزرگ و یک آژانس مستقل برای تأیید و نظارت وجود داشته باشد تا این مدل کاملاً خودمختار نباشد. بنابراین، باید توسط دولت، مشاغل و مردم مدیریت شود تا زیرساختهای هوش مصنوعی برای ویتنام ایجاد شود.

منبع: https://vietnamnet.vn/thu-truong-bui-the-duy-viet-nam-se-cong-bo-chien-luoc-ai-cap-nhat-va-luat-ai-2468645.html

![[عکس] پرستش مجسمه تویت سون - گنجینهای تقریباً ۴۰۰ ساله در پاگودای کئو](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[عکس] رژه به مناسبت پنجاهمین سالگرد روز ملی لائوس](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

نظر (0)