Le PDG de Truepic, Jeffrey McGregor, a déclaré que cet incident n'était que la partie émergée de l'iceberg. « Il y aura de plus en plus de contenu généré par l'IA sur les réseaux sociaux et nous n'y sommes pas préparés », a-t-il affirmé.

Selon CNN, Truepic souhaite résoudre ce problème grâce à une technologie qui authentifie les contenus multimédias au moment de leur création via Truepic Lens. L'application de collecte de données indique aux utilisateurs la date, l'heure, le lieu et l'appareil utilisés pour la prise de vue, et y appose une signature numérique afin de vérifier si l'image est naturelle ou générée par l'IA.

Une fausse photo de l'explosion du Pentagone devient virale sur Twitter

Truepic, une société soutenue par Microsoft et fondée en 2015, a déclaré que l'entreprise suscitait l'intérêt d' ONG, de sociétés de médias et même d'assureurs cherchant à confirmer la légitimité des demandes d'indemnisation.

McGregor affirme que lorsque tout pourra être falsifié, lorsque l'intelligence artificielle aura atteint son apogée en termes de qualité et d'accessibilité, nous ne saurons plus ce qu'est la réalité en ligne.

Des entreprises technologiques comme Truepic luttent depuis des années contre la désinformation en ligne. Mais l'essor d'une nouvelle génération d'outils d'IA capables de générer des images et du texte à la demande de l'utilisateur a rendu cette lutte encore plus urgente. Plus tôt cette année, de fausses images du pape François portant une doudoune Balenciaga et de l'ancien président américain Donald Trump se faisant arrêter ont été largement diffusées. Ces deux incidents ont semé la confusion chez des millions de personnes quant aux dangers potentiels de l'IA.

Certains parlementaires appellent désormais les entreprises technologiques à s'attaquer au problème en étiquetant les contenus générés par l'IA. La vice-présidente de la Commission européenne, Vera Jourova, a déclaré que des entreprises comme Google, Meta, Microsoft et TikTok ont adhéré au code de bonnes pratiques volontaire de l'Union européenne en matière de lutte contre la désinformation.

Un nombre croissant de startups et de géants de la technologie, dont certains intègrent l'IA générative dans leurs produits, tentent de mettre en œuvre des normes et des solutions pour aider les utilisateurs à déterminer si une image ou une vidéo a été créée avec l'IA.

Mais comme l'intelligence artificielle progresse plus vite que l'humain, il est difficile de savoir si ces solutions permettront de résoudre pleinement le problème. Même OpenAI, la société à l'origine de Dall-E et ChatGPT, a reconnu que ses efforts pour détecter l'écriture générée par l'IA sont imparfaits.

Les entreprises qui développent des solutions adoptent deux approches pour résoudre ce problème. La première consiste à développer des programmes capables d'identifier les images générées par l'IA après leur production et leur diffusion en ligne. La seconde vise à marquer une image comme réelle ou générée par l'IA au moyen d'une sorte de signature numérique.

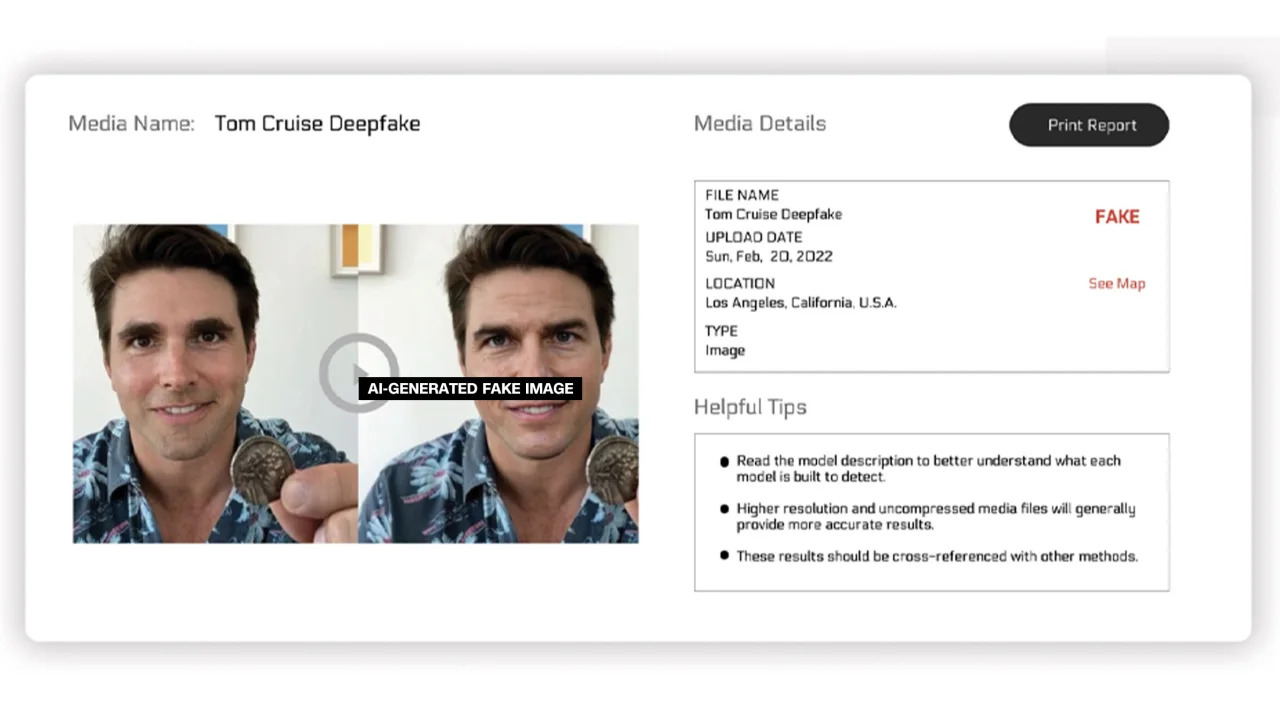

Reality Defender et Hive Moderation travaillent sur le premier projet. Grâce à leur plateforme, les utilisateurs peuvent télécharger des images pour analyse et recevoir ensuite un rapport indiquant le pourcentage de photos réelles ou générées par IA.

Reality Defender affirme utiliser une technologie propriétaire d'empreinte digitale de contenu génératif et de deepfake pour détecter les vidéos, les fichiers audio et les images générés par l'IA. À titre d'exemple, l'entreprise a présenté une image deepfake de Tom Cruise jugée « suspecte » à 53 % en raison d'un visage déformé, caractéristique des photos manipulées.

Images étiquetées générées par l'IA

Ces services proposent des versions gratuites et payantes. Hive Moderation facture 1,50 $ pour 1 000 images. Realty Defender indique que ses tarifs peuvent varier en fonction de divers facteurs, notamment lorsque les clients ont besoin de son expertise et de son assistance. Le PDG de Realty Defender, Ben Colman, affirme que le risque double chaque mois, car n'importe qui peut créer de fausses photos à l'aide d'outils d'intelligence artificielle.

Plusieurs autres entreprises travaillent à l'ajout d'un système d'étiquetage aux images afin de certifier si elles sont réelles ou générées par l'IA. Jusqu'à présent, ces efforts ont été principalement menés par la Content Authenticity and Origination Alliance (C2PA).

Fondée en 2021, C2PA a pour objectif de créer une norme technique de certification de l'origine et de l'historique des contenus numériques. Elle associe l'initiative d'authentification de contenu (CAI) d'Adobe et le projet Origin, mené par Microsoft et la BBC, avec pour ambition de lutter contre la désinformation dans l'actualité numérique. Parmi les autres entreprises membres de C2PA figurent Truepic, Intel et Sony.

S’appuyant sur les principes du C2PA, CAI mettra à disposition des outils open source permettant aux entreprises de créer des métadonnées contenant des informations sur les images. Selon le site web de CAI, cela permettra aux créateurs de partager en toute transparence les détails de la création de leurs images. Ainsi, les utilisateurs finaux pourront accéder au contexte (qui, quoi et comment) de l’image et juger par eux-mêmes de son authenticité.

De nombreuses entreprises ont déjà intégré la norme C2PA et les outils CAI à leurs applications. Firefly d'Adobe, un nouvel outil d'imagerie IA ajouté à Photoshop, est conforme à la norme C2PA grâce à sa fonctionnalité d'authentification du contenu. Microsoft a également annoncé que les images et vidéos créées avec Bing Image Creator et Microsoft Designer seront dotées de signatures cryptographiques dans les prochains mois.

En mai, Google a annoncé la fonctionnalité « À propos de cette image », qui permet aux utilisateurs de voir la date de première apparition d'une image sur Google et les plateformes où elle est visible. Le géant de la recherche a également annoncé que chaque image générée par l'IA de Google comportera un balisage dans le fichier original afin d'« ajouter du contexte » si l'image est trouvée sur un autre site web ou une autre plateforme.

Alors que les entreprises technologiques s'efforcent de répondre aux inquiétudes concernant les images générées par l'IA et l'intégrité des médias numériques, les experts du secteur soulignent que les entreprises devront collaborer entre elles et avec les gouvernements pour résoudre ce problème. Pourtant, malgré les risques, ces entreprises se lancent dans le développement de l'IA à un rythme effréné.

Lien source

![[Photo] Le ginseng de la montagne Dan, un précieux cadeau de la nature au pays Kinh Bac](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F11%2F30%2F1764493588163_ndo_br_anh-longform-jpg.webp&w=3840&q=75)

Comment (0)