לתקוף מכל זווית.

גוגל השיקה מוצר חדש של בינה מלאכותית (AI) בשם "Gemini Nano Banana", שאינו בינה מלאכותית לשונית בקנה מידה גדול (LLM) המסוגלת לכתוב ולהסיק חשיבה, אלא בינה מלאכותית המתמחה בעריכת תמונות... משתמשים רבים מתרגשים מהכלי הזה, אך הוא מביא עמו גם מספר חסרונות.

"זה כמו 'צעד אחורה' בטכנולוגיית הבינה המלאכותית ובמגבלות האתיות", אמר נגוין הונג פוק, המנהל המדעי הראשי של Conductify AI, והביע את דעתו האישית. "ל-Gemini Nano Banana יש יכולות עריכת תמונות יעילות. אבל ביטול הצנזורה של Gemini Nano Banana על ידי גוגל, שחרור המחסומים והמנגנונים המגבילים, מאפשר לבינה המלאכותית הזו ליצור תמונות הדומות להפליא לסלבריטאים, תמונות מרמזות, תמונות רגישות וכו'", אמר פוק.

לדברי מר נגוין הונג פוק, יכולת זו הופכת את Gemini Nano Banana לכלי ליצירת תמונות מזויפות ריאליסטיות, עד כדי כך שאפילו מומחי בינה מלאכותית אינם יכולים להבחין ביניהן, מה שמוביל לסיכונים חדשים של הונאה ואבטחת סייבר, כגון יצירת תמונות מזויפות עם פוליטיקאים מפורסמים כדי להפיץ מידע כוזב, ואפילו אנשים פרטיים נתונים למניפולציה והשמצות של תמונות שנוצרו על ידי בינה מלאכותית ברשתות החברתיות...

יתר על כן, עם עשרות כלי עריכת תמונות אחרים המבוססים על בינה מלאכותית שכובשים את האינטרנט בסערה, הונאות דיפ-זייק לא מראות סימני עצירה. סטטיסטיקות של ארגוני אבטחה מראות שטכנולוגיית דיפ-זייק יוצרת קמפיינים של פישינג המכוונים לאנשים בעלי ערך רב, במיוחד למנהיגים עסקיים. בשנת 2024 היו 140,000-150,000 מקרים ברחבי העולם, כאשר 75% מהם כוונו למנכ"לים ולמנהלים בכירים... דיפ-זייקים עלולים להגדיל את ההפסדים הכלכליים העולמיים ב-32%, כ-40 מיליארד דולר בשנה עד 2027.

לאחרונה, חברת הבינה המלאכותית Anthropic זיהתה וסכלה קמפיין מתקפות סייבר שבוצע על ידי האקרים זרים, אשר לראשונה תיעד שימוש בבינה מלאכותית לתיאום פעילויות מתקפה אוטומטיות. באופן ספציפי, ההאקרים השתמשו במערכות בינה מלאכותית כדי לתכנן, לכוון ולפרוס פעולות חדירה - התפתחות "מדאיגה" אשר מסכנת את הרחבת היקף ומהירותן של קמפיינים של מתקפות סייבר...

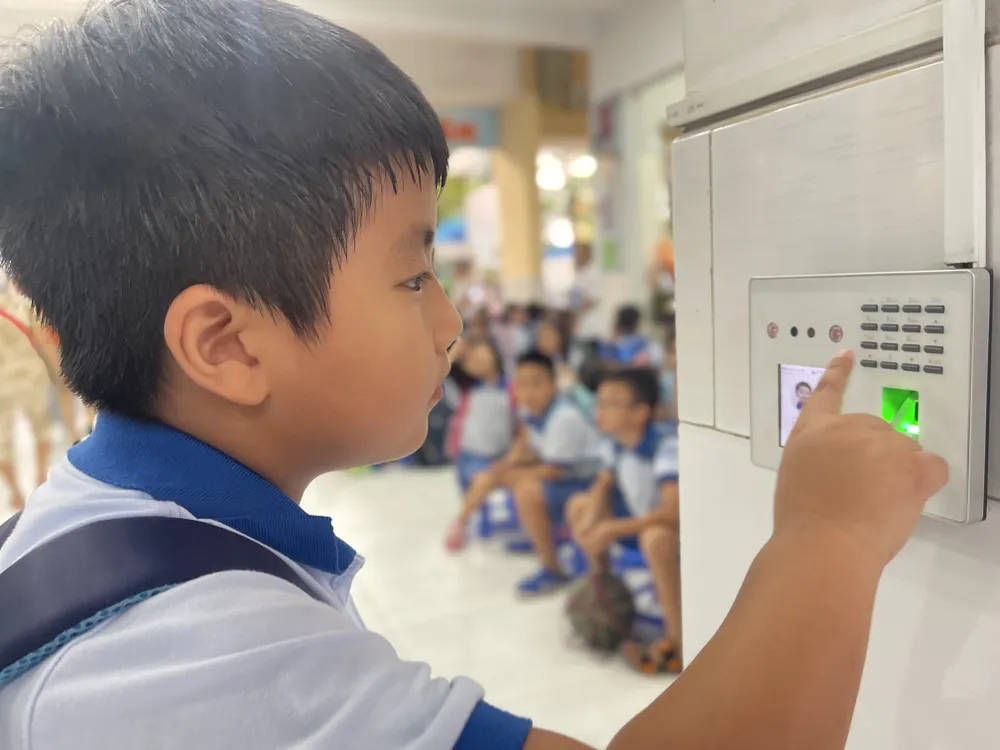

מר נגו מין הייאו, מנהל הארגון למניעת הונאות של האיגוד הלאומי לסייברסקייר, שיתף כי כלים משולבים בבינה מלאכותית מגבירים את מהירות ההונאה פי 20 בערך בהשוואה לשימוש באנשים אמיתיים. נוכלים מספקים לבינה מלאכותית תרחיש הונאה לניתוח, והמערכת משוחחת באופן אוטומטי עם הקורבנות באופן מיידי. מהנתונים הראשוניים, הבינה המלאכותית יכולה להבין מה הקורבן רוצה ולתקשר איתו בזמן אמת. הטקטיקה המתוחכמת ביותר היא מתקפת "אדם באמצע", שבה כאשר משתמש מבצע אימות וידאו (כגון הקלטת פניו או מתן פקודות), ההאקר מתערב כדי להפריע לנתונים המועברים. פושעי סייבר מוסיפים לאחר מכן סרטוני דיפפייק מוכנים מראש, ומחליפים את זרם הנתונים האמיתי של המשתמש כדי לעקוף את תהליך האימות. בשיטה זו, גם מערכות האבטחה של בנקים ומוסדות פיננסיים נמצאות בסיכון להונאה.

ניהול נתונים טוב יותר

ככל שבינה מלאכותית הופכת נפוצה יותר ויותר, גם סיכוני האבטחה והפרטיות גדלים באופן משמעותי. נתונים המאוחסנים ומעובדים בשרתים מרוחקים יהפכו למטרה אטרקטיבית עבור האקרים ופושעי סייבר. על פי נתונים של האיגוד הלאומי לאבטחת סייבר, ברבעון השני של 2025 לבדו, מספר מתקפות הסייבר המונעות על ידי בינה מלאכותית גדל ב-62%, וגרם להפסדים עולמיים של עד 18 מיליארד דולר...

מומחים מאמינים שהגנת מידע היא קריטית. עם זאת, איסוף ומכירת נתונים ממשיכים להיות גלויים בפלטפורמות רבות של "שוק שחור", תמורת 20 דולר בלבד לחודש. פושעי סייבר יכולים להשתמש בכלים המחקים מודלים של שפה אך מותאמים אישית למטרות פליליות. כלים אלה מסוגלים לייצר תוכנות זדוניות ואף לעקוף תוכנות אנטי-וירוס.

בווייטנאם, צו מס' 13/2023/ND-CP (בתוקף החל מ-17 באפריל 2023) מסדיר את ההגנה על מידע אישי. יתר על כן, חוק הגנת מידע אישי, שצפוי להיכנס לתוקף ב-1 בינואר 2026, יפתח מנגנון משפטי חזק יותר לטיפול בסיכון של דליפות מידע אישי ושימוש לרעה. עם זאת, על פי האיגוד הלאומי לסייברסקייר, עדיין יש לחזק את יעילות האכיפה על פני שלושה עמודי תווך: העלאת מודעות הציבור, הגברת האחריות התאגידית ושיפור יכולת העיבוד של גופים רגולטוריים. מעבר לאמצעים טכניים, כל אדם צריך לפתח את היכולת לזהות סימנים חריגים וחשודים ולהגן על עצמו באופן יזום מפני אינטראקציות דיגיטליות מסוכנות...

קספרסקי הזהירה מפני ניצול של בינה מלאכותית אפלה (מונח המתייחס לפריסה של מודלים של שפה גדולה (LLM) הפועלים מחוץ לבקרות אבטחה סטנדרטיות, ולעתים קרובות מאפשרים פעולות כגון פישינג, מניפולציה, מתקפות סייבר או ניצול לרעה של נתונים). ארגונים ואנשים פרטיים צריכים להיערך להתמודד עם מתקפות סייבר מתוחכמות וקשות יותר לגילוי עקב עליית הבינה המלאכותית האפלה באזור אסיה-פסיפיק.

סרגיי לוז'קין, ראש צוות המחקר והניתוח הגלובלי (GReAT) עבור אזורי המזרח התיכון, טורקיה, אפריקה ואסיה-פסיפיק בקספרסקי, שיתף כי ביטוי אחד של ניצול לרעה נוכחי של בינה מלאכותית הוא הופעתם של מודלים של Black Hat GPT. אלו הם מודלים של בינה מלאכותית שפותחו או שונו במיוחד כדי לשרת מטרות לא אתיות ובלתי חוקיות, כגון יצירת תוכנות זדוניות, יצירת מיילי פישינג שוטפים ומשכנעים עבור התקפות בקנה מידה גדול, יצירת קולות וסרטונים מזויפים, ואפילו תמיכה בהתקפות מדומות.

מומחי קספרסקי ממליצים לאנשים פרטיים ולעסקים להשתמש בפתרונות אבטחה מהדור הבא כדי לזהות תוכנות זדוניות שנוצרו על ידי בינה מלאכותית, תוך מתן עדיפות להגנה על נתונים. עסקים צריכים ליישם כלי ניטור בזמן אמת כדי לעקוב אחר ניצול פגיעויות המונעות על ידי בינה מלאכותית; לחזק את בקרת הגישה והכשרת העובדים כדי להגביל את הבינה המלאכותית באזור האפל ואת הסיכון לדליפות נתונים; ולהקים מרכז פעולות אבטחת סייבר כדי לנטר איומים ולהגיב במהירות לאירועים.

מקור: https://www.sggp.org.vn/bao-mat-du-lieu-thoi-ai-post824210.html

תגובה (0)