सूचना सुरक्षा विभाग ने हाल ही में उच्च तकनीक वीडियो और छवि धोखाधड़ी की निरंतर पुनरावृत्ति के संबंध में चेतावनी जारी की है।

तदनुसार, साइबर अपराधियों द्वारा लोगों की सार्वजनिक तस्वीरों और वीडियो का फायदा उठाकर उन्हें संपादित करने, काटने और फर्जी वीडियो के जरिए ब्लैकमेल करने की धमकी देने की स्थिति के बारे में अधिकारियों ने बड़ी संख्या में लोगों को चेतावनी दी है।

डीपफेक तकनीक का उपयोग करके, जो किसी व्यक्ति की ध्वनि और छवि को उच्च सटीकता के साथ पुनरुत्पादित करने की अनुमति देती है, अपराधी ऑनलाइन बैठकों में नेताओं का रूप धारण कर सकते हैं, या वित्तीय धोखाधड़ी करने के लिए वीडियो और कॉल बना सकते हैं।

इसके अलावा, ये घोटाले अक्सर मनोवैज्ञानिक कारकों जैसे कि तात्कालिकता, भय या शक्ति का फायदा उठाते हैं, जिससे पीड़ित प्रामाणिकता की सावधानीपूर्वक जांच किए बिना जल्दबाजी में कार्य करने लगते हैं।

डीपफेक केवल वित्तीय निवेश घोटालों तक ही सीमित नहीं हैं। इसका एक और उदाहरण रोमांस घोटाले हैं, जहाँ डीपफेक का इस्तेमाल काल्पनिक पात्र बनाने के लिए किया जाता है जो वीडियो कॉल के ज़रिए पीड़ितों से बातचीत करते हैं; पीड़ित का विश्वास जीतने के बाद, घोटालेबाज़ आपात स्थिति, यात्रा खर्च या ऋण के लिए धन हस्तांतरण का अनुरोध करते हैं।

उपरोक्त स्थिति के मद्देनजर, सूचना सुरक्षा विभाग लोगों को सलाह देता है कि वे सोशल नेटवर्क पर मशहूर हस्तियों से मिलने वाली निवेश सलाह से सावधान रहें; अनजान संदेशों, ईमेल या कॉल से सावधान रहें; और वीडियो में अस्वाभाविक चेहरे के भावों पर ध्यान दें।

लोगों को सामाजिक नेटवर्क पर व्यक्तिगत जानकारी से संबंधित सामग्री पोस्ट करने को भी सीमित करना होगा, ताकि बुरे लोगों द्वारा चित्र, वीडियो या आवाज जैसी जानकारी चुराए जाने से बचा जा सके; साथ ही, व्यक्तिगत जानकारी की सुरक्षा के लिए खातों को निजी मोड पर सेट करना होगा।

वियतनाम साइबर धोखाधड़ी रोकथाम परियोजना (Chongluadao.vn) के सह-संस्थापक और साइबर सुरक्षा विशेषज्ञ न्गो मिन्ह हियू ने दाई दोआन केट अखबार के पत्रकारों से बात करते हुए कहा कि धोखाधड़ी के लिए नकली वीडियो कॉल करने के लिए एआई में डीपफेक तकनीक का इस्तेमाल अभी भी जटिल है। लोग अपने "शिकार" की विश्वसनीयता बढ़ाने के लिए इस तकनीक का इस्तेमाल करते हैं।

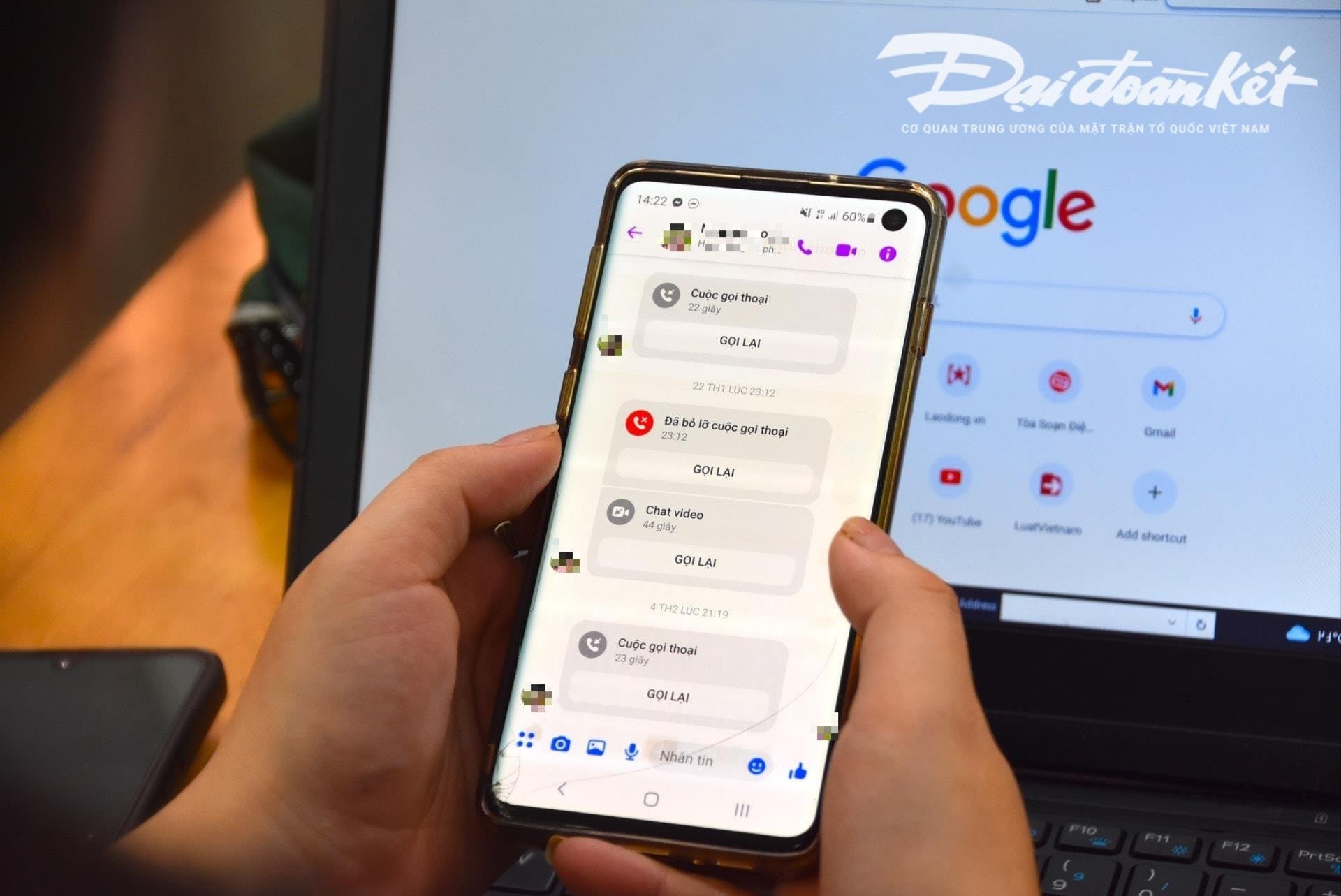

विशेष रूप से, ये लोग पहले से चुराई गई छवियों और वीडियो से पीड़ितों को सक्रिय रूप से वीडियो कॉल करेंगे और पीड़ित का विश्वास हासिल करने के लिए तकनीक में हेरफेर करेंगे, ध्वनि को विकृत करेंगे या नकली छवि की समस्या पैदा करेंगे।

आमतौर पर, ये कॉल बहुत छोटी होती हैं, जो केवल कुछ सेकंड तक चलती हैं, फिर वे अस्थिर नेटवर्क, सड़क पर होने आदि का बहाना बनाकर पीड़ित से घोटालेबाज के अनुरोधों को पूरा करने के लिए कहते हैं।

विशेषज्ञ चेतावनी देते हैं कि निकट भविष्य में साइबर धोखाधड़ी के लिए एआई का इस्तेमाल काफ़ी बढ़ सकता है। इसलिए, लोगों को अपनी सतर्कता बढ़ानी होगी, खासकर जब उन्हें अजीबोगरीब संदेश, वीडियो कॉल और लिंक मिलते हों।

इस विशेषज्ञ के विश्लेषण के अनुसार, वास्तविक समय कॉल के दौरान वर्तमान डीपफेक आर्टिफिशियल इंटेलिजेंस (एआई) एल्गोरिदम इसे संभालने में सक्षम नहीं होगा यदि कॉलर बाएं मुड़ता है, दाएं मुड़ता है, या खड़ा होता है ...

इन कॉल्स को रिसीव करते समय लोगों को जिस एक खास कमज़ोरी पर ध्यान देने की ज़रूरत है, वह है दांत। इसलिए, मौजूदा एआई एल्गोरिदम नकली व्यक्ति के दांतों की नकल नहीं कर सकते।

डीपफेक का इस्तेमाल करने पर, मुंह खोले हुए व्यक्ति की तस्वीर में दांत नहीं दिख सकते, कुछ लोगों के जबड़े तीन या चार भी हो सकते हैं। इसलिए, डीपफेक का इस्तेमाल करके की गई फर्जी कॉल में दांतों की विशेषताएं सबसे पहचानने योग्य तत्व होती हैं।

धोखाधड़ी के जाल में फँसने से बचने के लिए "धीमा" होना और अनुरोध का तुरंत पालन न करना एक पूर्वापेक्षा है। सोशल नेटवर्क के माध्यम से कोई भी संदेश या कॉल प्राप्त होने पर, लोगों को अपने रिश्तेदारों को सीधे कॉल करके यह सत्यापित करना चाहिए कि कौन उनसे कम से कम 30 सेकंड से अधिक समय के लिए संपर्क कर रहा है या व्यक्तिगत रूप से मिलना चाहिए।

यदि आपको संदेह हो कि आप सोशल नेटवर्क पर अपने रिश्तेदारों का रूप धारण करके धोखाधड़ी कर रहे हैं या आपकी संपत्ति हड़प रहे हैं, तो समय पर सहायता और कार्रवाई के लिए तुरंत निकटतम पुलिस एजेंसी को रिपोर्ट करना आवश्यक है।

[विज्ञापन_2]

स्रोत: https://daidoanket.vn/chuyen-gia-chi-meo-nhan-biet-cuoc-goi-deepfake-lua-dao-10300910.html

![[फोटो] कैट बा - हरा-भरा द्वीप स्वर्ग](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F04%2F1764821844074_ndo_br_1-dcbthienduongxanh638-jpg.webp&w=3840&q=75)

![[VIMC 40 दिन बिजली की गति से] दा नांग पोर्ट: एकता - बिजली की गति - अंतिम रेखा तक सफलता](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/04/1764833540882_cdn_4-12-25.jpeg)

टिप्पणी (0)