नीचे आरएमआईटी विश्वविद्यालय के दो विशेषज्ञों के डीपफेक के हानिकारक प्रभावों पर विचार और इस समस्या के प्रस्तावित समाधान दिए गए हैं:

|

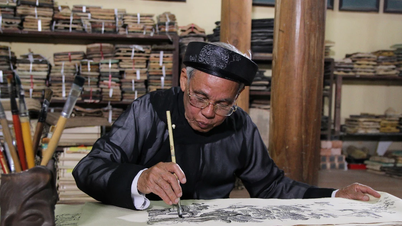

| डॉ. जोनाथन क्रेलिन (बाएं) और डॉ. गुयेन वान थांग लॉन्ग (दाएं)। (स्रोत: आरएमआईटी विश्वविद्यालय) |

साइबर अपराधी नई तकनीकों का अप्रत्याशित तरीकों से फायदा उठाते हैं।

डॉ. जोनाथन क्रेलिन, सूचना सुरक्षा विभाग के प्रमुख, विज्ञान , इंजीनियरिंग और प्रौद्योगिकी संकाय, आरएमआईटी विश्वविद्यालय :

डीपफेक मशीन द्वारा निर्मित छवियां हैं जो विभिन्न स्रोतों से छवियों या वीडियो को मिलाकर अत्यधिक यथार्थवादी छवियां, वीडियो या यहां तक कि ऑडियो भी बना सकती हैं।

डीपफेक कृत्रिम बुद्धिमत्ता की एक तकनीक पर आधारित होते हैं जिसे मशीन लर्निंग कहा जाता है, जो किसी व्यक्ति के चेहरे जैसे तत्वों को अन्य छवियों या वीडियो में प्रतिस्थापित और एकीकृत कर सकती है।

डीपफेक के उपयोग का एक उदाहरण अश्लील सामग्री को टेलर स्विफ्ट की तस्वीरों के साथ मिलाकर नकली छवियां बनाना है।

इसे हासिल करने के लिए, मास्टरमाइंड को कई छवियों की आवश्यकता थी ताकि सॉफ्टवेयर गायक के चेहरे के भावों के बारे में जान सके, फिर उन्हें अश्लील सामग्री के साथ मिलाकर अश्लील छवियां बना सके, जिससे गायक की छवि धूमिल हो सके।

दरअसल, ऐसी अफवाहें हैं कि ये तस्वीरें टेलीग्राम पर एक समूह द्वारा जारी की गई थीं और इन्हें माइक्रोसॉफ्ट डिजाइनर का उपयोग करके बनाया गया था, जो एकीकृत एआई समर्थन वाला एक टूल है।

कोई भी इसका शिकार बन सकता है, क्योंकि अपराधी को केवल उस व्यक्ति की तस्वीरें, वीडियो या ऑडियो रिकॉर्डिंग की आवश्यकता होती है जिसकी पहचान का दुरुपयोग किया जा रहा है।

विभिन्न प्रकार की धोखाधड़ी वाली गतिविधियों का इस्तेमाल गलत सूचना फैलाने के लिए किया जा सकता है, और यह कहना सुरक्षित है कि आगामी अमेरिकी राष्ट्रपति चुनाव ऐसी फर्जी खबरों से भरा होगा।

वर्तमान में, दुनिया भर के कानून निर्माता इस प्रकार की छवियों के खिलाफ कानून बनाने की कोशिश कर रहे हैं।

अमेरिका में कानून बनाने के लिए कई दृष्टिकोण अपनाए जा रहे हैं, जैसे कि नागरिक मुकदमों पर भरोसा करना, या "किसी व्यक्ति की सहमति के बिना उसकी कृत्रिम बुद्धिमत्ता से उत्पन्न अश्लील छवियों को प्रसारित करने" से संबंधित कानून बनाना।

चीन ने कृत्रिम बुद्धिमत्ता द्वारा बनाई गई छवियों को प्रसारित करने वाले व्यक्तियों पर मुकदमा चलाने की अनुमति देने वाले नए नियम भी पेश किए हैं।

यूनाइटेड किंगडम अपने ऑनलाइन सुरक्षा कानून के तहत डीपफेक सामग्री साझा करना अवैध मानता है।

हम इसका पता कैसे लगा सकते हैं या इसे कैसे रोक सकते हैं?

पहला उपाय है ऑनलाइन साझा की जाने वाली छवियों, वीडियो या ऑडियो रिकॉर्डिंग की संख्या कम करना। सुनिश्चित करें कि आप उन्हें केवल अपने परिचितों के साथ ही साझा करें और उन्हें व्यापक रूप से ऑनलाइन पोस्ट न करें। एक बार सामग्री इंटरनेट पर अपलोड हो जाने के बाद, उसे हटाना लगभग असंभव हो जाता है।

दूसरा विकल्प यह है कि परिवार के सदस्यों के साथ कॉल को प्रमाणित करने के लिए एक गुप्त कोड पर सहमति बनाई जाए, जिससे कॉल स्पूफिंग का शिकार होने का जोखिम कम हो जाता है।

तस्वीरों, खासकर वीडियो में अजीबोगरीब खामियां हो सकती हैं (वे बनावटी लग सकती हैं), और यदि आप इन खामियों को देखते हैं, तो इस बात की बहुत अधिक संभावना है कि तस्वीर या ध्वनि नकली है।

एक अन्य तकनीक जिसका उपयोग किया जा सकता है, वह है मूल छवि के स्रोत की पहचान करने के लिए Google या अन्य खोज इंजनों पर "उल्टे चित्र" खोजना।

अंत में, यही सीख मिलती है: जो कुछ भी आप देखते हैं उस पर आँख बंद करके भरोसा न करें; कैमरे (या कृत्रिम बुद्धिमत्ता) झूठ बोल सकते हैं!

डीपफेक तकनीकें मशहूर हस्तियों और राजनेताओं के लिए एक बड़ा खतरा हैं।

डॉ. गुयेन वान थांग लॉन्ग, वरिष्ठ व्याख्याता, संचार और डिजाइन विभाग, आरएमआईटी विश्वविद्यालय :

डीपफेक से फैल रही फर्जी खबरों के प्रसार के साथ, मशहूर हस्तियों और राजनेताओं की मीडिया टीमों को फर्जी खबरों की निगरानी करने और उन पर तुरंत प्रतिक्रिया देने या गलत सूचनाओं को लगातार ठीक करने के लिए संसाधनों की आवश्यकता है।

यदि डीपफेक को व्यवस्थित रूप से "गंदे जनसंपर्क" के संगठित रूपों के साथ जोड़ा जाता है, तो परस्पर विरोधी सूचनाओं के प्रसार के कारण यह कार्य और भी कठिन हो जाता है, और फर्जी खबरें और नकारात्मक खबरें हमेशा सकारात्मक खबरों की तुलना में अधिक साझा की जाएंगी।

आम तौर पर, जब लोग सोशल मीडिया पर साझा की गई खबरें देखते हैं, तो वे आधिकारिक समाचार चैनलों के माध्यम से जानकारी की पुष्टि करने की कोशिश करते हैं।

सोशल मीडिया पर डीपफेक सामग्री की बाढ़ आने के साथ, मुख्यधारा की खबरों की सटीकता को सत्यापित करना तेजी से कठिन और समय लेने वाला होता जा रहा है, जिसके लिए गहन शोध और सत्यापन तकनीकों की आवश्यकता होती है।

समाचारों और स्रोतों के सत्यापन में जितनी देरी होती है, सोशल मीडिया पर जानकारी साझा करने और उस पर टिप्पणी करने की तीव्र गति के कारण गलत सूचना, मनगढ़ंत बातें या भ्रामक जानकारी उतनी ही अधिक व्यापक हो जाती है।

इससे मूल समस्या और भी गंभीर हो जाती है और सामाजिक अशांति पैदा होने की संभावना रहती है, खासकर यदि विषयवस्तु राजनीतिक भाषण, धर्म, लिंग, व्यावसायिक रणनीति या व्यापक आर्थिक मुद्दों से संबंधित हो।

व्यापक रूप से फैल रही डीपफेक गतिविधियों के संदर्भ में, सबसे प्रभावी जोखिम प्रबंधन रणनीति व्यवसायों, मशहूर हस्तियों, राजनेताओं और प्रशंसकों, प्रेस, समुदाय और कर्मचारियों जैसे प्रमुख हितधारकों के बीच लोकप्रिय सोशल मीडिया प्लेटफॉर्म, वेबसाइटों या आमने-सामने की बैठकों के माध्यम से लगातार संचार चैनल बनाए रखना है।

|

कृत्रिम बुद्धिमत्ता के बढ़ते उपयोग से लाभ और अप्रत्याशित नई समस्याएं दोनों सामने आती हैं। (उदाहरण के लिए चित्र। स्रोत: फ्रीपिक) |

इन संचार चैनलों को बनाए रखने से, डीपफेक से संबंधित जानकारी अधिक तेज़ी से प्राप्त होती है, जिससे अफवाहों का समय पर और प्रभावी ढंग से निवारण करने और शुरुआत से ही गलत सूचनाओं को उजागर करने में मदद मिलती है।

हालांकि, कंपनियों, मशहूर हस्तियों और राजनेताओं को डीपफेक से निपटने के लिए विशेष रूप से संकट प्रबंधन योजनाएँ विकसित करने की आवश्यकता है। उदाहरण के लिए, उन्हें यह निर्धारित करना होगा कि घटना की घोषणा कौन करेगा, किन मीडिया चैनलों के माध्यम से करेगा, साक्ष्य और विश्वसनीय स्रोतों का उपयोग करके जानकारी को सत्यापित करने के मानदंड क्या होंगे, अफवाह से निपटने के लिए एक समयसीमा तय करनी होगी और विश्वसनीयता बहाल करने की रणनीति की रूपरेखा तैयार करनी होगी।

एक सुनियोजित और तैयार रणनीति के साथ, डीपफेक संकट से निपटना अधिक संभव हो जाता है, जिससे संभावित नकारात्मक परिणामों को कम किया जा सकता है।

[विज्ञापन_2]

स्रोत

![[फोटो] 15वीं राष्ट्रीय सभा के 10वें सत्र का समापन समारोह](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765448959967_image-1437-jpg.webp&w=3840&q=75)

![[फोटो] प्रधानमंत्री फाम मिन्ह चिन्ह रूस की रोसाटॉम कॉर्पोरेशन के सीईओ से फोन पर बात कर रहे हैं।](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F11%2F1765464552365_dsc-5295-jpg.webp&w=3840&q=75)

![[आधिकारिक] मीसा ग्रुप ने व्यवसायों, परिवारों और सरकार के लिए एजेंटिक एआई के निर्माण में अपनी अग्रणी ब्रांड स्थिति की घोषणा की।](https://vphoto.vietnam.vn/thumb/402x226/vietnam/resource/IMAGE/2025/12/11/1765444754256_agentic-ai_postfb-scaled.png)

टिप्पणी (0)