साउथ चाइना मॉर्निंग पोस्ट के अनुसार, चीनी सेना ने हाल ही में चेतावनी दी है कि कृत्रिम बुद्धिमत्ता (एआई) युद्ध के मैदान में मानव निर्णय लेने की क्षमता का स्थान नहीं ले सकती।

चीनी पीपुल्स लिबरेशन आर्मी (पीएलए) ने 31 दिसंबर, 2024 को नए साल की पूर्व संध्या पर पीएलए डेली में प्रकाशित एक लेख में जोर देते हुए कहा, "एआई को निर्णयकर्ताओं के साथ मिलकर काम करना चाहिए ताकि कमांड दक्षता को अनुकूलित किया जा सके, मनुष्यों को प्रतिस्थापित करने के बजाय उन्हें बढ़ाया जा सके।"

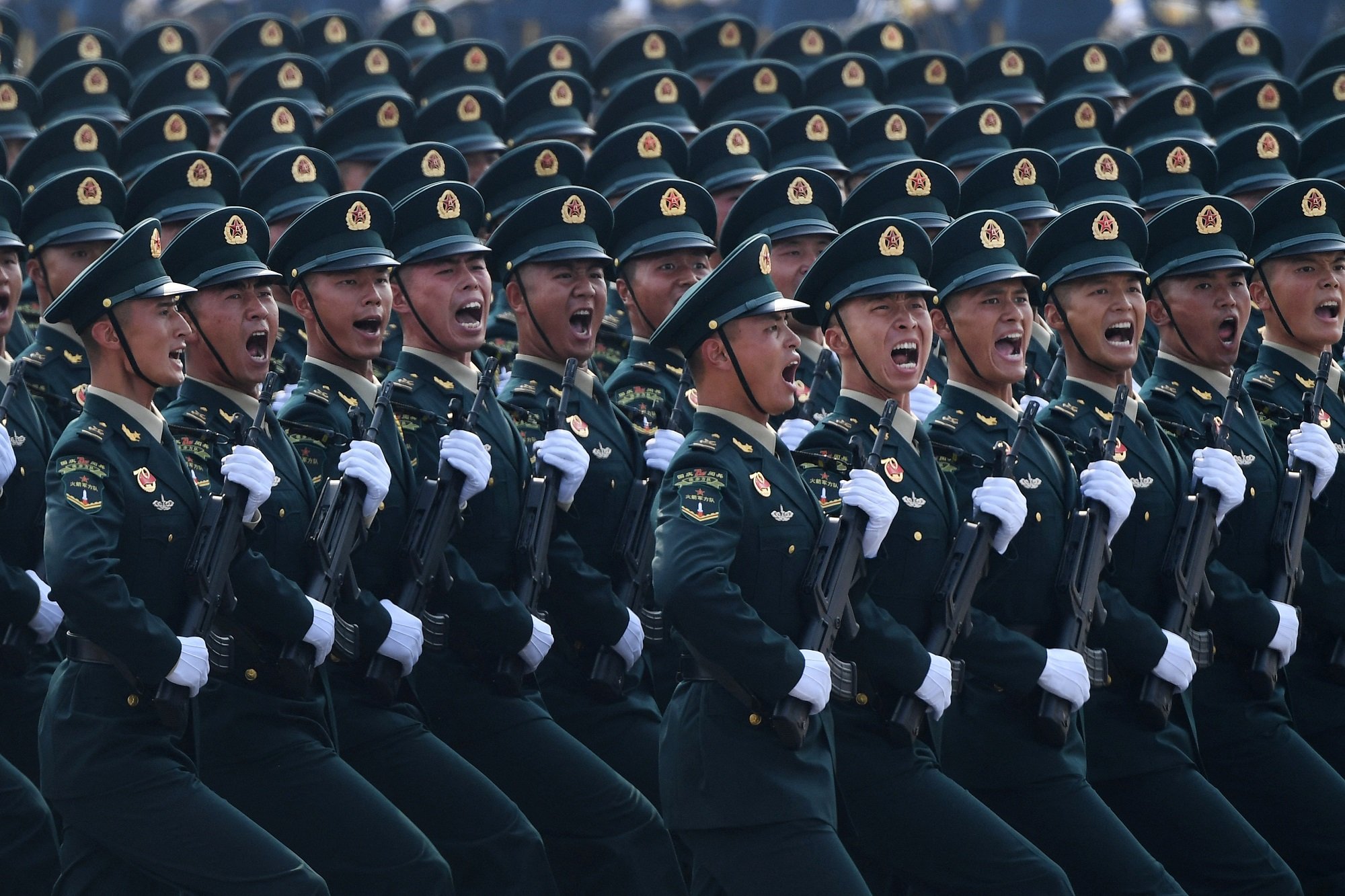

1 अक्टूबर, 2019 को बीजिंग के तियानमेन चौक पर सैन्य परेड के दौरान चीनी सैनिक

लेख में यह भी कहा गया है कि एआई का इस्तेमाल डेटा विश्लेषण, सिमुलेशन या योजना के ज़रिए मानवीय क्षमताओं को बढ़ाने के लिए किया जा सकता है, लेकिन यह उनकी जगह नहीं ले सकता। लेख में कहा गया है, "जैसे-जैसे यह विकसित होता है, एआई को मानवीय निर्णय द्वारा निर्देशित एक उपकरण बने रहना चाहिए, जिससे यह सुनिश्चित हो सके कि जवाबदेही, रचनात्मकता और रणनीतिक अनुकूलनशीलता सैन्य निर्णय लेने में सबसे आगे रहें।"

लेख में, पीएलए इस बात पर ज़ोर देता है कि युद्ध के मैदान में मानवीय स्वायत्तता और रचनात्मकता अपरिहार्य हैं। पीएलए का तर्क है कि जहाँ मानव कमांडर परिस्थितियों पर गतिशील रूप से प्रतिक्रिया दे सकते हैं और दुश्मन की कमज़ोरियों का फ़ायदा उठा सकते हैं, वहीं एआई पूर्वनिर्धारित एल्गोरिथम सीमाओं के भीतर काम करता है और इसकी प्रतिक्रियाओं में अक्सर मौलिकता का अभाव होता है।

पीएलए "मानव योजना और एआई क्रियान्वयन" मॉडल की ओर झुकाव रखता है, जिसमें कमांडरों द्वारा विकसित रणनीतियों और युक्तियों को क्रियान्वित करने के लिए प्रौद्योगिकी का उपयोग किया जाता है, जबकि मानवीय निगरानी का तत्व बरकरार रहता है।

चीनी नौसेना के विशेष बलों ने इलेक्ट्रिक स्केटबोर्ड की सवारी की, अभ्यास में पक्षी जैसे यूएवी छोड़े

पीएलए एक ऐसे ढाँचे का भी समर्थन करता है जहाँ मशीनें डेटा का विश्लेषण करें, जानकारी प्रदान करें और संभावित कार्रवाइयों की सिफ़ारिश करें। हालाँकि, पीएलए के अनुसार, "अंतिम निर्णय मानव कमांडरों के हाथ में होता है, जिससे एआई की ब्लैक-बॉक्स प्रकृति से उत्पन्न होने वाली त्रुटियों का प्रतिरोध सुनिश्चित होता है।"

[विज्ञापन_2]

स्रोत: https://thanhnien.vn/quan-doi-trung-quoc-ra-canh-bao-ve-ai-18525010214511349.htm

![[फोटो] लाओस के राष्ट्रीय दिवस की 50वीं वर्षगांठ मनाने के लिए परेड](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

![[फोटो] केओ पैगोडा में लगभग 400 साल पुराने खजाने - तुयेत सोन की मूर्ति की पूजा](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

टिप्पणी (0)