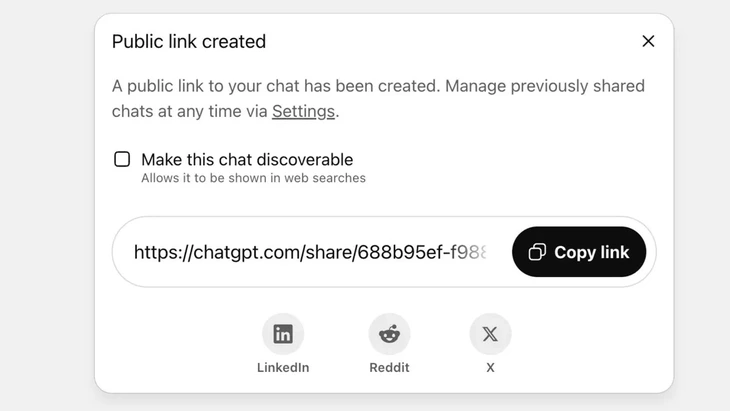

Fitur untuk berbagi obrolan melalui tautan publik di ChatGPT - Foto: Techradar

ChatGPT sekarang menjangkau lebih dari 2,5 miliar pertanyaan dari pengguna global setiap hari, menunjukkan semakin populernya chatbot ini.

Namun, alat ini menghadapi reaksi keras dari pengguna, karena fitur "berbagi" telah menyebabkan ribuan percakapan membocorkan informasi sensitif ke Google dan beberapa mesin pencari di Internet.

Risiko keamanan tinggi

Bapak Vu Ngoc Son, Kepala Departemen Teknologi National Cyber Security Association (NCA), menilai insiden di atas menunjukkan tingginya risiko keamanan bagi pengguna ChatGPT.

"Insiden di atas belum tentu merupakan kesalahan teknis karena ada inisiatif tertentu dari pengguna dalam mengeklik tombol bagikan. Namun, dapat dikatakan bahwa masalahnya terletak pada desain produk chatbot AI, yang membingungkan pengguna dan tidak adanya langkah-langkah peringatan yang cukup kuat tentang risiko kebocoran data pribadi jika pengguna membagikannya," analisis Bapak Vu Ngoc Son.

Pada ChatGPT, fitur ini diterapkan setelah pengguna memilih untuk berbagi obrolan melalui tautan publik, konten akan disimpan di server OpenAI sebagai situs web publik (chatgpt.com/share/...), tidak diperlukan login atau kata sandi untuk mengakses.

Perayap Google secara otomatis memindai dan mengindeks halaman-halaman ini, membuatnya muncul di hasil pencarian, termasuk teks sensitif, gambar, atau data obrolan.

Banyak pengguna tidak menyadari risiko ini, karena mengira mereka berbagi obrolan dengan teman atau kontak. Hal ini mengakibatkan ribuan percakapan terekspos, yang dalam beberapa kasus berisi informasi pribadi yang sensitif.

Meskipun OpenAI segera menghapus fitur ini pada akhir Juli 2025 setelah mendapat reaksi keras dari komunitas, tetap dibutuhkan waktu untuk berkoordinasi dengan Google guna menghapus indeks lama. Terutama dengan sistem penyimpanan yang kompleks, termasuk server cache Google, hal ini tidak dapat dilakukan dengan cepat.

Jangan memperlakukan chatbot AI sebagai "kotak hitam pengaman"

Pakar keamanan data Vu Ngoc Son - kepala teknologi di National Cyber Security Association (NCA) - Foto: CHI HIEU

Kebocoran ribuan log obrolan dapat menimbulkan risiko bagi pengguna seperti terungkapnya rahasia pribadi dan bisnis; kerusakan reputasi, risiko keuangan, atau bahkan bahaya keselamatan karena terungkapnya alamat rumah.

“Chatbot yang didukung AI bermanfaat tetapi bukan ‘kotak hitam’, karena data yang dibagikan dapat ada selamanya di web jika dibiarkan tanpa kendali.

Insiden di atas tentu menjadi pelajaran bagi penyedia dan pengguna. Penyedia layanan AI lainnya dapat belajar dari pengalaman ini dan merancang fitur dengan peringatan yang lebih jelas dan transparan.

"Pada saat yang sama, pengguna juga perlu secara proaktif membatasi pengeposan informasi identitas atau pribadi yang tidak terkendali pada platform AI," saran pakar keamanan Vu Ngoc Son.

Menurut para pakar keamanan data, insiden di atas menunjukkan perlunya koridor hukum dan standar keamanan siber untuk AI. Penyedia dan pengembang AI juga perlu merancang sistem yang menjamin keamanan, menghindari risiko kebocoran data seperti: kebocoran melalui kerentanan yang buruk; kerentanan perangkat lunak yang menyebabkan serangan basis data; kontrol yang buruk yang menyebabkan keracunan, penyalahgunaan untuk menjawab pertanyaan yang salah dan menyimpang.

Pengguna juga perlu mengontrol pembagian informasi pribadi dengan AI, bukan membagikan informasi sensitif. Jika benar-benar diperlukan, disarankan untuk menggunakan mode anonim atau mengenkripsi informasi secara aktif guna menghindari data yang terhubung langsung dengan individu tertentu.

Source: https://tuoitre.vn/hang-ngan-cuoc-tro-chuyen-voi-chatgpt-bi-lo-tren-google-nguoi-dung-luu-y-gi-20250805152646255.htm

![[Foto] Menyembah patung Tuyet Son - harta karun berusia hampir 400 tahun di Pagoda Keo](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764679323086_ndo_br_tempimageomw0hi-4884-jpg.webp&w=3840&q=75)

![[Foto] Parade untuk merayakan hari jadi ke-50 Hari Nasional Laos](/_next/image?url=https%3A%2F%2Fvphoto.vietnam.vn%2Fthumb%2F1200x675%2Fvietnam%2Fresource%2FIMAGE%2F2025%2F12%2F02%2F1764691918289_ndo_br_0-jpg.webp&w=3840&q=75)

Komentar (0)