ソーシャルメディアを閲覧したことがある人なら、AIが作成した画像や動画を目にしたことがあるでしょう。トランポリンで跳ねるウサギの動画のように、多くの人が騙されてきました。しかし、OpenAIが開発したChatGPTの姉妹アプリであるSoraは、AI動画を新たなレベルに引き上げ、偽コンテンツの検出をますます喫緊の課題にしています。

AIを活用した動画ツールによって、本物の動画を識別することがこれまで以上に難しくなっている。(出典:CNET)

2024年にリリースされ、最近Sora 2にアップグレードされたこのアプリは、TikTokに似たインターフェースを持ち、すべての動画はAIによって生成されます。「カメオ」機能を使うと、実在の人物をシミュレーション映像に挿入することができ、恐ろしいほどリアルな動画を作成できます。

そのため、多くの専門家は、Soraがディープフェイクの拡散を招き、情報を歪め、現実と偽物の境界線を曖昧にするのではないかと懸念している。特に著名人は被害を受けやすく、SAG-AFTRAのような団体はOpenAIに対し、保護対策の強化を求めている。

AIが生成したコンテンツを識別することは、テクノロジー企業、ソーシャルメディアプラットフォーム、そしてユーザーにとって大きな課題です。しかし、Soraを使って作成された動画を識別する方法は存在します。

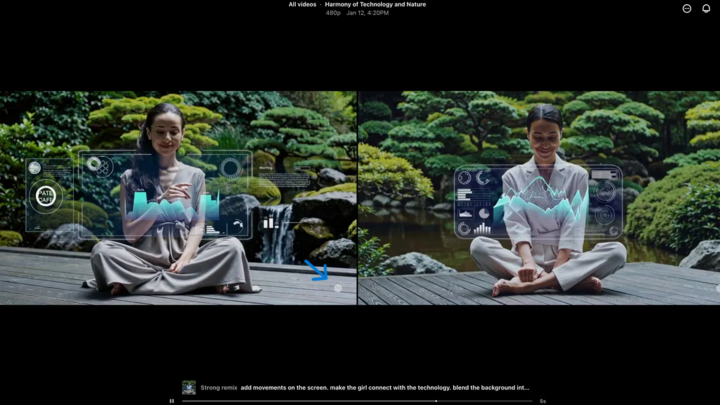

Soraの透かしを見つける

Soraのウォーターマーク(青い矢印で示されている)は、動画の作成に使用されたツールを識別するためのマーカーです。(出典:CNET)

SoraのiOSアプリで作成されたすべての動画は、ダウンロード時にウォーターマークが表示されます。白いSoraのロゴ(雲のアイコン)が動画の端を動き回り、TikTokのウォーターマークと似ています。

これは、AIが生成したコンテンツを視覚的に識別する方法の一つです。例えば、GoogleのGemini「ナノバナナ」モデルも、画像に自動的に透かしを追加します。しかし、透かしは必ずしも信頼できるとは限りません。静止画の透かしであれば、簡単に切り取ることができます。Soraのような動的な透かしでさえ、専用アプリケーションを使えば削除できてしまうのです。

この件について尋ねられたOpenAIのCEO、サム・アルトマン氏は、社会は誰でも偽動画を作成できるという現実を受け入れる必要があると主張した。Soraが登場する以前は、これほど普及し、手軽に利用でき、特別なスキルを必要としない動画作成ツールは存在しなかった。彼の見解は、代替的な検証方法に頼る必要性を浮き彫りにしている。

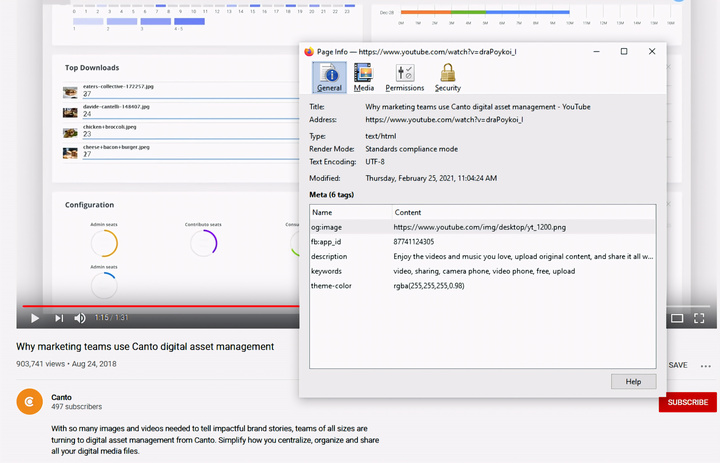

メタデータを確認する

メタデータの確認は、動画がSoraのようなAIによって作成されたかどうかを判断する上で重要なステップです。(出典:Canto)

メタデータのチェックは複雑すぎると思うかもしれませんが、実際は非常に簡単で効果的です。

メタデータとは、カメラの種類、場所、録画時間、ファイル名など、コンテンツ作成時に自動的に付加される情報のことです。コンテンツが人間によって作成されたものであろうと、AIによって作成されたものであろうと、メタデータは必ず含まれています。AIによって作成されたコンテンツの場合、メタデータには多くの場合、情報源の認証情報が含まれます。

OpenAIはコンテンツ起源・真正性連合(C2PA)のメンバーであるため、Soraの動画にはC2PAメタデータが含まれます。これは、コンテンツ真正性イニシアチブの検証ツールを使用して確認できます。

メタデータの確認方法:

- verify.contentauthenticity.org にアクセスしてください。

- チェック対象のファイルをアップロードしてください。

- 「開く」を押してください

- 右側の表の情報をご覧ください。

動画がAIによって作成された場合、概要欄にその旨が明記されます。Sora動画を確認すると、「OpenAIによって公開」という表示と、動画がAIを使用して作成されたことを示す情報が表示されます。すべてのSora動画には、その出所を証明するためにこの情報が含まれている必要があります。

出典:https://vtcnews.vn/cach-nhan-biet-video-that-hay-do-ai-tao-ar972891.html

コメント (0)